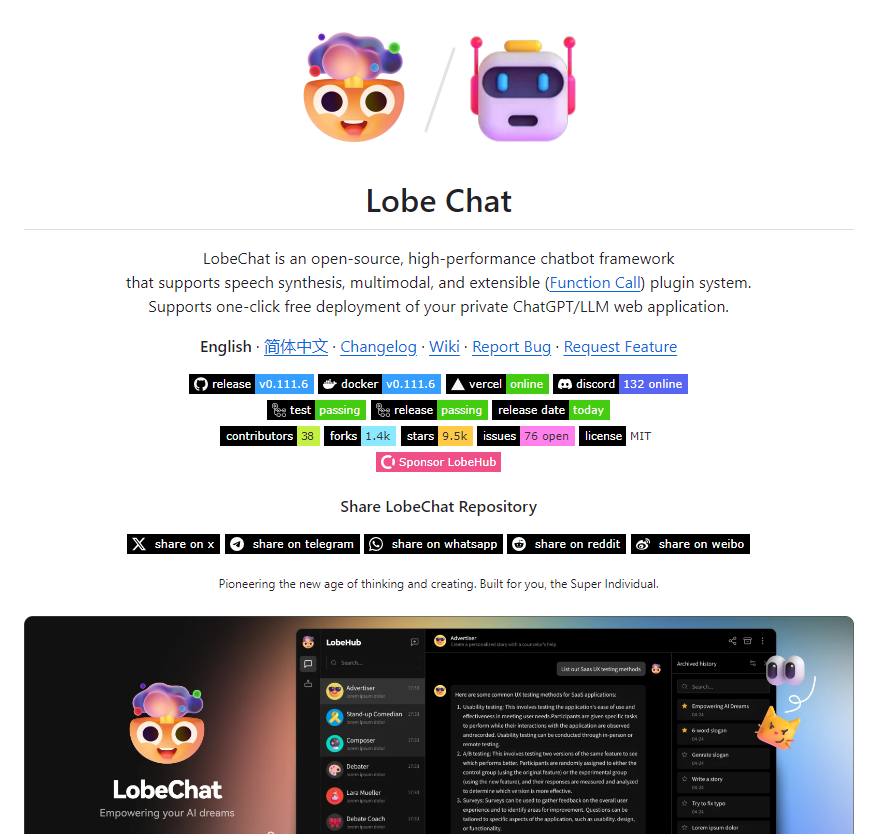

开源聊天机器人框架Lobe Chat 支持语音合成、多模态等多种功能

要点:

1. Lobe Chat是一个高性能、开源的聊天机器人框架,支持语音合成、多模态和可扩展的插件系统,能一键自由部署私有ChatGPT/LLM Web应用。

2. 新增特性包括对gpt-4-vision模型的视觉支持,支持文本转语音(TTS)和语音转文本(STT)技术,以及一个功能调用插件系统,为ChatGPT提供实时信息检索和处理的能力。

3. Lobe Chat强调插件生态系统,为ChatGPT提供实时信息检索和处理的能力,包括新的功能调用和消息结果渲染方式。该框架还有一个丰富的Agent市场,提供各种创意丰富的Agent。

Lobe Chat是一个开源的、高性能的聊天机器人框架,支持多种先进功能。该框架的核心是语音合成、多模态以及一个可扩展的插件系统。这使得Lobe Chat能够实现更智能、更丰富的对话体验。

项目地址:https://github.com/lobehub/lobe-chat

Lobe Chat引入了对gpt-4-vision模型的支持,使其能够处理图像并基于图像内容进行智能对话。用户可以轻松上传或拖放图像到对话框中,聊天代理将能够识别图像内容并进行智能对话,从而创造更智能、多样化的聊天场景。

其次,Lobe Chat还支持文本转语音(TTS)和语音转文本(STT)技术,使用户可以选择从多个声音中选择,与聊天代理进行交互,仿佛在与真人对话一样。这为那些喜欢听觉学习或在忙碌时接收信息的用户提供了极佳的解决方案。

框架的第三个重要特性是其功能调用插件系统。通过插件,ChatGPT能够进行实时信息检索和处理,例如自动获取最新新闻标题以提供用户即时和相关的信息。这为插件生态系统提供了丰富的可能性,从新闻聚合到快速文档检索,再到电商平台数据访问等。

Lobe Chat提供了Agent市场,为开发者提供了一个创新性和多样性的社区。创作者可以在市场上分享各种设计精良的Agent,为工作场景和学习过程提供便利。市场不仅是一个展示平台,也是一个协作空间,鼓励用户贡献他们的智慧,共同创造更有趣、实用和创新的Agent。

Lobe Chat关注用户体验,采用渐进式Web应用(PWA)技术,通过提供无缝体验来适应多设备环境。同时,框架还优化了移动设备的设计,提高了用户在手机上的体验,并提供了灵活的主题模式选择,包括白天的明亮模式和夜晚的深色模式。

Lobe Chat不仅提供了先进的技术特性,还注重用户体验和生态系统的发展。作为一个开源项目,它吸引了大量开发者的参与,形成了一个充满创造力和活力的社区。

高通激进!骁龙8 Gen4定版:超大核飙至4.32GHz 远高于A18 Pro

快科技9月11日消息,数码闲聊站爆料,高通骁龙8Gen4的两颗超大核频率最终敲定为4.32GHz,6颗大核的频率最终锁定为3.53GHz,对比上代的3.3GHz提升巨大,同时高于苹果A18Pro的4.04GHz。根据Geekbench公布的跑分数据,骁龙8Gen4的单核成绩是3236,多核成绩是10049,作为对比,A18Pro单核成绩是3018,多核成绩是7751。站长网2024-09-12 03:53:010000不再PK“全网最低价”,双11重归商家之争

双11如约而至。10月12日,天猫双11媒体沟通会在杭州举行。和去年各个平台都在抢夺“低价”心智相比,今年双11显得“温和”许多——淘宝天猫、京东、快手、抖音……都不约而同在双11前夕推出一系列措施,加大商家扶持力度,将更多精力和资源投向支持商家发展。站长网2024-10-15 12:01:360000南洋理工大学研究人员推出研究人员发布Upscale-A-Video:利用文本提示提升视频超分辨率

**划重点:**1.🌐视频超分辨率面临多种挑战,NTU研究人员采用潜在扩散框架中的本地-全局时间一致性策略,通过文本提示引导纹理创作,实现真实细节的卓越提升。2.🔄通过本地微调和全局潜在传播模块,研究团队解决了CNN模型在生成真实纹理方面的限制,提高了视频局部和整体结构的稳定性。站长网2023-12-18 17:09:140000淘宝102万征集代言猫:特别设立的丑猫专区

淘宝近日宣布,备受瞩目的首届“猫王争霸赛”已正式拉开帷幕,向全国猫咪爱好者发出热情邀请,寻找能够代表淘宝宠物行业的官方代言猫。即日起至7月1日,所有用户均可通过淘宝平台搜索“猫王争霸赛”,上传自家猫咪的精彩视频,参与这场别开生面的猫咪选秀。站长网2024-06-12 15:55:3200001800亿参数,支持中文,3.5万亿训练数据!开源类ChatGPT模型

阿联酋阿布扎比技术创新研究所(TechnologyInnovationInstitute,简称TII)在官网发布了,目前性能最强的开源大语言模型之一Falcon180B。TII表示,Falcon180B拥有1800亿参数,使用4096个GPU在3.5万亿token数据集上进行训练,这也是目前开源模型里规模最大的预训练数据集之一。Falcon180B有基础和聊天两个模型,允许商业化。站长网2023-09-11 14:11:150000