世界最强开源大模型Falcon 180B引爆全网 性能直逼商业模型

要点:

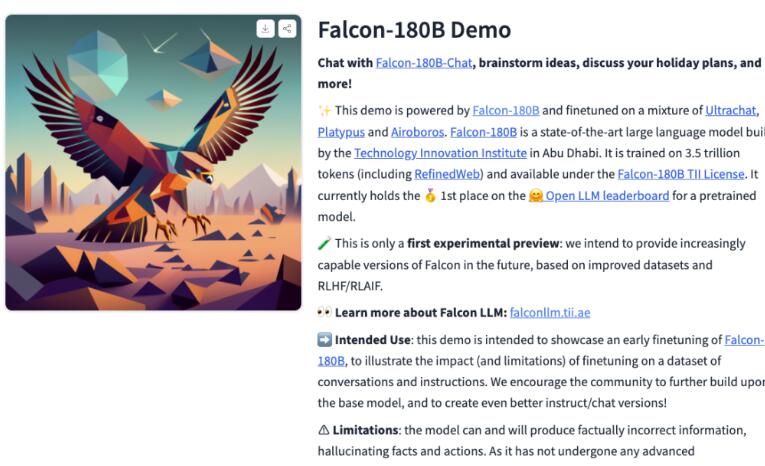

Falcon180B是TII研究中心推出的开源大模型,参数量达1800亿,在Hugging Face排行榜上位居第一。

Falcon180B在多项自然语言处理基准测试中表现强劲,击败了LLaMA2,与GPT-3.5和PaLM2不相上下。

Falcon180B可免费商用,提供了聊天对话版本,任何人都可以试用体验。

近日,阿布扎比的全球领先技术研究中心 TII 发布了一款世界顶级开源大模型 ——Falcon180B。这款模型在3.5万亿 token 的训练下,拥有1800亿参数,性能超过了之前的开源模型 Llama2,甚至接近了谷歌的 GPT-4。Falcon180B 在各项任务中表现出色,被认为是目前最好的开源大模型之一。

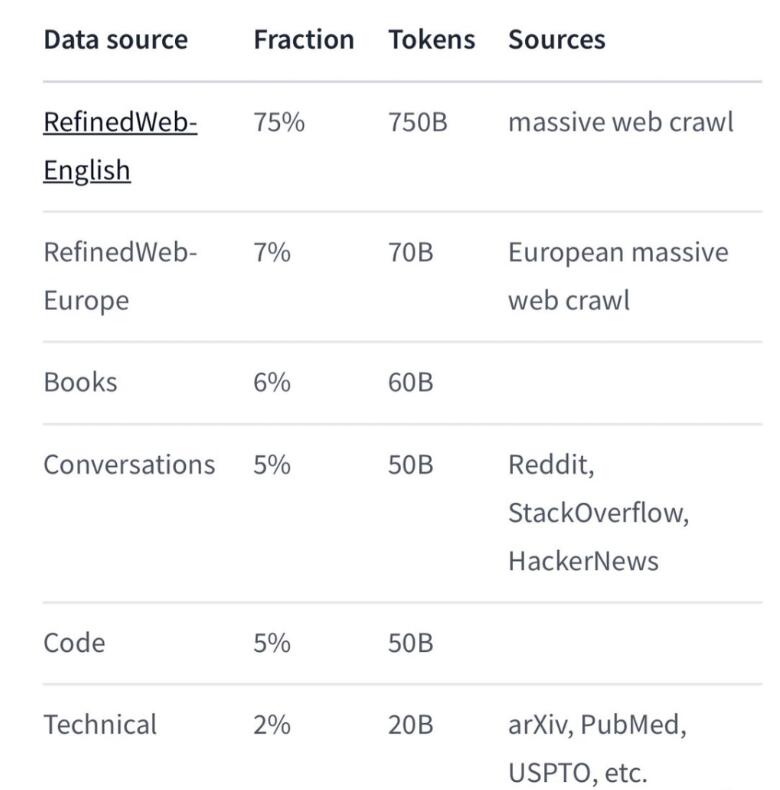

Falcon180B 的训练过程使用了亚马逊云机器学习平台,并在多达4096个 GPU 上完成了训练,总共进行了大约7,000,000个 GPU 计算时。训练数据主要来自于 RefinedWe 数据集,其中包括对话、技术论文和一小部分代码等多种数据。

项目地址:https://huggingface.co/tiiuae/falcon-180B-chat

Falcon180B 在多个基准测试中都表现出色,超过了 Llama2和 GPT-3.5。在 Hugging Face 开源大模型榜单上,Falcon180B 的评分也超过了 Llama2,成为当前评分最高的开放式大模型。

除了基础模型,研究人员还发布了聊天对话模型 Falcon-180B-Chat,该模型在对话和指令数据集上进行了微调,可以进行实时对话的演示。

虽然 Falcon180B 的性能引起了广泛关注,但也有一些人对其质疑。英伟达高级科学家 Jim Fan 指出,Falcon-180B 的训练数据中代码只占了5%,而代码是提高模型推理能力的重要数据,因此对于没有代码能力的模型,无法声称优于 GPT-3.5或接近 GPT-4。

总的来说,Falcon180B 作为世界顶级开源大模型,拥有强大的性能和参数规模,在各项任务中表现出色。然而,对于其在代码方面的不足,还需要进一步的探讨和研究。

今日AI:英伟达再出王炸!推最强AI加速卡GB200+机器人模型GR00T;Magnific AI照片风格化功能上线;免费好用的SDXL动漫模型Animagine XL3.1来了

欢迎来到【今日AI】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。新鲜AI产品点击了解:https://top.aibase.com/📰🤖📢AI新鲜事英伟达发布最强AI加速卡GB200!单机可训15个GPT-4模型【AiBase提要:】站长网2024-03-19 19:48:120000贾跃亭回应FF起诉高合汽车:盗窃FF的知识产权

今日,法拉第未来(FaradayFuture,简称FF)的创始人贾跃亭在微博上发文,宣布经过长期调查取证和准备,FF已正式对丁磊和高合汽车提起诉讼,指控其涉嫌盗窃和侵犯FF的知识产权、技术数据和商业机密。站长网2024-03-05 15:01:400000电影院「副业」进击:映前广告大降价、遍地都是按摩椅

“现在哪还有影城只靠票房,无论小影城大影城,都在推非票。”广东某影院经理李明告诉「深响」。所谓非票,是指电影票房之外的如爆米花、饮品等卖品,影院广告,以及按摩椅、娃娃机、唱吧机等娱乐消费设施带来的收入。影院的非票收入其实是老生常谈的话题,但电影市场在经历了“大落大起”后,不少影城意识到多种经营的重要性,纷纷谋划观影之外的衍生收入,非票在当下也有了新的变化与升级。站长网2023-08-10 15:56:440000马斯克、Grok与“数据封建主”

下周,马斯克踌躇已久的Grok就要上线了。在OpenAI接连甩出炸街新闻的这段时间,这事似乎没掀起太大波澜。然而,越低调的狙击,往往伤害越高。具体来说,Grok的这次年末突袭,隐藏了老马背刺OpenAI的一件“秘术”。所谓的“秘术”,其实也很简单,就是X平台上不断涌现的,真实的人类数据。在大模型数据愈发吃紧的今天,连OpenAI自己,也开始直接拿用户数据训练了。站长网2023-11-29 11:22:240000互换特产玩出套路,年轻人的“搭子”游戏何时终结?

“搭子”社交正成为年轻人时下的一种社交新风尚,搭子之间通过共同的兴趣和价值观念,主打着一个价值共享和精准陪伴。近期,特产互换搭子就是在这样的风潮下衍生出的社交新游戏。从国庆节前开始,不少年轻人就开始在互联网上寻觅“特产互换搭子”,如果能够谈得投机,便互相寄送特产,这样一来,即便是不出门去人挤人,也能够体验到一些本地人认可的美食或特产。站长网2023-10-28 10:41:450000