比Flux更强大的文生图模型来了!秘诀是“集百家之长”

打造更强大文生图模型新思路有——

面对Flux、stable diffusion、Omost等爆火模型,有人开始主打“集各家所长”。

具体来说,清北、牛津、普林斯顿等机构的研究者提出了⼀个全新文生图框架IterComp。

它能提取不同模型在各自领域的优势,同时不引入额外的复杂指令或增加计算开销。

论文一经发布,即在𝕏(前推特)获得AI论文领域大V转发,吸引大量关注。

那么,研究人员具体是如何实现的呢?

全新文生图框架:IterComp

⾃2022年以来,基于diffusion的文生图模型取得了快速发展,尤其在复杂组合生成(complex/compositional generation)任务上取得了显著进展。

例如,今年8月发布的Flux展现出了十分震撼的复杂场景生成能力与美学质量;

RPG通过MLLM的辅助,将复杂的组合生成任务分解为简单子任务;

InstanceDiffusion通过布局控制(layoutbased),实现了与布局分布高度一致的精确图像生成。

然而,这些模型的优势仅限于某些特定的组合生成任务,且存在诸多局限。

基于文本的生成方法(如SDXL、SD3、Flux等),由于其训练数据和框架的优势,在物体与场景的模拟上表现出色,特别在美学质量、属性绑定和非空间关系(non-spatial relationships)方面具有显著优势。

然而,当涉及多个物体,且存在复杂的空间关系时,这类模型往往表现出明显不足。

基于大语言模型(LLM-based)的生成方法,如RPG和Omost,通常需要对LLM进⾏额外训练或设计复杂的提示。

然而,对于LLM处理后的复杂指令,diffusion backbone并不具备精确生成的能力。

基于布局(layourbased)的生成方法,如Instancediffusion和LMD ,虽然提供了精确的控制,但在图像的美学质量和真实性上存在明显下降,并且需要人为设计布局。

因此,一个值得深⼊探讨的问题是:

能否设计出一个强大的模型,在上述多个方面都表现出⾊,同时不引入额外的复杂指令或增加计算开销?

基于此,研究人员提出一个全新的文生图框架:IterComp。

要充分解决这⼀问题,研究面临两大难点:

1、如何提取不同模型在各自领域的优势,并引导模型进行有效学习?

针对该问题,研究人员首先构建了模型库(model gallery),其包含多种在不同方面表现出色的模型,每个模型都具备特定的组合生成偏好(composition-aware model preference)。

研究人员尝试通过扩散模型对齐方法,将base diffusion model与模型库中的组合生成偏好进行对齐。

团队聚焦于compositional generation的三个关键方面:

属性绑定(attribute binding)

空间关系(spatial relationship)

⾮空间关系(non-spatial relationship)

为此,研究人员收集了不同模型在这些方面的偏好数据,并通过人工排序,构建了⼀个面向组合生成的模型偏好数据集(composition-aware model preference dataset)。

针对这三个方面,团队分别训练三个composition-aware reward models,并对base模型进行多奖励反馈优化。

2、组合生成任务很难优化,如何更充分地学习到不同模型的组合偏好?

研究人员在diffusion领域创新地引入迭代式学习框架(iterative feedback learning),实现reward models与base diffusion model之间“左脚踩右脚登天”。

具体来说,在上述第一轮优化后,团队将optimized base diffusion model以及额外选择的其他模型(例如Omost等)添加进model gallery。

对新增模型进行偏好采样,与初始model gallery中的图像按照预训练的reward model构建图像对。

这些图像对被用于进⼀步优化奖励模型,随后继续用更新的奖励模型优化基础扩散模型。

具体的流程如下伪代码所示:

实验

在定性实验中,与其他三类compositional generation方法相比,IterComp取得了显著的组合质量的提升,并且不会引入额外的计算量。

从定量结果中可以看出,IterComp在T2I-CompBench上取得了各方面的领先。

另外,针对图像真实性以及美学质量,IterComp也表现出色。

然而IterComp的应用潜力不限于此,其可以作为强大的backbone显著提升Omost, RPG等模型的生成能力。

更多细节欢迎查阅原论文。

论文地址:

https://arxiv.org/abs/2410.07171

代码地址:

https://github.com/YangLing0818/IterComp

模型地址:

https://huggingface.co/comin/IterComp

Civitai:

https://civitai.com/models/840857

苹果发布多份关于AI岗位招聘 努力为iPhone等设备推进人工智能

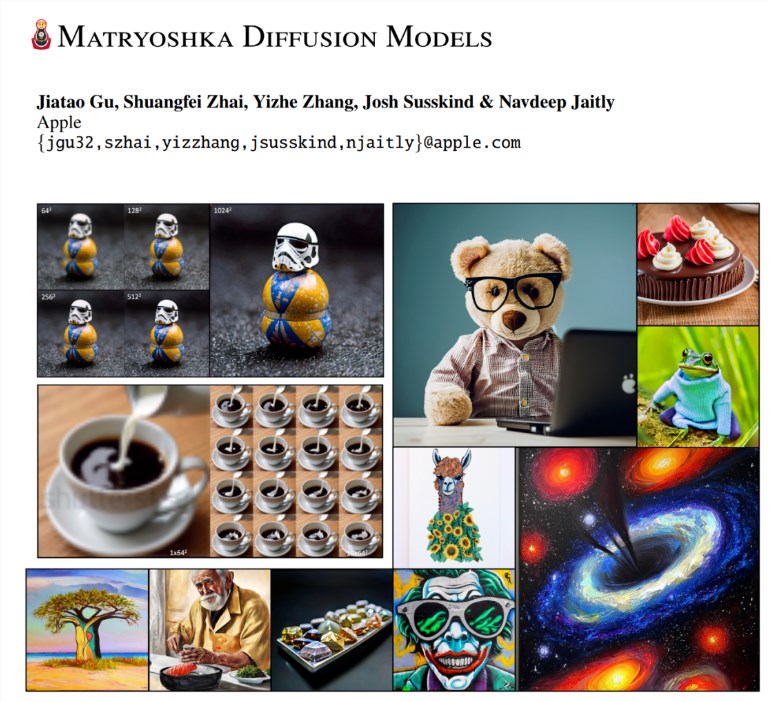

近几个月来,Apple发布了数十份专注于人工智能(AI)的招聘信息,这表明该公司其正在加大在人工智能领域的努力。这家科技巨头目前在其招聘门户网站上发布了至少88个与AI相关的职位,招聘职位涉及到视觉生成建模、预测性智能和应用人工智能研究等领域。站长网2023-05-23 10:50:360000苹果推俄罗斯套娃式扩散模型MDM 用于生成高质量图像和视频

要点:1.苹果推出了一款新的高分辨率图像生成模型,称为俄罗斯套娃式扩散模型(MatryoshkaDiffusionModels,MDM),用于生成高质量图像和视频。2.MDM采用嵌套UNet架构,结合多分辨率损失和渐进式训练,提高了高分辨率图像生成的效率和质量,同时避免了级联或潜在扩散的复杂性。站长网2023-10-30 17:53:030000谷歌更新的隐私政策引发争议 加大力度使用你的数据来训练 Bard 等人工智能

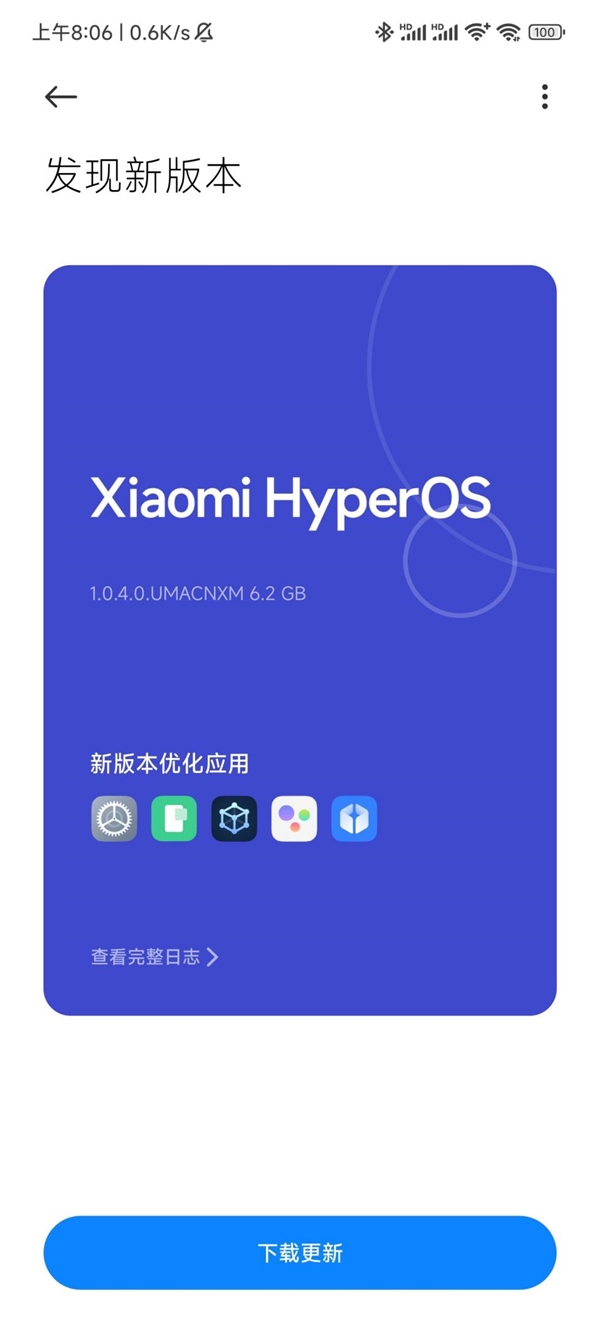

谷歌上周末更新了其隐私政策,明确表示公司保留了利用用户在网上发布的几乎所有内容来构建其人工智能工具的权利。如果谷歌可以读取你的内容,就假设它们现在属于公司,并预期未来它们将嵌套在聊天机器人内部的某个地方。站长网2023-07-04 14:43:510000小米向小米13 Ultra用户推送澎湃OS正式版

根据小米社区网友的反馈,小米向小米13Ultra手机推送了澎湃OS正式版更新。这次更新为手机带来了一系列新的功能和特性,使得用户体验得到了进一步提升。根据更新日志,澎湃OS正式版的关键任务识别染色技术能够根据任务的重要程度动态管控资源分配,从而实现更强的性能和更低的功耗。此外,该版本还实现了全面的系统底层重构,将自研的Vela系统内核与深度修改的Linux系统内核进行了融合。站长网2023-12-15 13:53:110000共创之下,百度百家号的剧情内容正在「破壳而生」

共创之下,百度百家号的剧情内容正在「破壳而生」。如今的剧情短视频迈入了精品化的阶段。随着优秀作品的数量和质量不断提升,剧情内容赛道蓬勃发展,内容形式百花齐放,创作者与机构不断挖掘热门题材,为用户带来了优秀的内容体验。平台分账、合作品牌商单、冠名等多样化的变现形式为创作者带来了实打实的收益,加之平台政策的激励,一系列优秀的内容创作者不断涌现出来。0000

正在请求数据,请稍候!

正在请求数据,请稍候!