苹果开源7B大模型,训练过程数据集一口气全给了,网友:开放得不像苹果

苹果最新杀入开源大模型战场,而且比其他公司更开放。

推出7B模型,不仅效果与Llama38B相当,而且一次性开源了全部训练过程和资源。

要知道,不久前Nature杂志编辑Elizabeth Gibney还撰文批评:

许多声称开源的AI模型,实际上在数据和训练方法上并不透明,无法满足真正的科学研究需求。

而苹果这次竟然来真的!!

就连NLP科学家、AutoAWQ创建者也发出惊叹:

Apple发布了一个击败Mistral7B的模型,但更棒的是他们完全开源了所有内容,包括预训练数据集!

也引来网友在线调侃:

至于这次开源的意义,有热心网友也帮忙总结了:

对于任何想要从头开始训练模型或微调现有模型的人来说,数据管理过程是必须研究的。

当然,除了OpenAI和苹果,上周Mistral AI联合英伟达也发布了一个12B参数小模型。

HuggingFace创始人表示,「小模型周」来了!

卷!继续卷!所以苹果这次发布的小模型究竟有多能打?

效果直逼Llama38B

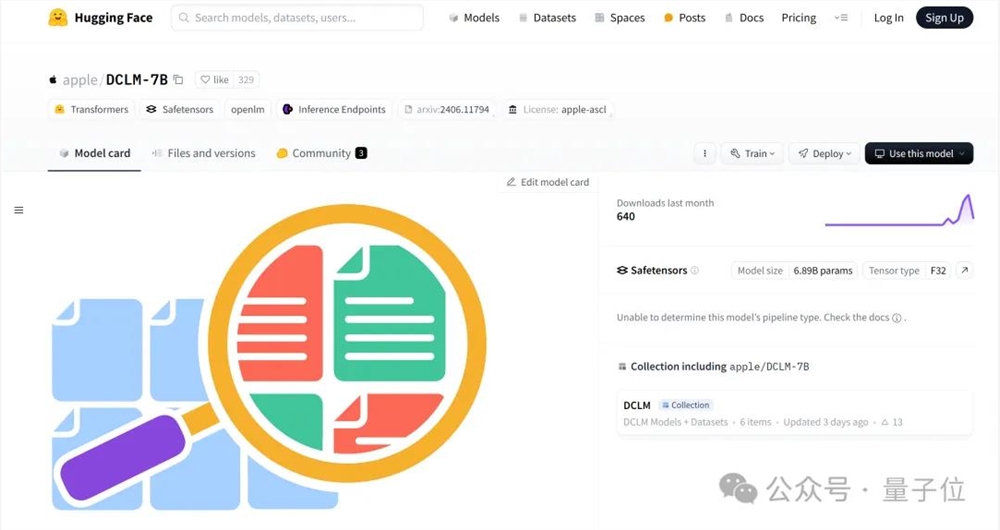

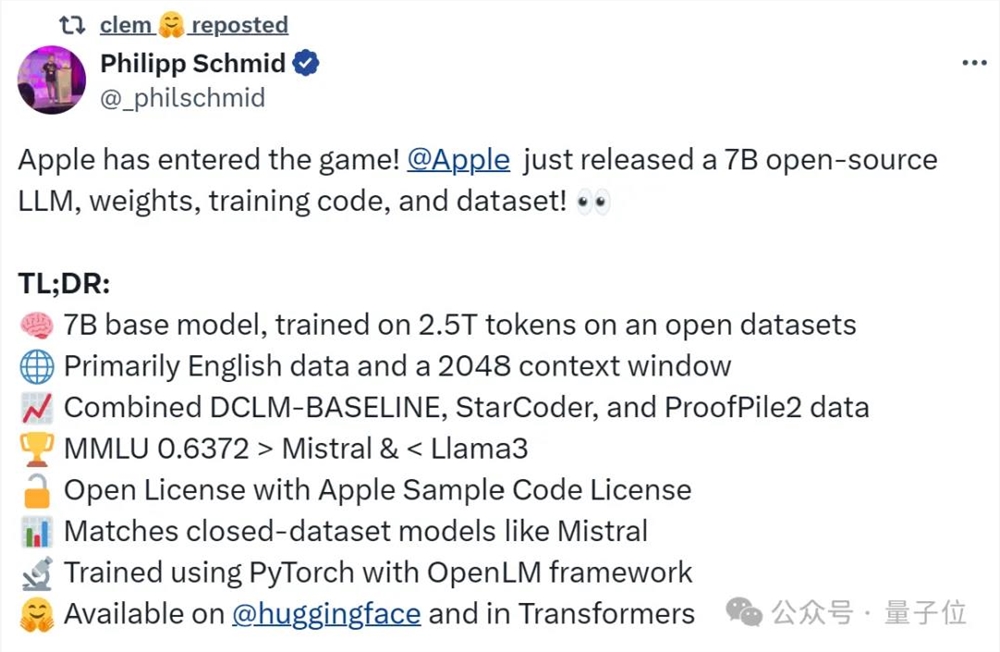

有多能打先不说,先来看Hugging Face技术主管刚“拆箱”的模型基础配置。

总结下来就是:

7B基础模型,在开放数据集上使用2.5T tokens进行训练

主要是英文数据,拥有2048tokens上下文窗口

数据集包括DCLM-BASELINE、StarCoder和ProofPile2

MMLU得分接近Llama38B

使用PyTorch和OpenLM框架进行训练

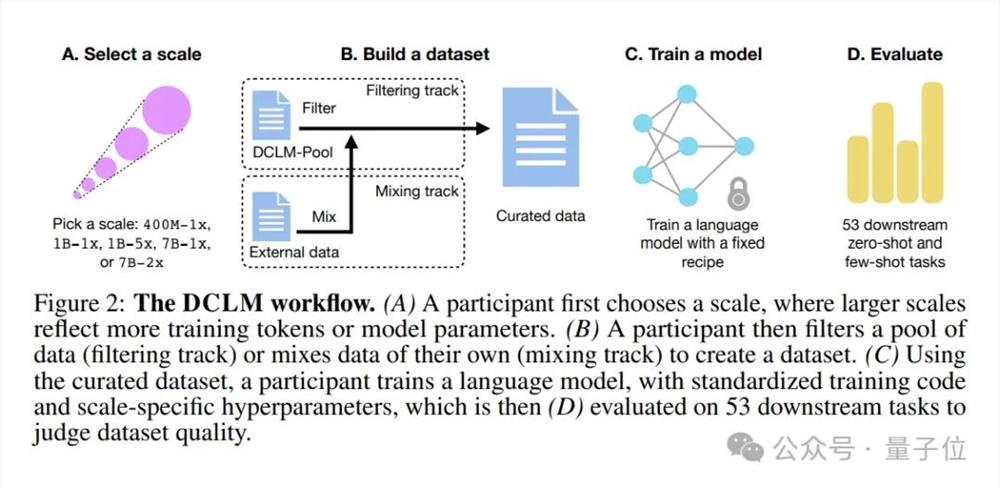

具体而言,研究团队先是提出了一个语言模型数据比较新基准——DCLM。

之所以提出这一基准,是因为团队发现:

由机器学习 (ML) 模型从较大的数据集中自动过滤和选择高质量数据,可能是构建高质量训练集的关键。

因此,团队使用DCLM来设计高质量数据集从而提高模型性能,尤其是在多模态领域。

其思路很简单:使用一个标准化的框架来进行实验,包括固定的模型架构、训练代码、超参数和评估,最终找出哪种数据整理策略最适合训练出高性能的模型。

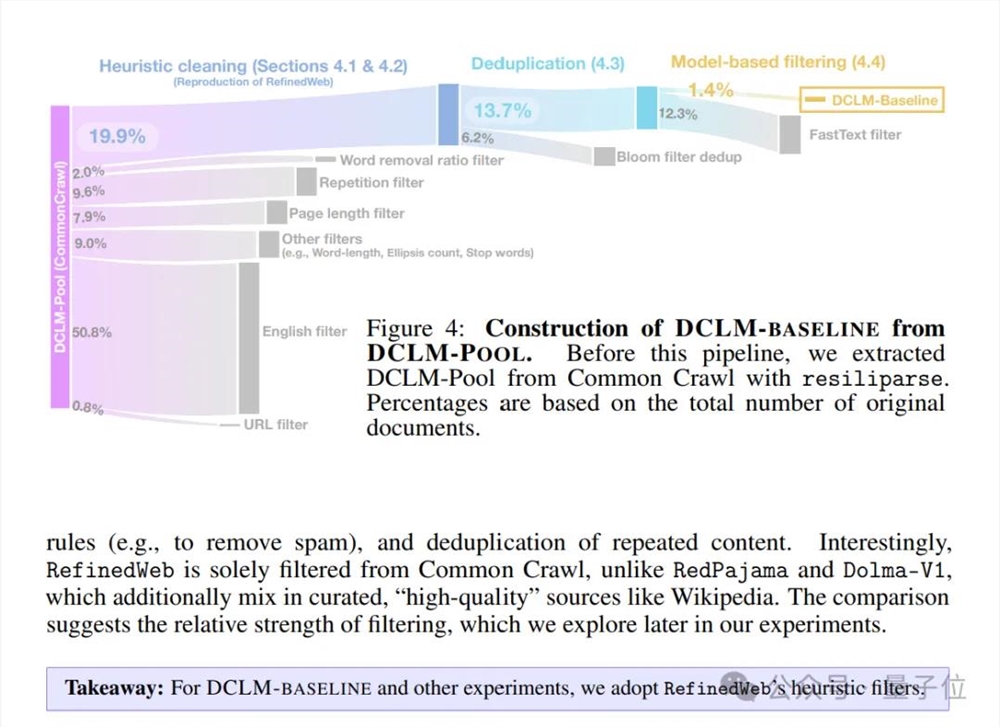

基于上述思路,团队构建了一个高质量数据集DCLM-BASELINE,并用它从头训练了一个7B参数模型——DCLM-7B。

DCLM-7B具体表现如何呢?

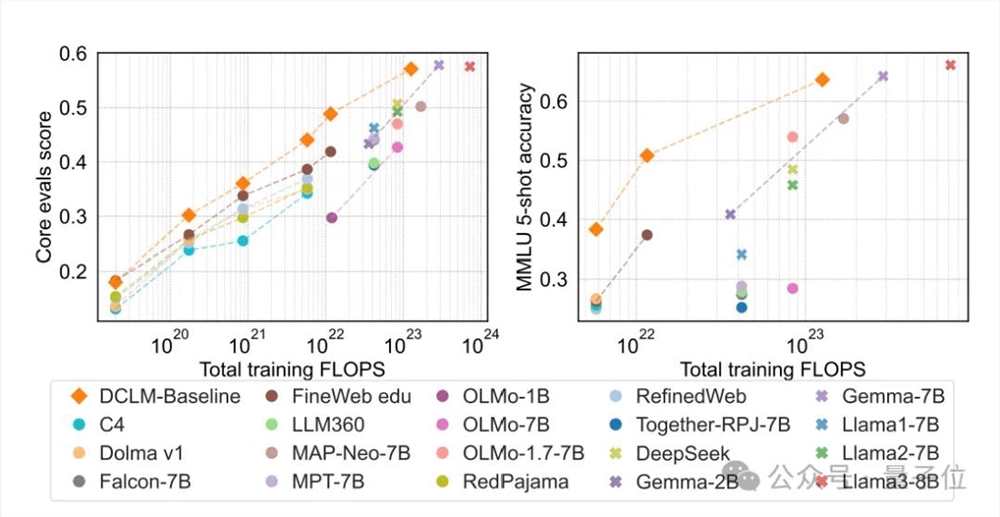

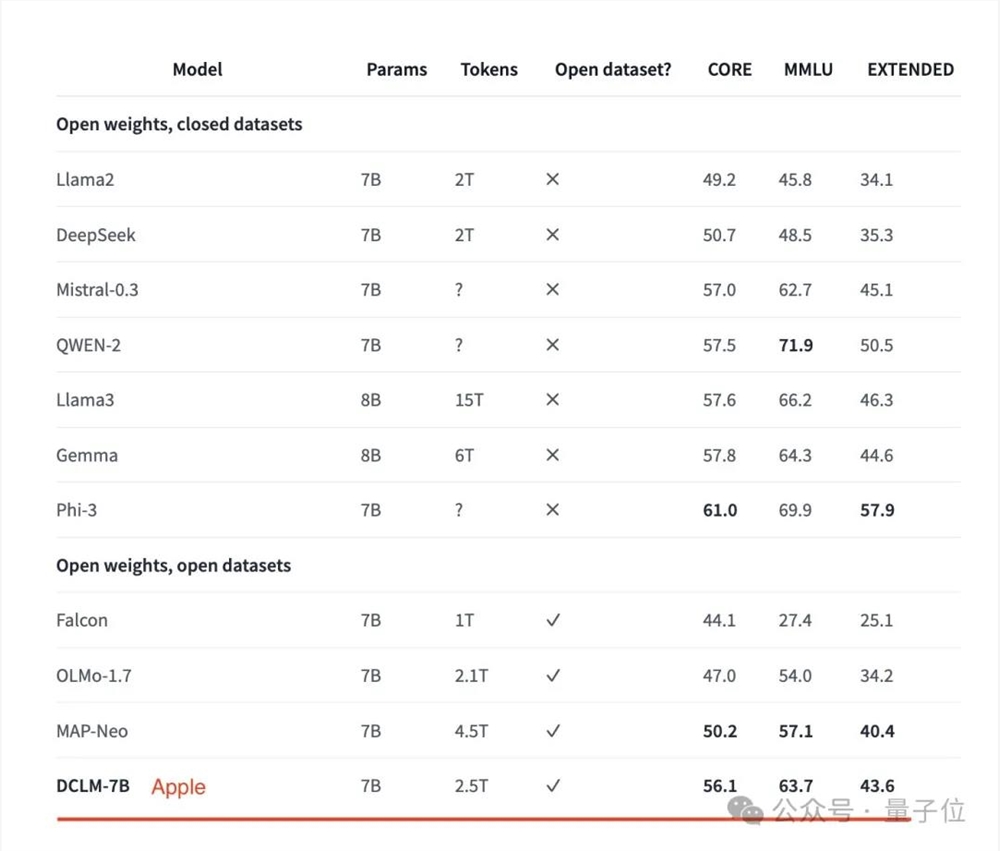

结果显示,它在MMLU基准上5-shot准确率达64%,可与Mistral-7B-v0.3(63%)和Llama38B(66%)相媲美;并且在53个自然语言理解任务上的平均表现也可与Llama38B相媲美,而所需计算量仅为后者的1/6。

与其他同等大小模型相比,DCLM-7B的MMLU得分超越Mistral-7B,接近Llama38B。

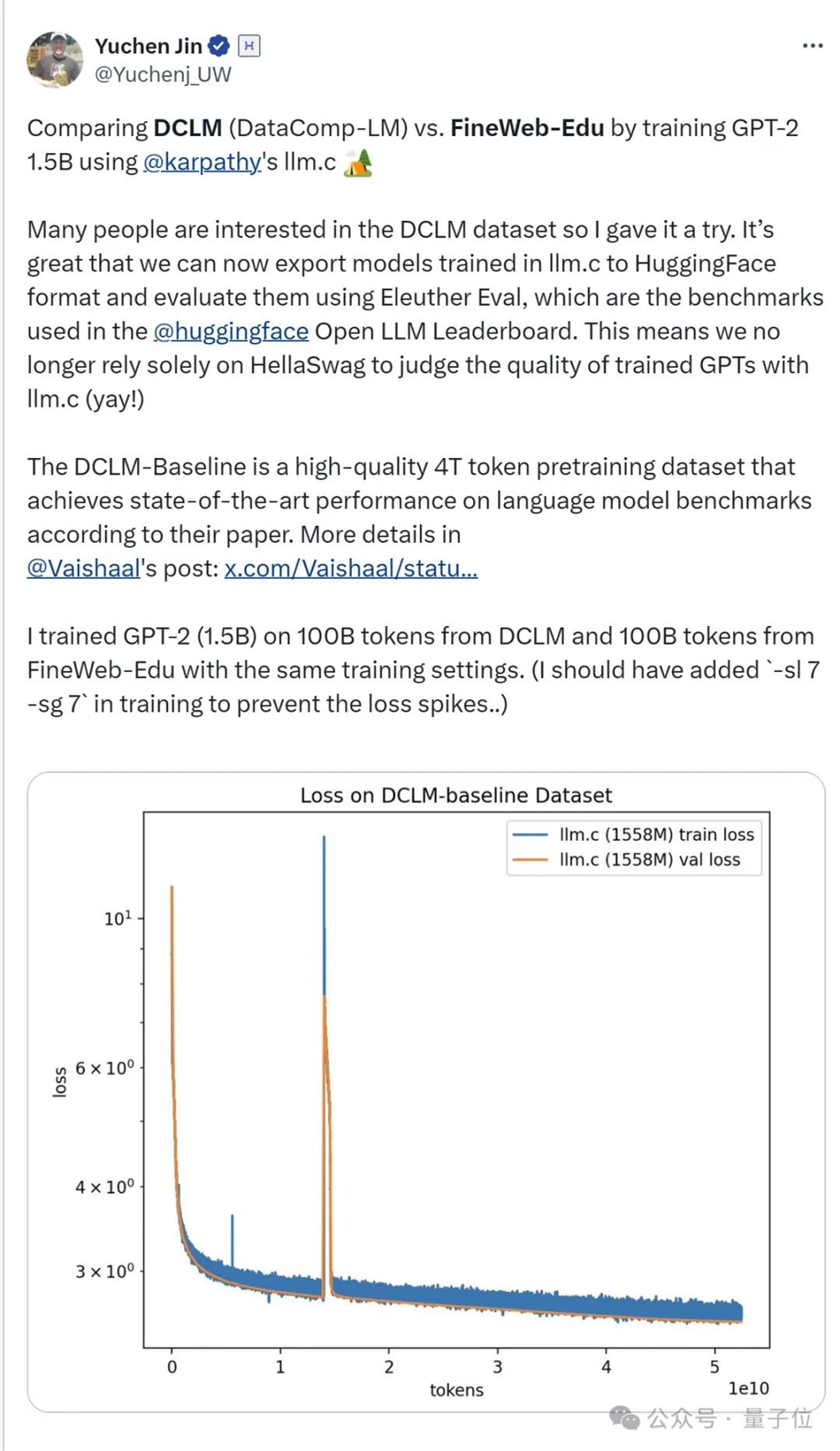

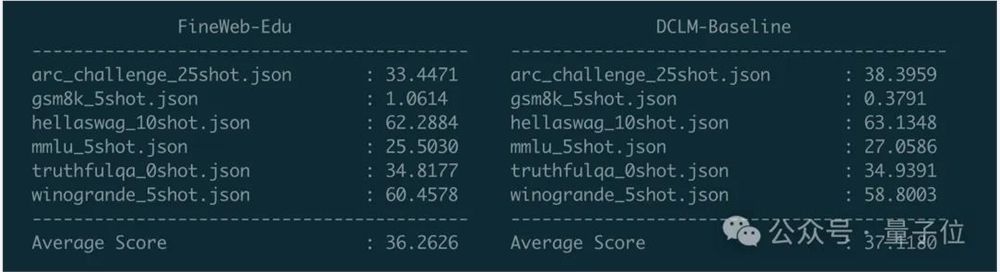

最后,为了测试新数据集效果,有业内人士用卡帕西的llm.c训练了GPT-21.5B,来比较DCLM-Baseline与FineWeb-Edu这两个数据集。

结果显示DCLM-Baseline取得了更高的平均分,且在ARC(小学生科学问题推理)、HellaSwag(常识推理)、MMLU等任务上表现更好。

“小”模型成新趋势

回到开头,“小”模型最近已成新趋势。

先是HuggingFace推出了小模型家族“SmolLM”,其中包含135M、360M和1.7B型号模型。

它们在广泛的推理和常识基准上优于类似大小的模型。

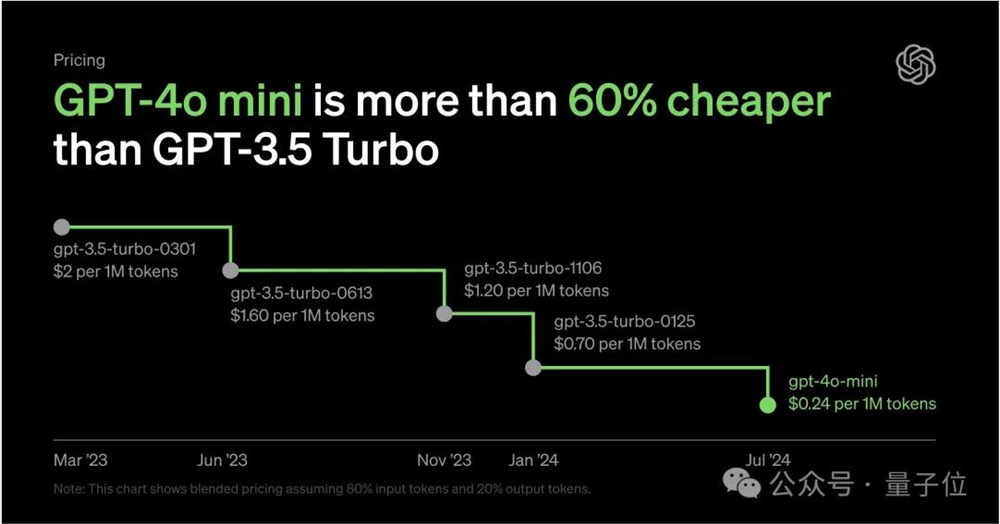

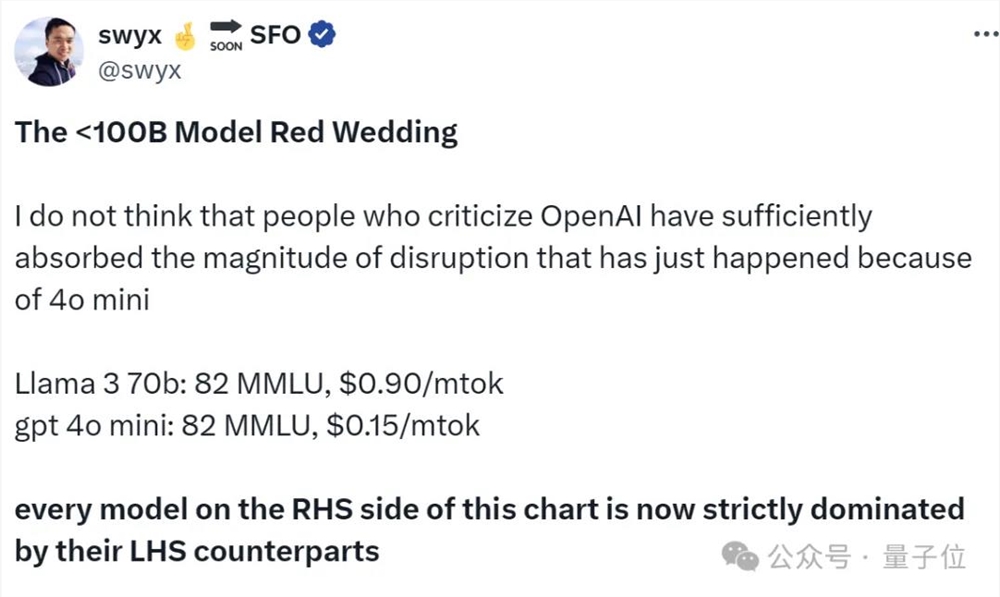

然后OpenAI突然发布了GPT-4o mini,不仅能力接近GPT-4,而且价格大幅下降。

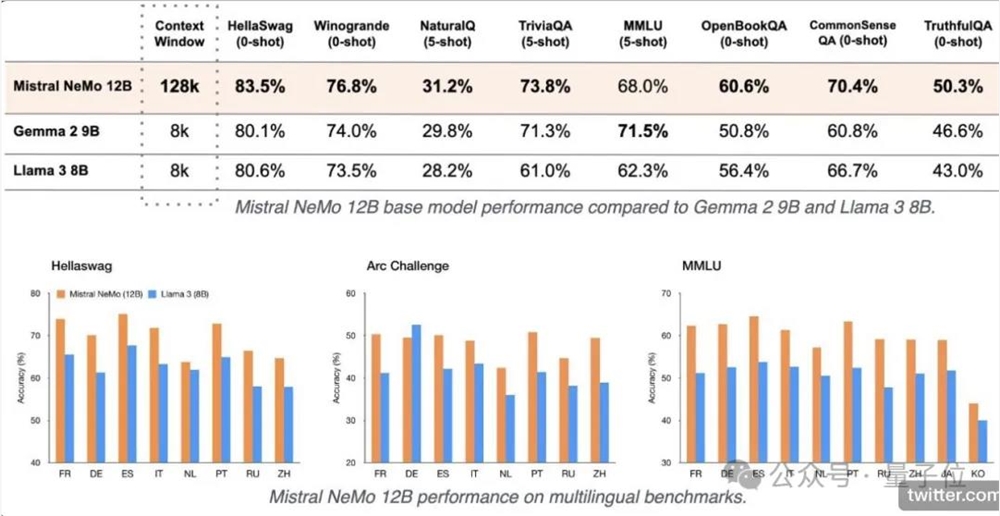

就在GPT-4o mini发布同日,Mistral AI联合英伟达发布了12B参数小模型——Mistral NeMo。

从整体性能上看,Mistral NeMo在多项基准测试中,击败了Gemma29B和Llama38B。

所以,为啥大家都开始卷小模型了?

原因嘛可能正如smol AI创始人提醒的,虽然模型变小了,但在能力相近的情况下,小模型大大降低了成本。

就像他提供的这张图,以GPT-4o mini为代表的小模型整体比右侧价格更低。

对此,我等吃瓜群众be like:

所以,你更看好哪家呢?(欢迎评论区讨论留言)

模型地址:

https://huggingface.co/apple/DCLM-7B

GitHub:

https://github.com/mlfoundations/dclm

数据集地址:

https://huggingface.co/datasets/mlfoundations/dclm-baseline-1.0

参考链接:

[1]https://x.com/Yuchenj_UW/status/1813260100192334108

[2]https://x.com/casper_hansen_/status/1814269340100751382

[3]https://x.com/_philschmid/status/1814274909775995087

[4]https://x.com/LoubnaBenAllal1/status/1813252390692303069

MLPerf放榜!AI芯片公司墨芯人工智能再夺MLPerf大模型推理三项冠军

要点:MLPerf公布最新GPT大模型推理测试结果,墨芯人工智能S30计算卡单卡、4卡、8卡的算力均获得第一。墨芯通过独创的双稀疏算法与硬件协同设计,在GPT-J大模型上取得1.8倍于英伟达H100的性能优势。墨芯的成绩证明,稀疏计算是大模型时代算力发展的关键,可根本解决大模型参数增长与算力瓶颈的矛盾。站长网2023-09-15 09:32:080000什么值得买“AI问答机器人”通过备案 对话式机器人“小值”将上线

近日,值得买科技主营业务什么值得买App的“AI问答机器人”新功能,正式通过国家《生成式人工智能服务管理暂行办法》备案许可。据介绍,什么值得买“AI问答机器人”是一款消费领域垂类产品,将通过对话形式与用户进行交互,旨在为用户提供智能的消费辅助决策服务,根据用户需求指令,帮助用户快速甄选全网优质好物链接。站长网2024-01-25 11:04:540000卢伟冰:小米MIX Fold 3将搭载徕卡光学全焦段四摄

小米卢伟冰宣布,北京亦庄小米智能工厂的「小米智能制造数智系统」2.0正式上线,首款量产机型将是小米MIXFold3。据卢伟冰透露,新制造系统升级非常大,简单说就是更智能、更精密,精度达到微米级,让小米新一代的折叠旗舰做到更薄、更坚固的同时,首次装载进了徕卡光学全焦段四摄。站长网2023-07-04 17:12:130000简单粗暴,日入1000+,小红书国学项目实操拆解

最近,一直没怎么更新,我大部分时间都在做项目,今年最重要的任务,也是要做出一个能自营的项目做基本盘。年初,我觉得同城市场会有机会,于是就做了相亲项目,花费了两个月时间,跑通了抖音相亲粉的流量,但是后端变现方面,拉一个团队做自营对于缺乏婚恋行业销售经验的我来说太难,最终综合权衡下,放弃了这个业务,转做小国学项目。站长网2024-06-05 20:10:200001