Sora并非完美,致命缺点也很多

华尔街日报的知名科技专栏作家Joanna Stern,专访了OpenAI的首席技术官Mira Murati,深度讨论了在今年2月16日发布的,全球爆火文生视频模型Sora。

本次访问少了一些赞美,多了一些“刻薄”。如何解释,Sora明显的缺点?它的训练数据来自哪里?何时上市?如何保证生成内容的安全性?… …

面对Joanna一连串的尖锐问题,有时,Mira只能龇牙咧嘴地含糊而过,或者,尴尬一笑。

Sora并非完美,致命缺点也很多

从访问内容来看,Joanna明显做足了功课拿出了不少Sora的存货,而且都是存在相当大的问题。

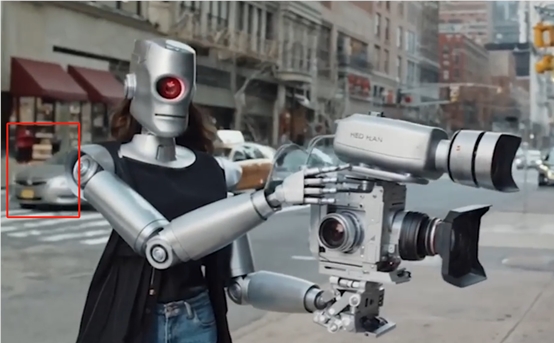

例如,在纽约市的人行道上,一名女性视频制作人手持一台高端电影摄像机。突然,一个机器人把摄像机从她手中夺走。

在这个视频中,Sora并没有完美地理解提示文本语义,没有出现一个机器人抢夺它手中的摄像机,而是直接把女性变成了机器人。这确实有点离谱,连Mira自己都笑了。

此外,背景中的物体会发生根本的变化,还是这个案例,黄色的出租车,在即将走出画面的瞬间,居然变成了灰色汽车。

这说明,Sora对视频中物体的控制性并不稳定,一些小的物体大概只能持续几秒的时间。

Mira给出了差不多的解释,同时表示,未来Sora可能会推出视频修复功能。可以让用户自行的对视频的一些小瑕疵进行修复,以满足实际的业务需求。

,时长00:48访谈视频片段

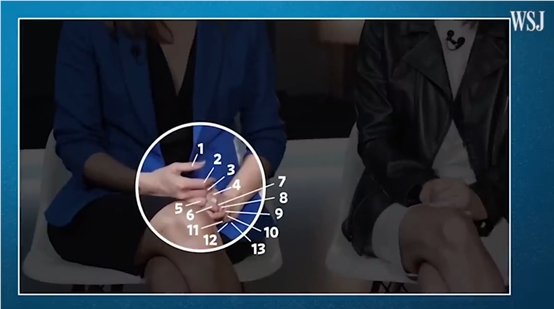

另外一个案例就更夸张了,由Sora生成的两个商务女士正在交流,表面看上去一切都很真实,细看之后才发觉恐怖,左面穿蓝色的女生居然出现13根手指(一共15个),并且像麻花一样纠缠在一起,六指琴魔见了都得喊一声前辈。

Mira表示,让Sora模拟手指这种细腻动作确实非常困难,不容易捕捉。

其实,这个问题不止在文生视频领域,在早期的文生图领域也很常见。

例如,去年的Stable Difusion、Midjourney在生成人物时整体都很好,就是手指不过关。

这主要是有3大原因:1)相比人体的大结构,手指的形状、大小、位置及与其他手指的关系极其复杂多变。

每个人的手指长度、宽度、关节弯曲度等都有所不同,而且手势的变化也极为丰富,使得大模型在训练、模拟方面非常困难。

2)大多数的图片、视频训练数据,在内容上有很大的差异,人脸和身体的部位,远远多于手部的特写内容。例如,我们很少能看到只有一只手的视频或者图片(广告可能会多一些)所以,大模型在学习、模拟手指等细节比较难,生成的能力也就偏弱。

3)即便使用了Transformer这种善于捕捉空间、依赖关系、特征提取的模型,但手指这样复杂、多变的物体来说也不容易,例如,手指的长短、粗细、相互间距等,都需要大模型精确生成才能达到真实感的效果。

需要注意的是,图片是静态的,而视频是动态的同时需要实时保持物体的一致性和连贯性,在技术实现方面更是难上加上。所以,在一定时间内,Sora面临解决的细节问题真不少。

Joanna还指出,目前Sora生成的视频全部没有声音,从应用场景来看这是一个很大的缺陷。

Mira则表示,Sora最终会生成带声音的视频,但这都需要时间来实现。

Sora训练数据来源

在Sora生成1分钟视频后,很多人都好奇,OpenAI到底在哪里搞到的,如此强悍的训练数据?

Joanna直截了当的问道:“Sora的训练数据来自哪里?”

Mira:我们使用的公开许可数据。

Joanna:使用的是YouTube、Facebook等上的数据?

Mira:听后,只能回答不确定并咧嘴。

随后说道,“我们使用的是公开数据,是那些允许使用的。但我也不太确定。”

其实也能理解Mira的苦衷。数据作为生成式AI领域的“黄金”,是各家厂商打造特定领域大模型的秘密武器之一,轻易是不会透露的。

并且微软、Meta、谷歌等巨头,用实际发布的大模型证明了,经过高质量数据训练的模型,即便参数很小,但性能依然可以战胜那些大参数的模型,可见训练数据的重要性。

最近,OpenAI也因为数据版权的问题惹上了好几起官司,Mira可不想再为公司带来麻烦。

不过,华尔街日报补充说明,在采访的结尾Mira确认了Sora的训练数据,来自Shutterstock,并已与OpenAI签订了数据合作协议。

Shutterstock创立于2003年,总部位于美国纽约,2012年成功上市。Shutterstock是全球最大的免版税的图片、视频分享平台之一。

目前,Shutterstock有超过2亿张高清图片,超过1000万个高清、4K视频片段,是训练图片、视频模型的宝贵数据来源之一。

Sora算力需求太大,短期内不会上市

Sora生成一个20秒720P的视频需要多少时间?Mira给出了答案,大约需要几分钟。

如果是1000、10000个人一起使用Sora生成视频呢?那将需要非常、非常庞大的AI算力。要是全球用户一起使用呢,估计Sora自己得先自爆。

Mira表示,与ChatGPT、DALL·E3相比,Sora的算力需求呈指数级增长。所以,在保证性能、推理效率、响应度的前提下,降低Sora的算力需求是首要任务之一。

OpenAI期望的是,在Sora最终上市时,能达到和DALL·E3相当的算力成本就算成功。

同时Mira给出了Sora上市时间:“可能是今年,还需要几个月时间。可以肯定的是,保证不是11月,OpenAI不想AI产品扰乱美国大选。”

这期间包括安全团队对Sora的深度测试以及优化,希望在正式上市时,不会生成一些存在争议、违规的内容,并且大模型的安全性,将是OpenAI持续深耕的重要领域。

谷歌斥资数十亿美元裁员

划重点:⭐️谷歌在2023年裁员1.2万名员工,耗资21亿美元⭐️在2024年1月份已经花费7亿美元进行员工裁员⭐️尽管裁员,谷歌核心业务线依然呈现增长谷歌在2023年裁员1.2万名员工,耗资21亿美元。而在2024年1月份,仅这一个月,公司已经花费了7亿美元用于员工裁员。站长网2024-01-31 09:43:290000日本政府测试使用ChatGPT更新网站数据

前不久,OpenAICEOSamAltman会见日本首相岸田文雄,并就在日本测试使用ChatGPT一事进行讨论,以解决隐私和版权等关键问题。据了解,ChatGPT将帮助更新用于填写补贴和公共援助申请的在线手册。据说这涉及数千个网站,每年都需要对这些网站进行监管更改。现在,这项繁琐的任务将交给给OpenAI的聊天机器人。站长网2023-04-20 09:44:590000癌症早筛,这回轮到中国AI表演了

中国AI,再次吸引大洋彼岸关注。日前,斯坦福大学发布了《2024年AI指数报告》,透露2023年美国人工智能投资额为672亿美元,是中国的约8.7倍;其中,阿里达摩院(湖畔实验室)医疗AI凭借在大规模胰腺癌早筛上的突破,成为唯一来自中国科技公司的AI亮点研究。这意味着,AI寻癌,中国走到了世界的前列。站长网2024-04-27 17:40:500000腾讯会议免费时长将缩短至40分钟:2人会议不限时

快科技10月21日消息,腾讯会议官方发布通知,后续将对免费版单场会议时长进行调整,将逐步调整为40分钟,同时将推出权益更丰富的专业版及商业版。腾讯会议产品团队表示,为了优化资源分配,腾讯会议免费版单场会议时长将逐步调整为40分钟(2人会议不限时),请用户提前做好规划。站长网2024-10-21 20:38:230000“西湖心辰”获“汤姆猫”过亿元战略投资 正式推出“西湖大模型”

近日,“西湖心辰”宣布获得“汤姆猫”战略投资,投资金额超过亿元。此次融资后,西湖心辰将与汤姆猫加速在通用大模型、垂直领域模型及终端软硬件等方面的合作。汤姆猫表示,与其他大模型相比,西湖大模型具备长期记忆、情感感知和主动对话等功能,并且融合了文字、图片、语音等多种模态,与汤姆猫的场景和未来规划高度契合。双方正在加速大模型的应用落地,共同推出汤姆猫系列产品,实现听、看、说、教学和陪伴的功能。站长网2023-07-10 18:31:480000