董宇辉独立直播间首播:1小时涨粉105万,带货值抖音第一

1月9日消息,今日晚间19时00分,董宇辉抖音独立账号「与辉同行」正式首播,开播不到半分钟观看人数高达10万 ,人气榜和小时榜双榜全平台第一。

本场直播主题为“2024从心出发”,将由与辉同行账号的常驻主播传熙、盼盼、鹏鹏、安安、汉森、董董、潇潇集中亮相,董宇辉和俞敏洪的双人对话两个部分组成。

直播开场,与辉同行的主播团队进行了自我介绍,各个主播都以表演才艺的方式完成了首次亮相,其中有东方甄选团队的熟人,也有刚刚走向台前的新人。

同时,董宇辉还简要介绍了与辉同行的重点板块设置,包括文旅、图书、名人对谈、社会公益等。

直播初始,便有不少弹幕主动喊话董宇辉让其赶紧带货,有弹幕还直言是带着任务来直播间——买货。

在19时40分,董宇辉开启与辉同行的第一次带货,据抖音平台实时数据显示,不到10分钟,该直播间带货总榜的排名迅速攀爬到第一名,带货值高达1400余万,远超第二名的400余万。

在20时许,俞敏洪做客直播间再次与董宇辉同框带货。直播中,两人之间的话题更多的是由产品延伸出来的闲聊,很少提及小作文事件和与辉同行发展相关事宜。

不过,俞敏洪在谈及与辉同行成立时感叹道,如果没有「小作文」事件这个波折,与辉同行不可能这么快成立起来。“尽管直到现在也不希望那次事情发生。”

事实也确实如此,从俞敏洪提出为董宇辉打造新的独立平台到与辉同行上线,时隔仅10天,堪称光速。

12月16日晚间,在「小作文」事件后,董宇辉首次亮相与俞敏洪对谈,后者承认,东方甄选对董宇辉是不公平的,限制了他的发展,并表示希望能够给董宇辉一个更好发挥空间的机会,更多的职权,能带领更多的人一起发展。

12月18日,俞敏洪与董宇辉再次联袂直播,而此次直播董宇辉以东方甄选高级合伙人、新东方集团董事长助理、东方文旅副总裁的多层新身份正式亮相。同时,俞敏洪也明确表示将为董宇辉成立独立工作室。

12月22日,与辉同行(北京)科技有限公司成立,注册资本1000万人民币,董宇辉为法定代表人、执行董事、经理,俞敏洪担任监事,孙东旭为公司法定代表人,股东信息显示,该公司由北京新东方迅程网络科技有限公司全资持股。

12月26日,董宇辉独立公司抖音官方账号与辉同行上线。

当然,与辉同行之所以能够拔地而起少不了网友们和业内人士的推波助澜,但董宇辉自身的所作所为才是关键。

据悉,在东方甄选2021年12月面世初期,6个月才堪堪把粉丝积累到百万,而董宇辉在2022年6月爆火出圈,几天时间粉丝就暴涨1000余万,吸粉速度宛如病毒传播。爆火期间连带着股价也水涨船高,仅仅几天时间东方甄选的涨幅抵消了2021年以来的所有跌幅。

彼时的董宇辉为东方甄选所做的贡献几乎可以用「扶大厦之将倾,挽狂澜于既倒」来形容。在网友们来看,董宇辉力挽狂澜的表现,理应得到优渥的待遇和相应的高职。

民心所向,胜之所往。相信俞敏洪也懂得其中的道理,所以才会有后来挥泪斩马谡的戏码。

12月16日,东方甄选发布人事任免通知,俞敏洪兼任东方甄选CEO,免去孙东旭CEO职务。

12月22日,东方甄选董事会宣布,孙东旭已辞任公司非执行董事一职,即时生效。

从后来网友的反应以及今日与辉同行直播的火爆来看,彼时俞敏洪的处理结果不可谓不果断与正确。

据鞭牛士观察,与辉同行直播间19时整,粉丝数达418万,截止到20时整,粉丝数达523万,1个小时涨粉105万。

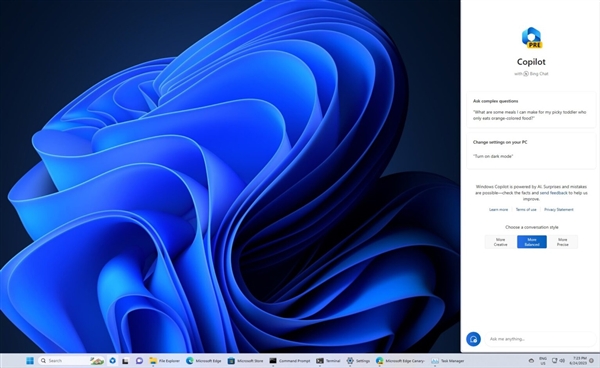

Win11或将巨变:系统级AI工具Copilot有望本月开启测试

快科技6月26日消息,在此前的Build2023大会上,微软曾宣布,将为Windows11带来系统级AI工具WindowsCopilot。目前,有消息称,WindowsCopilot有望在本月面向WindowsInsider计划中的测试人员提供服务,且早期版本的截图已经流出。站长网2023-06-27 17:06:470001吸粉700W,“精致女生”统治家居赛道

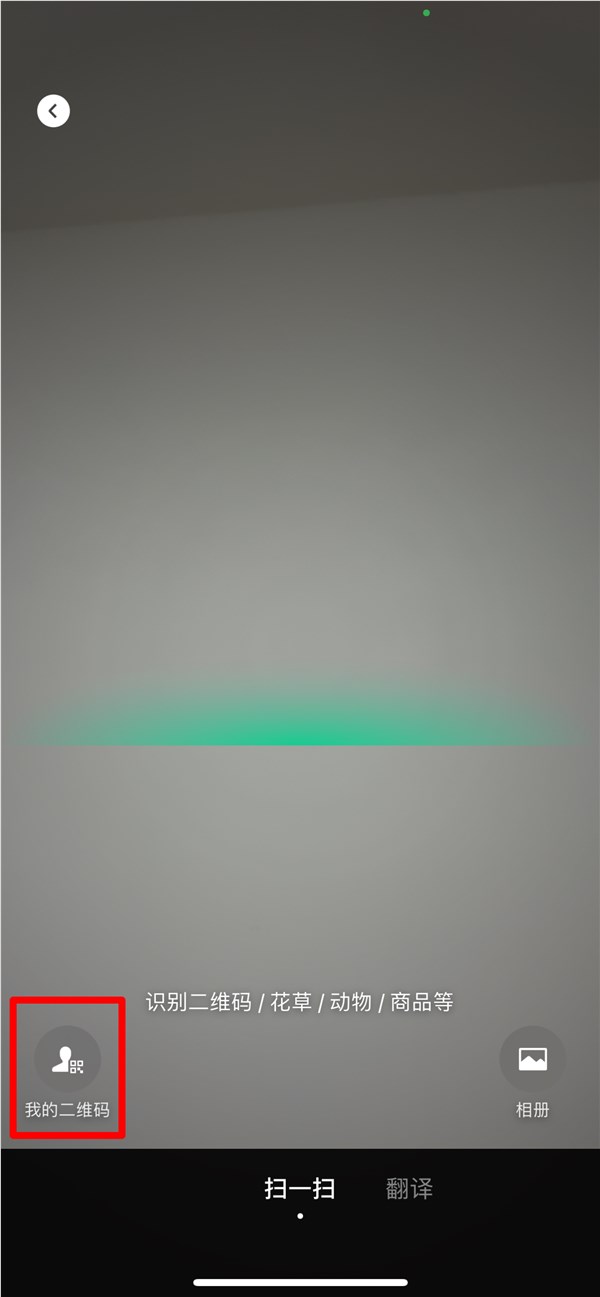

坐高铁出行,统共分为几步?知识科普博主@打工仔小张可能会告诉你,乘坐高铁的全流程包括安检、候车、检票、寻找车厢、入座等。但对精致系博主而言,事情显然没那么简单。在一系列以“精致女生坐高铁”命名的视频中,博主们首先要骑着电动智能行李箱闪亮登场,在车厢内找到对应铺位后,要先将包包挂好,再拿出消毒喷雾,将座位里里外外喷洒一遍,然后用便携消毒湿巾擦洗一番车窗和小桌板。站长网2024-08-19 17:35:420000微信扫一扫加好友有讲究吗?官方:可以丝滑切换

近日,网络上关于“微信扫一扫加好友有讲究吗”的讨论异常热烈,仿佛一个简单的加好友动作,背后隐藏着无数的社交礼仪和技巧。那么,在加微信好友时,究竟是我扫你还是你扫我?微信官方为我们解答了这一疑惑,并提供了实用的操作指南。站长网2024-05-24 10:21:020003马毅团队新研究:微调多模态大模型会灾难性遗忘

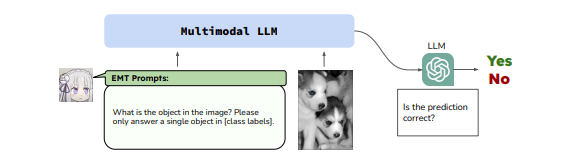

要点:1.马毅团队提出了EMT框架,评估微调后的多模态大模型(MLLM)的灾难性遗忘。2.实验表明,微调MLLM在提升微调数据集性能的同时,也导致其他数据集性能下降。3.微调过程中,MLLM会产生与微调数据集相关的幻觉文本,忽略原始问题。站长网2023-09-28 10:29:530000