一条磁力链接席卷AI圈,87GB种子直接开源8x7B MoE模型

「高端」的开源,往往采用最朴素的发布方式。

昨天,Mistral AI 在 X 平台甩出一条磁力链接,宣布了新的开源动作。

没有长篇官方博客,没有刻意加速的 Demo,这家公司算是当下大模型领域的「一股清流」。

打开一看,发现是接近87GB 的种子:

参数配置什么样?很多人放弃了周末,第一时间下载运行起来。

看上去,Mistral8x7B 使用了与 GPT-4非常相似的架构,但是「缩小版」:

8个专家总数,而不是16名(减少一半)

每个专家为7B 参数,而不是166B(减少24倍)

42B 总参数(估计)而不是1.8T(减少42倍)

与原始 GPT-4相同的32K 上下文

在发布后24小时内,已经有开发者做出了在线体验网站:https://replicate.com/nateraw/mixtral-8x7b-32kseqlen

有研究者称:「闭源大模型走到结局了。」

这周已经引发群嘲的谷歌,也再次被 Cue 到:

专家混合 (MoE) 是 LLM 中常用的一种技术,旨在提高其效率和准确性。这种方法的工作原理是将复杂的任务划分为更小、更易于管理的子任务,每个子任务都由专门的迷你模型或「专家」处理。

具体来说,「专家层」是较小的神经网络,经过训练在特定领域具有高技能,每个专家处理相同的输入,但处理方式与其特定的专业相一致;「门控网络」是 MoE 架构的决策者,能评估哪位专家最适合给定的输入数据。网络计算输入与每个专家之间的兼容性分数,然后使用这些分数来确定每个专家在任务中的参与程度。

我们都知道,OpenAI 团队一直对 GPT-4的参数量和训练细节守口如瓶。早些时候,有人爆料 GPT-4是采用了由8个专家模型组成的集成系统。后来又有传闻称,ChatGPT 也只是百亿参数级的模型(大概在200亿左右)。

传闻无从证明,但 Mistral8x7B 可能提供了一种「非常接近 GPT-4」的开源选项。从模型元数据中可以看出,对于每个 token 的推理,Mistral8x7B 仅使用2个专家。

更让人感觉有趣的是,这是该公司官方账号自开通以来发布的第三条内容,两次重要发布均无文字说明,配图什么的更是不存在:

9月底的那条链接发布的是 Mistral7B,该模型至今仍被称为「最好的7B 模型」,在每个基准测试中都优于 Llama-213B,并且在代码、数学和推理方面优于 LLaMA-134B。

Mistral AI 成立于2023年5月,是一家法国人工智能初创公司,也是为数不多来自欧洲的大模型开源领域的明星团队。

Mistral AI 曾在6月获得了创纪录的1.18亿美元种子轮融资,还是在仅有7页 PPT 的情况下,据说这是欧洲历史上最大的种子轮融资。

公司创始人之一 Arthur Mensch 曾在10月份向《金融时报》表示,Mistral AI 的技术比美国的一些强大竞争对手开发的技术更高效、成本更低。

技术实力的优越,也为这家公司带来了投资者的持续关注。

近日,《金融时报》报道了 Mistral AI 新一轮融资的动态:新一轮融资约4亿欧元,主要由股权组成,可能在下周官宣。目前,公司的最新估值在20亿欧元左右。

知情人士透露,新一轮融资由硅谷著名风投 Andreessen Horowitz 牵头,其他参与者还包括英伟达、Salesforce、General Catalyst、法国巴黎银行等。

Mistral AI 的其他投资者还包括谷歌前 CEO 埃里克・施密特 (Eric Schmidt)、法国电信亿万富翁泽维尔・尼尔 (Xavier Niel) 和法国国家支持的投资银行 Bpifrance。

这篇报道还提到,Arthur Mensch 表示「虽然公司尚未赚到任何钱,但预计这种情况将在年底前发生改变,因为该公司准备了一个新平台,供客户访问其人工智能模型。」

参考链接:https://www.ft.com/content/ea29ddf8-91cb-45e8-86a0-f501ab7ad9bb

小米称三层镀银玻璃不影响手机信号:已经过多轮实测

小米汽车在其最新一期的答网友问环节中,针对小米SU7的热点问题进行了解答,特别是关于网传车辆前风挡玻璃采用的三层镀银技术是否会干扰手机信号的疑问。小米汽车澄清,该三层镀银技术实际上是一种防晒措施。他们的合作伙伴福耀玻璃,一家上市公司,也在其投资者互动平台上对此事进行了说明。小米SU7的前风挡玻璃在镀膜后,会经过激光除膜处理,为ETC、GPS等电子设备预留信号接收窗口,确保信号的畅通无阻。站长网2024-07-19 11:07:130001Google Photos 更新加入生成式人工智能改进「回忆」功能

站长之家(ChinaZ.com)8月16日消息:谷歌相册(GooglePhotos)今天发布了一次重大的更新,推出了重新设计的导航栏和改进的「回忆」功能。图片来自Google在谷歌发布的一篇博客文章中,谷歌表示,在移动端的谷歌相册中,新的更新将为现有的「回忆」功能引入一个新的「像剪贴簿一样」的视图。这个更新将允许用户根据具体的日期、事件和话题来查看分组的照片和视频。站长网2023-08-16 09:57:080000正新鸡排否认资金链断裂:目前一切经营正常

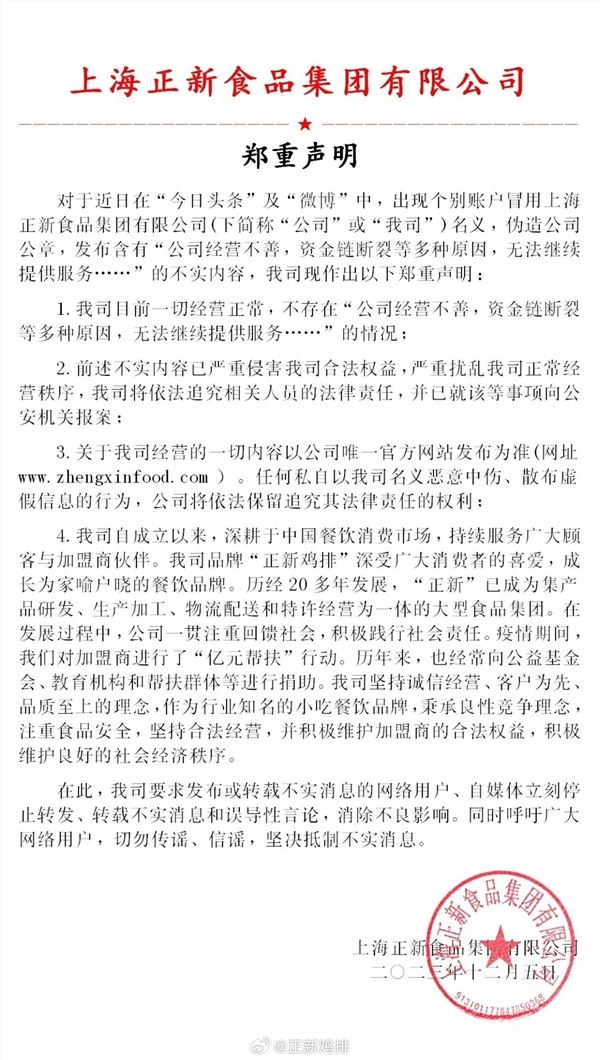

正新鸡排官方微博发布声明,坚决否认了关于其资金链断裂、无法继续提供服务的传言。官方表示,这些不实传闻已经严重侵害了公司的合法权益,扰乱了正常的经营秩序。正新鸡排官方呼吁广大网络用户,不要传播和相信这些不实消息,坚决抵制不实消息。以下是声明原文:站长网2023-12-06 13:52:310000古生物学家发现4.5亿年前海洋中的凶猛“捕手”,长这样→

远古发现丨4.5亿年前,这种远古“萌物”竟是海洋中的凶猛“捕手”记者从中国科学院南京地质古生物研究所获悉,该所研究人员与英国古生物学者合作,在我国浙江省安吉县发现一种约4.5亿年前的远古节肢动物——安吉古鲎。安吉古鲎长着圆滚滚的脑袋,外形非常可爱。不过,它其实是当时海洋中的一种凶猛肉食动物,堪称远古海洋中的“萌系霸主”。安吉古鲎复原图(中科院南京地质古生物研究所杨定华绘)站长网2023-05-23 19:43:300000亚太地区 70% 的企业高管正探索生成式 AI 应用或已经进行投资

在最近的IDC报告《ApplicationsofGenerativeAIinCustomerExperience(生成式AI在客户体验中的应用)》中,IDC讨论了生成式人工智能(GenAI)在客户体验(CX)领域的应用,并探讨了其对CX的影响。IDC的FERS2023调查结果显示,亚太地区70%的高管正在探索生成式人工智能的应用案例或已经进行投资。站长网2023-07-12 09:10:010000