智源发布FlagAttention算子集 适配多种大模型训练芯片

站长网2023-12-08 15:01:411阅

为了满足大模型对计算资源的需求,智源研究院开发了 FlagAttention 项目,旨在构建一套适配多种芯片的大模型核心算子集合。

该项目选择使用 Triton 作为开发语言,通过 Triton 的开放性和易用性,使得 FlagAttention 不仅支持 NVIDIA GPU,还可以显著降低不同芯片之间模型适配的成本,提高大模型的训练与推理效率。

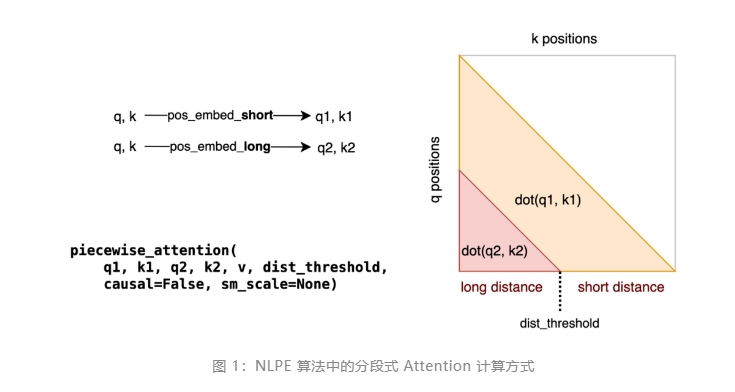

FlagAttention 目前包含两个算子:piecewise_attention 和 flash_attention。

其中,piecewise_attention 是针对长文本模型的分段式 Attention 算子,而 flash_attention 是基于 Triton 的高效 Multihead Attention 实现。

通过 FlagAttention,希望能够消除现有 AI 生态中的软件壁垒,让更广泛的模型用户能够使用到最新的模型优化技术。

未来,FlagAttention 还将支持更多功能,并与其他芯片厂商合作,优化算子的性能和适配。

项目地址:

https://github.com/FlagOpen/FlagAttention

https://github.com/FlagOpen/FlagAttention/issues

0001

评论列表

共(0)条相关推荐

马斯克成2023年全球挣钱第一人:身价暴涨7700亿

快科技12月23日消息,2023年,对于许多普通人来说相当的不易,但对于一些超级富豪来说,他们的身价却像火箭一样直线上升。《福布斯》最近公布了2023年财富增长最多的10位亿万富豪。截至2023年12月15日,这十位富豪的身家总计增加了4900亿美元(约合人民币3.5万亿元)。0000OpenAI将在伦敦开设办事处 吸纳顶尖人才

OpenAI将在伦敦开设其首家国际办事处,这标志着其发展战略的又一重要一步。这家人工智能公司将伦敦的文化多样性和令人印象深刻的人才储备作为选择的关键原因,OpenAI认为这些特点非常适合扩大其研发能力。具体而言,OpenAI计划在伦敦建立跨研究、工程和市场部门的团队。站长网2023-06-29 15:59:430001知乎宣布将下线“匿名功能” 将取消“匿名发布”入口

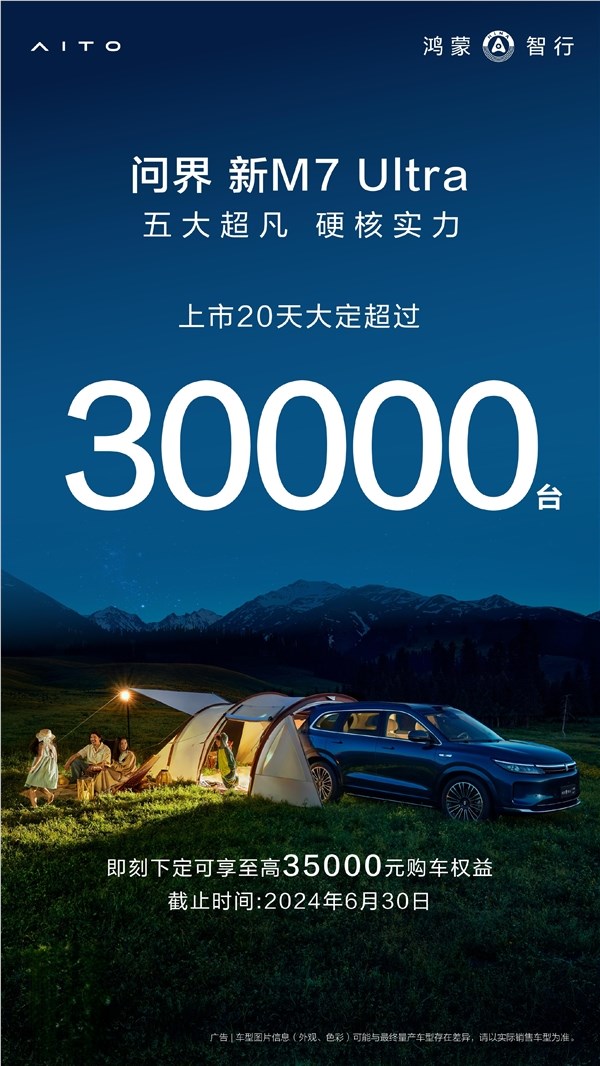

知乎宣布将下线“匿名功能”,知乎表示,匿名功能的上线初衷是为了让用户能够开放讨论、友善互动。然而,随着互联网沟通环境日益复杂,为了保障社区内的良性讨论,知乎已经在最新版本的应用程序中完成了匿名功能下线的开发。该更新预计将于近期提交给各大应用商店审核,并在7月14日正式上线。站长网2023-07-08 17:08:230001华为再造爆款!问界新M7 Ultra上市20天大定超3万台

快科技6月21日消息,据鸿蒙智行官方消息,问界新M7Ultra上市20天大定超3万台,妥妥站稳了高端。值得一提的是,就在昨日,官方宣称,问界新M7Ultra上市18天交付突破1万台,创造中国新势力车型交付纪录!问界新M7Ultra的售价区间为28.98-32.98万元,相较于新M7售价上涨了4万元,那既然如此,为何还会受到追捧?实际上也跟自身升级巨大有关。站长网2024-06-21 21:30:440000美团直播:排头兵先行,主力军未动

折扣给得扎实,用户薅得开心,商家进度“参差不齐”。“1.5元买到了甜啦啦的冰鲜柠檬水”“6元拿下原价16元一杯的Tims鲜萃咖啡,咖啡爱好者的快活”“抢到了6份一块钱的古茗,还有1份1块钱的瑞幸美式咖啡”在刚过去的7月18日美团“神券节官方直播间”开播当日,不乏有美团用户在小红书上兴奋得分享着“战利品”。继八年前的“外卖大战”后,“个位数点外卖”的“羊毛”又重出江湖了。站长网2023-07-21 22:05:350000