Meta发布Emu Video和Emu Edit 将颠覆文本到视频生成和图像编辑领域

**划重点:**

1. 🎨 **Emu Edit**:革新图像编辑,通过文本指令实现精细控制,类似Adobe Photoshop的"生成填充"功能,支持局部和全局编辑、背景添加或移除、颜色和几何变换、物体检测和分割。

2. 🎥 **Emu Video**:简化文本到视频生成,基于扩散模型,能够通过文本、图像或两者的输入生成视频,为社交媒体平台用户提供创造动画贴纸和GIFs的可能性。

3. 🌐 **影响力**:这些AI工具将影响用户在社交媒体平台上与图像和视频互动的方式,潜在应用包括创作自己的动态贴纸和编辑照片,拓展了艺术性可能性。然而,工具仍在开发中,尚无发布时间表。

站长之家(ChinaZ.com)11月17日 消息:Facebook和Instagram的母公司Meta宣布在人工智能内容创作和编辑工具领域取得了重大进展,推出两项创新性工具:Emu Edit用于图像编辑,Emu Video用于视频生成。

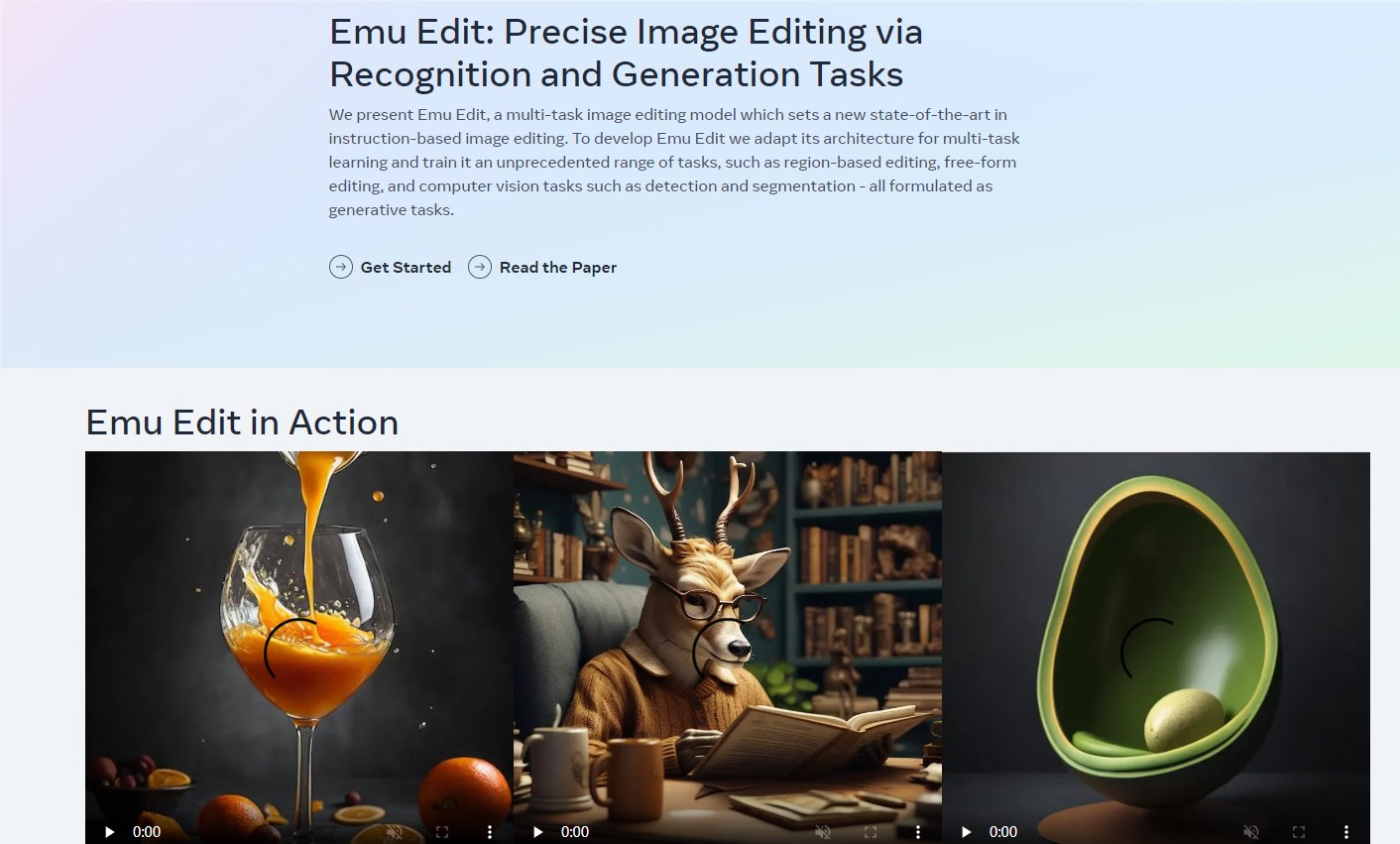

Emu Edit:提升图像编辑标准

Emu Edit的首次突破旨在为用户提供对图像编辑的精细控制。它采用一种独特的图像处理方式,用户通过文本指令进行图像修改,类似于Adobe Photoshop目前提供的“生成填充”功能。

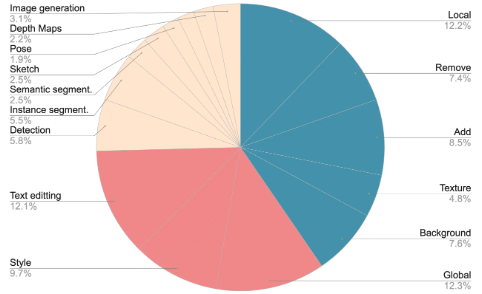

该工具能够执行多种编辑任务,包括局部和全局编辑、添加或删除背景、颜色和几何变换、物体检测以及分割。Emu Edit的目标是仅修改与编辑请求相关的区域,确保不影响无关的像素。

Meta的研究人员在最新公告中强调:“主要目标不应只是生成一个可信的图像,而应专注于精确地修改仅与编辑请求相关的像素。”

Emu Edit是通过一个包含1000万合成样本的庞大数据集进行训练的,使其能够在指令忠实度和图像质量方面提供高质量的结果。例如,用户可以输入文本“Aloha!”以添加到棒球帽的图像中,而Emu Edit会在不修改帽子本身的情况下完成此任务。

体验网址:https://emu-edit.metademolab.com/

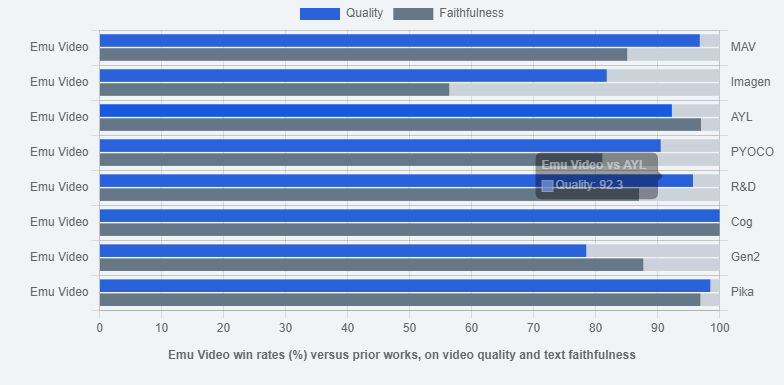

Emu Video:简化文本到视频生成

除了图像编辑,Meta的AI团队还在改进视频生成。基于扩散模型的Emu Video工具为文本到视频生成提供了简便方法。它对各种输入做出响应,包括仅文本、仅图像或两者兼而有之。

视频生成过程包括创建一个由文本提示条件化的图像,然后根据该图像和另一个文本提示创建视频。如果您有兴趣尝试新的Emu Video编辑工具,您可以立即尝试在线演示。体验网址:https://emu-video.metademolab.com/

对内容创作的深远影响

这些创新将改变用户在社交媒体平台上与图像和视频互动的方式。例如,用户可以创建自己的动画贴纸和GIF,或编辑照片而无需依赖诸如Photoshop之类的复杂工具。然而,值得注意的是,这些工具仍在开发中,尚未正式宣布在Facebook和Instagram等平台上的发布时间。

对于Meta来说,Emu提供的工具代表着生成式AI领域不断增长的动力,与Make-A-Video和AI图像生成器DALL-E等现有项目相辅相成。作为公司在辅助AI方面不断挑战极限的一部分,它旨在提供直观的功能,为普通用户拓展艺术可能性。

Emu Video和Emu Edit的发布也是Meta推动其应用程序家族中用户参与的战略的一部分。通过平台内编辑和创作,Meta将用户更深入地锁定在其社交生态系统中。

尽管这些新工具承诺更多创造力,但围绕AI伦理和内容监管仍然存在问题。与其他生成模型一样,Emu将需要监管以防止潜在的滥用。Meta表示,在快速发展的生成式AI进程中,安全措施仍然是首要任务。

目前,Emu Video和Emu Edit仍在开发中,尚无公开发布时间表。但Meta公司积极进行的生成式AI研究表明,更具变革性的社交媒体体验可能在不久的将来实现。随着AI合成的成熟,用户或许有朝一日可以像发送短信一样直观地产生专业级别的内容。

项目网址:

https://emu-video.metademolab.com/

https://emu-edit.metademolab.com/

荣耀 X50 今日开售 1399元起搭载骁龙 6 Gen 1

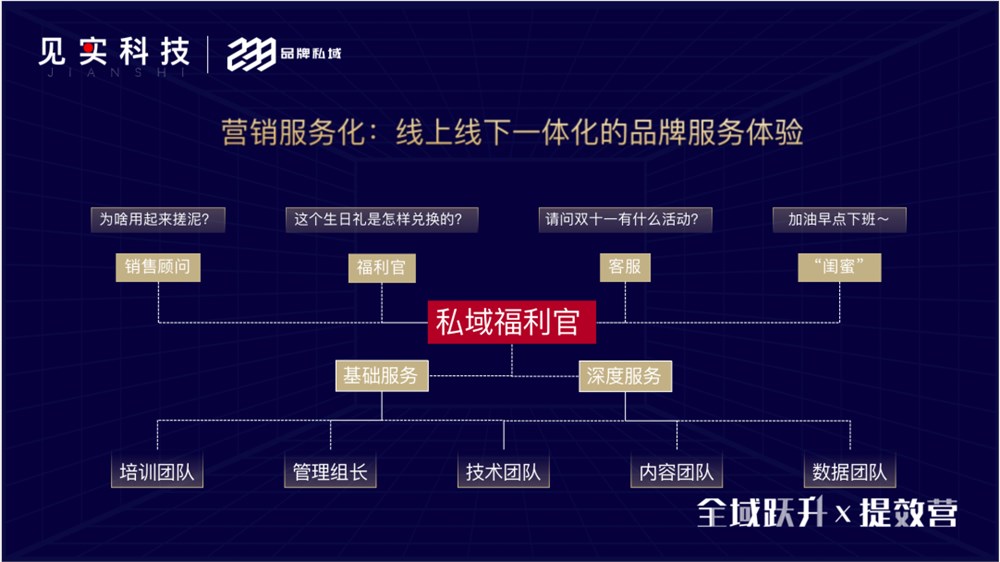

荣耀X50手机在今天上午10:08开始了首销,这款手机搭载了高通骁龙6Gen1处理器,售价从1399元起步。站长网2023-07-14 16:20:400000这两件事值得品牌私域投入3到5年做!

“线上导购”又被称作EBA,是美妆行业对在线导购常用称呼。将线上导购和线下导购分开管理,已是大多数美妆品牌的基础私域运营策略。不同于现在导购,EBA不仅要有专业度,还要懂网聊。在看不到真实用户,无法面对面交流的情况下,通过在线对话来调动用户购买欲,就需要全新的应对策略和导购培训体系。站长网2023-05-29 14:02:140000三星下一代折叠手机将于 7 月 26 日上市

三星今日官宣,将于7月26日19点举行Galaxy全球新品发布会,发布第五代折叠屏旗舰。我们可以从公布的图片上看到一款翻盖式可折叠手机,这应该就是备受期待的GalaxyZFlip5,ZFold5了。目前,三星GalaxyZFold/Flip5已经通过国家质量认证,均配备25W充电器,并且搭载3.36GHz的骁龙8Gen2forGalaxy芯片。站长网2023-07-06 16:33:380001重磅:微信小店灰测“送礼物”功能!

于12月18日深夜,微信团队公告称,微信小店正式开启“送礼物”功能的灰度测试。不过,名虽“灰测”,细读公告能发现,除珠宝、教育培训两大类目外,其他类目微信小店、原价不超过1万元的商品,都将默认支持“送礼物”功能。这和全量上线几无区别。0000卢伟冰回应发布会上误喊3000:真不是小米15 Pro的成本价

近日,小米集团卢伟冰在一场直播中回应了小米15Pro发布会上误报价格的事件。卢伟冰表示,3000元并不是小米15Pro的成本价格。他指出,小米15Pro的成本上涨明显高于售价上涨的幅度,并且在发布会彩排时没有确定价格,而发布当天他嗓子不舒服,导致误报了价格。卢伟冰还透露,3开头的价格将由Redmi负责,暗示RedmiK80系列的价格将在3000-4000元之间。0000