打开LLM黑盒

热点

赢下精品短剧春节档,腾讯视频靠“战略纵深”

2025-02-13 18:00:17苹果入局,重估阿里

2025-02-13 15:05:16百度港股大涨超10%:此前宣布文心一言将免费 并上线深度搜索

2025-02-13 15:03:13保值率76% 首台法拉第未来FF 91二手车诞生:卖了23.5万美元

2025-02-13 15:01:53抖音博主如何蹭到《哪吒2》的千亿流量?

2025-02-13 15:01:25小红书的年轻人爱上“剩菜盲盒”,他们真薅到羊毛了吗?

2025-02-13 14:59:37GPT-4.5马上发布,GPT-5免费畅聊!奥特曼剧透大动作,网友:让DeepSeek整破防了

2025-02-13 12:03:46REDMI K系列史上最大!K80至尊版电池超7000mAh

2025-02-13 10:12:05席卷外网!99美元的DeepSeek教程,“收割”老外

2025-02-13 09:21:52从北大的华尔街精英到B站顶流:小Lin说用“说人话”征服2000万粉丝

2025-02-13 09:18:37

关注

AI产品数据对比:一分没花的DeepSeek一骑绝尘,Kimi六小龙花钱还受伤

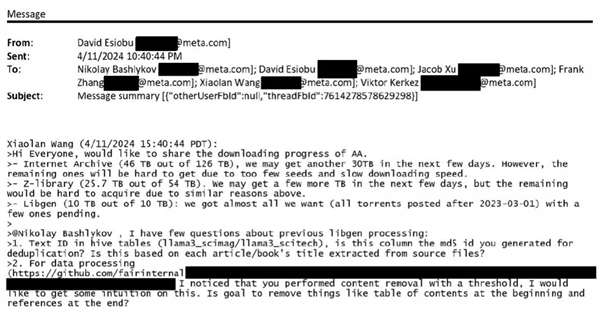

2025-02-10 08:41:45为训练AI不择手段!Meta被曝下载数十TB盗版电子书

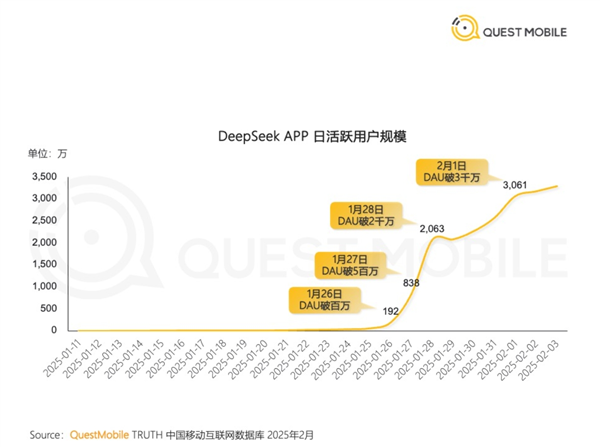

2025-02-10 08:38:57中国AI新秀爆火 DeepSeek成史上最快突破3000万日活App

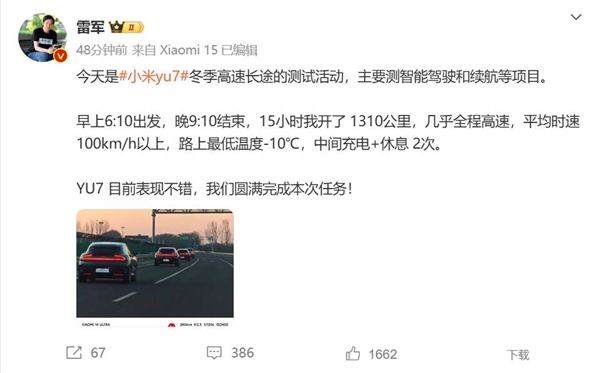

2025-02-10 08:38:56雷军驾驶小米YU7参与冬测:表现不错 测试任务圆满完成

2025-02-10 05:11:19用DeepSeek“赚钱”网课泛滥 专家:普通用户不用花钱学

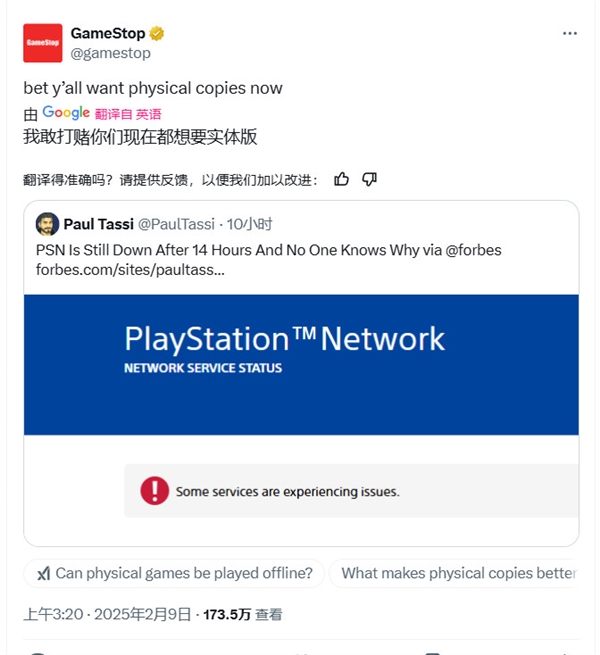

2025-02-10 05:11:18索尼PSN严重宕机!超过24小时才恢复:实体游戏零售商在线补刀

2025-02-10 05:11:17京东外卖“低佣”入局,美团回应“30%高佣”质疑

2025-02-10 05:11:12|美团开放个人摄影师入驻,搅热500亿市场?

2025-02-10 03:41:55《哪吒2》改写中国影史背后,这些配角燃爆了社交媒体

2025-02-10 03:21:53DeepSeek下棋靠忽悠赢了ChatGPT,网友:孙子兵法都用上了

2025-02-10 03:17:44