上下文1.6万token的编程大模型来了!与Stable Diffusion出自同门,一次吃5个Python文件不费劲

一个Stable Diffusion还不够!Stability AI再放杀手锏,进击代码生成领域:

推出了一款自称具有革命性的编码工具StableCode。

敲重点的是,StableCode不仅支持Python、Go、Java、JavaScript、C、Markdown、C 等多种编程语言。

还直接把上下文长度拉到16000个token。

好家伙,网友直呼疯批:

这波还直接戳中网友痛点:

我们真的很需要一个能够将整个代码库塞进上下文的工具。

上下文窗口16000token

官网显示,StableCode模型具有30亿参数,将提供基础模型、指令模型、长上下文窗口模型三种不同的模型,帮助开发人员编码。

StableCode在HPC(高性能计算)集群上,使用5600亿代码token的编程语言数据集starcoder-data对基础模型进行了训练。

StarCoder是HuggingFace和ServiceNow合作成立的开放科学合作组织BigCode于五月份开源的针对代码的大模型。

Stability AI首席研究科学家Nathan Cooper对VentureBeat表示:

我们非常喜欢BigCode,因为他们在数据治理、模型治理和模型训练方面做了惊人的工作,我们用了他们的数据集,并对其进行了额外的过滤和清理,同时也用在了构建长上下文窗口的模型,在我们的集群上进行了训练。

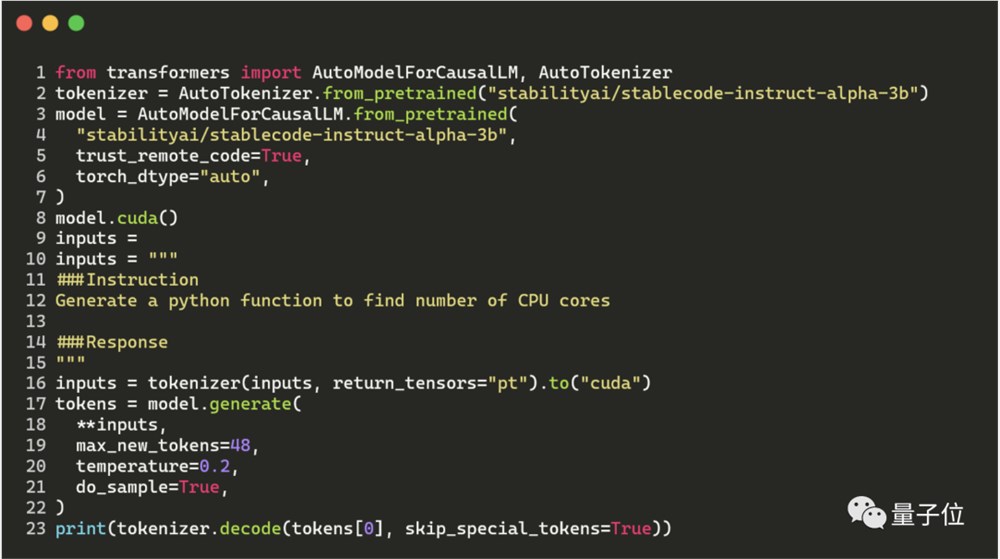

对于复杂的编程任务,StableCode则针对特定用例进行了指令调优。

在基础模型的基础上,用约120000个Alpaca格式的“代码指令-回答”对训练了指令模型。

△StableCode指令生成对给定指令响应的代码。

此外,为了满足用户对上下文窗口长度的需求,StableCode的长上下文窗口模型直接将上下文窗口拉长至16000个token,是此前开源模型的2-4倍。

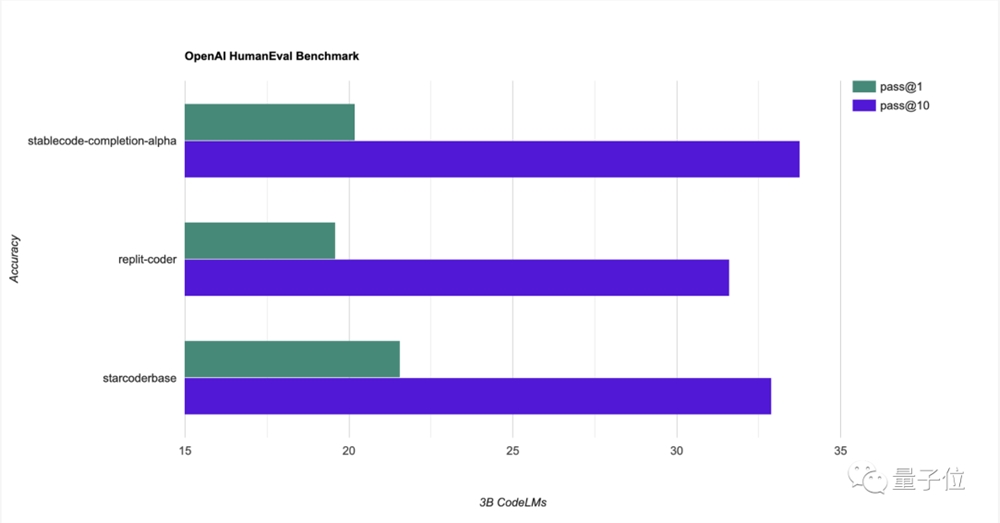

△与类似大小的模型(3B)进行的 HumanEval 基准比较。

不仅为用户提供了可单行、多行自动完成建议的工具,还允许用户同时查看编辑相当于五个中等大小的Python文件,允许更专业复杂的代码生成prompt。

下面是一个StableCode利用Pytorch深度学习库完成一个相对复杂的Python文件展示(灰色文本显示了StableCode的预测)。

使用了RoPE的方法

此外,StableCode也是用到了Transformer架构,不同于StarCoder用ALiBi(线性偏差的注意力)的方法定位模型输出,StableCode则是使用了RoPE(旋转位置嵌入)的方法。

Cooper表示:

在Transformer模型中,ALiBi方法倾向于更加重视当前的token,而不是过去的token。这对于代码生成来说不是一个理想的方法,因为代码没有固定的叙述结构,没有明确的开始、中间和结束。代码的功能可以在应用流程的任何点被定义。所以我们使用RoPE,它没有这种偏见。

StableCode目前还处于早期阶段,初始发布的目标是观察开发者如何接受和使用这个模型。

我们将与社区进行互动合作,看看他们会提出哪些有趣的方向,并针对开发者领域进行生成式探索 。

研究主管Christian Laforte也浅聊了StableCode的目标:

与Stable Diffusion帮助世界上任何人成为艺术家类似,我们希望StableCode模型能让任何有好点子但却遇到问题的人,能够编写一个解决问题的程序。

看到Stability AI再放大招的这波操作,有网友在去测试Github Copilot的路上来了个掉头:

还有网友希望“预定”下一次动作:

真的很想看Stability AI在文本转语音方面,做些类似谷歌SoundStorm(声音风暴)的事啊。

此外,StableCode目前已经开源啦!

参考链接:

[1]https://venturebeat.com/programming-development/stability-ai-launches-stablecode-an-llm-for-code-generation/

[2]https://twitter.com/StabilityAI/status/1688931312122675200

—完—

汤姆猫+AI求IP“翻红”?股东年内忙减持

作为初代手机宠物陪伴游戏,“会说话的汤姆猫”曾在全球积累了大量粉丝,汤姆猫IP也成为一代经典。2017年,A股上市公司金科文化将诞生自海外“汤姆猫”收入麾下。你或许不知道,汤姆猫已成为中国A股市场的一只股票代码。站长网2023-07-19 14:15:530000英伟达连跌3天 市值蒸发4300亿美元:总市值回落至2.91万亿

站长之家(ChinaZ.com)6月25日消息:近日,科技巨头英伟达股价经历了剧烈波动。这家曾短暂登顶市值之巅的公司,今日股价跌超6%,报收于118.11美元,创下两个月来最大单日跌幅,总市值回落至2.91万亿美元。站长网2024-06-25 11:59:290000Siri联合创始人:苹果与OpenAI合作不会长久

站长之家(ChinaZ.com)6月7日消息:据外媒报道,人工智能将是下周苹果全球开发者大会(WWDC)的一大重点。此前有消息称,苹果公司已与生成式AI领军企业OpenAI达成协议,OpenAI将为苹果iOS18操作系统提供生成式AI聊天机器人功能。站长网2024-06-08 09:51:450000用AI开淘宝店,单月卖出500多件!是能复制的好生意吗?

最近,商业媒体36氪用AI开了一家淘宝女装店。36氪用AI开的淘宝店(中)小到店铺名、店铺Logo,大到每件衣服的设计、模特图、详情页文案,无一例外,都是由AI生成的。全程无需雇佣任何设计师、摄影师、模特、文案专员,也没有一件真实商品,效果却与主流的淘宝服饰类店铺无异。目前,这条视频在B站已有311万播放,18万点赞,相关话题还上过微博热搜。站长网2023-06-26 23:42:390000复盘拼多多:为什么能持续低价且盈利

一个去中心化、反品牌逻辑、以单品爆品为核心要素的低价电商生态。毫无疑问,拼多多是一家明星公司。围绕拼多多,我们的舆论场中已经有太多的讨论。人们关注它如何成为中国增长最快的互联网巨头,关注它如何在阿里京东的眼皮底下挖掉一大块蛋糕,关注它年少有为却在壮年时期急流勇退的创始人,也关注它在我们日常生活中所创造的令人或忍俊不禁或气急败坏的消费体验。0000