十亿参数,一键瘦身!「模型减重」神器增强型 SmoothQuant,让大模型狂掉 3/4

【新智元导读】Sam Altman 曾表示,语言模型不是越大越好。不断炼大的模型,若想实现高效训练和部署还得需要「量化」。英特尔增强型 SmoothQuant 给出了解决方案。

本文介绍了可提升大语言模型的训练后量化表现的增强型 SmoothQuant 技术,说明了这项技术的用法,并证明了其在准确率方面的优势。此方法已整合至英特尔®Neural Compressor(1)中。

英特尔®Neural Compressor 是一个包含量化、剪枝(稀疏性)、蒸馏(知识提炼)和神经架构搜索等多种常用模型压缩技术的开源 Python 库。

目前,诸如 TensorFlow、英特尔®Extension for TensorFlow(2)、PyTorch、英特尔®Extension for PyTorch(3)、ONNX Runtime 和 MXNet等主流框架,都能与之兼容。

英特尔®Neural Compressor 已经支持多款英特尔®架构的硬件,比如英特尔®至强®可扩展处理器(4)、英特尔®至强®CPU Max 系列(5)、英特尔®数据中心 GPU Flex 系列(6)和英特尔®数据中心 GPU Max 系列(7)。

本文涉及的实验基于第四代英特尔®至强®可扩展处理器(8)进行。

大语言模型

大语言模型 (Large Language Model, LLM) 需基于海量数据集进行训练,可能拥有数十亿权重参数。

其先进的网络结构和庞大的参数量,使它们能够很好地应对自然语言本身的复杂性。

完成训练后的大语言模型,可针对各种下游的自然语言处理 (NLP) 和自然语言生成 (NLG) 任务进行调优,让其更适合对话式聊天机器人(如 ChatGPT)、机器翻译、文本分类、欺诈检测和情感分析等任务场景。

大语言模型部署面临的挑战

大语言模型在执行自然语言处理和自然语言生成任务方面表现出色,但其训练和部署颇为复杂,主要面临以下挑战:

AI 与内存墙(9)瓶颈问题:算力每两年提高3.1倍,内存带宽却只提高1.4倍;

网络带宽挑战:训练大语言模型需要采用分布式系统,这对网络带宽提出了较高要求;

系统资源有限:训练后的模型往往会部署在算力和内存资源均有限的系统上。

因此,采用训练后量化的方法来为大语言模型瘦身,对于实现低时延推理至关重要。

大语言模型的量化

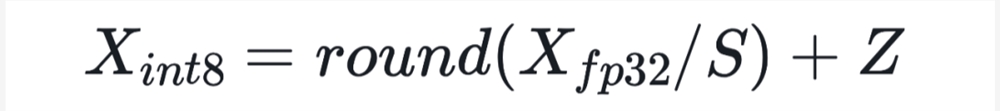

量化是一种常见的压缩操作,可以减少模型占用的内存空间,提高推理性能。采用量化方法可以降低大语言模型部署的难度。具体来说,量化是将浮点矩阵转换为整数矩阵:

其中 X_fp32、S 和 Z 分别为输入矩阵、比例因子和整数零点。

有关每通道 (per-channel) 量化策略虽然可能会减少量化损失,但不能用于激活值量化的原因,请参看SmoothQuant 相关文档(10)。

不过,激活值量化误差损失却是导致模型量化准确率下降的重要因素。为此,人们提出了很多方法来降低激活值量化损失,例如:SPIQ(11)、Outlier Suppression(12)和SmoothQuant(13)。

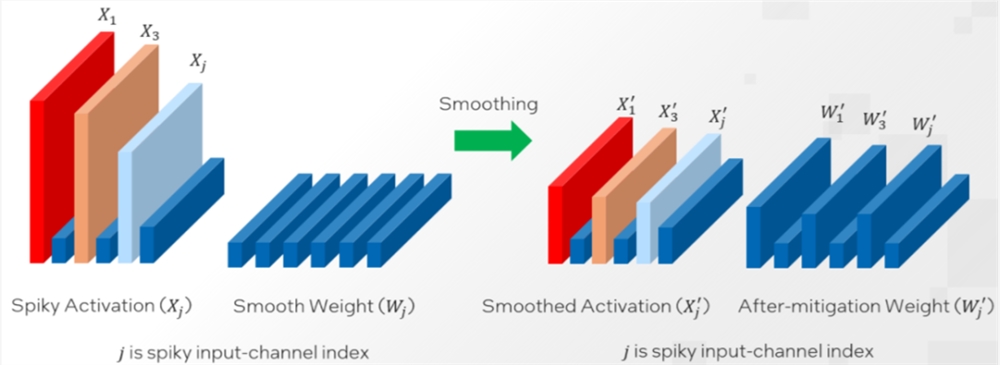

这三种方法思路相似,即把激活值量化的难度转移到权重量化上,只是三者在转移难度的多少上有所不同。

增强型 SmoothQuant

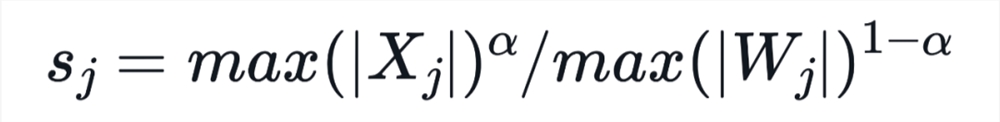

SmoothQuant 引入了一个超参数 α 作为平滑因子来计算每个通道的量化比例因子,并平衡激活值和权重的量化难度。

其中 j 是输入通道索引。

对于期权定价模型 (OPT) 和 BLOOM 等大多数模型来说,α=0.5是一个能够较好实现权重和激活值量化难度分割的平衡值。

模型的激活异常值越大,就越需要使用更大的 α 值来将更多的量化难度转移到权重上。

原始的 SmoothQuant 旨在通过针对整个模型使用一个固定值 α 来分割权重和激活值的量化难度。

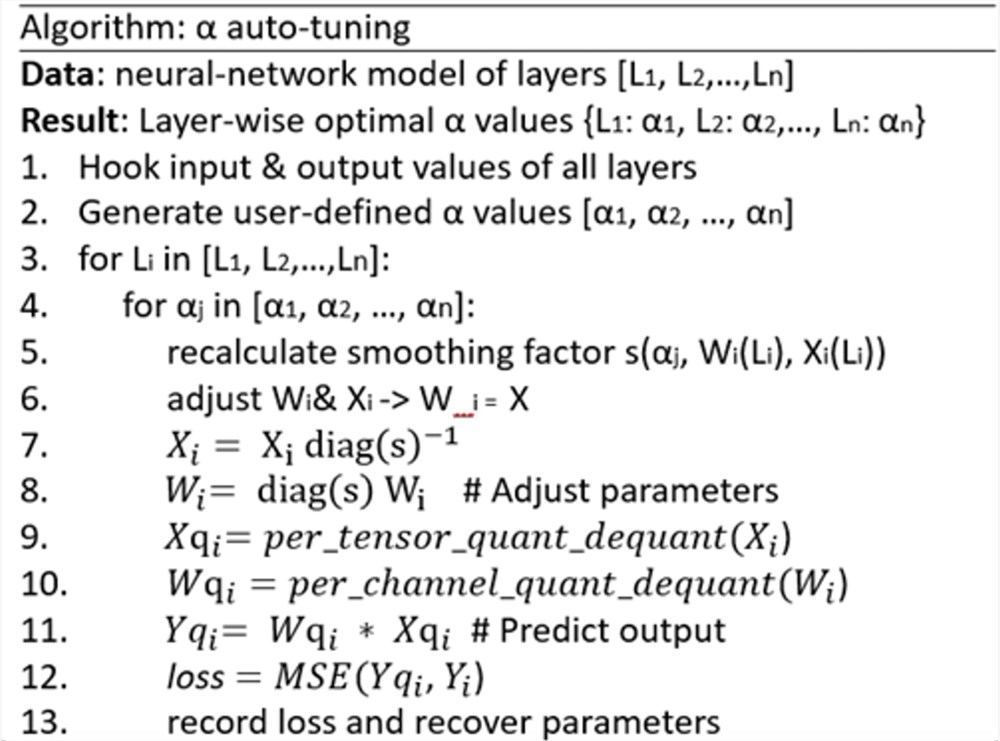

然而,由于激活异常值的分布不仅在不同模型之间存在差异,而且在同一模型的不同层之间也不尽相同,因此,本文推荐使用英特尔®Neural Compressor 的自动调优能力,逐层获取最佳 α 值。

相关方法包括以下五个主要步骤(伪代码如下所示):

通过特殊的回调函数 register_forward_hook 捕获 (hook) 模型各层的输入和输出值。

根据用户定义的 α 范围和步长生成一个 α 值列表。

根据给定的 α 值重新计算平滑因子并调整参数(权重值和激活值)。

对权重执行每通道量化与反量化 (quantization_dequantization),对输入值执行每张量 (per-tensor) 量化与反量化,以预测与给定 α 值对应的每层输出值。

计算相对实际输出值的均方损失,将调整后的参数恢复回来,并保存每层的最佳 α 值。

本文提出的方法支持用多个标准(如最小值、最大值和平均值)来确定 Transformer 块的输入层归一化 (LayerNorm) 操作的 α 值。

实验发现,将 α 范围设为 [0.3,0.7],步长设为0.05,对大多数模型来说都能达到很好的平衡。

这一方法有两个显著特点:一是全自动化,二是比原始方法支持的融合模式多。

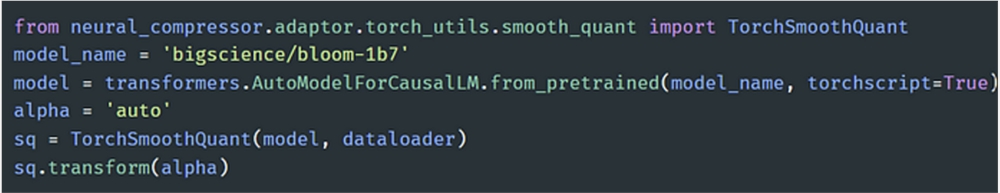

下图提供了在 BLOOM-1b7模型上执行 SmoothQuant α 值自动调优的样例代码:

启用增强型 SmoothQuant 的样例代码

用户只需传递一个模型名称 (model_name) 和一个数据加载器。

值得注意的是,模型分析主要依靠的是 Torch JIT。用户可以在加载Hugging Face 模型(14)时将 torchscript 设置为 True,或将 return_dict 设置为 False。更多信息请参阅英特尔®Neural Compressor 文档(10)。

结果

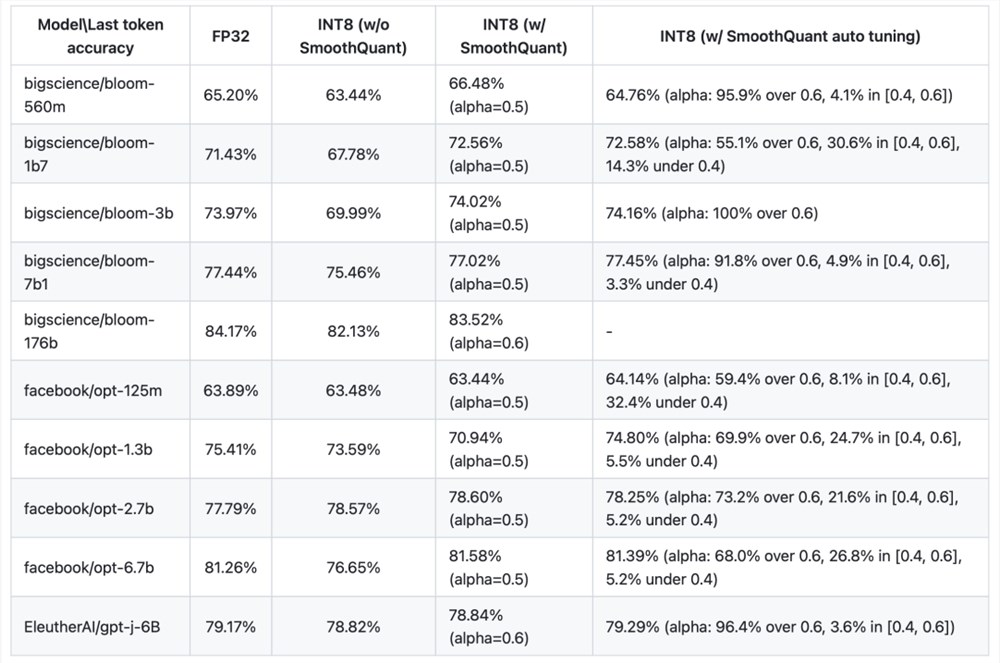

本文提出的增强型 SmoothQuant 的主要优势在于提高了准确率。

经过对多种主流大语言模型的评估,具备自动调优能力的 INT8SmoothQuant 最后一个词元 (last-token) 的预测准确率要高于原始 INT8SmoothQuant 和 FP32基线方法。详见下图:

FP32基线方法、INT8(启用和不启用 SmoothQuant)以及 INT8(启用本文提出的增强型 SmoothQuant)的准确率对比

从上图可以看出,在 OPT-1.3b 和 BLOOM-1b7模型上,本文提出的增强型 SmoothQuant 的准确率比默认的 SmoothQuant 分别高5.4% 和1.6%。

量化后的模型也缩小到 FP32模型的四分之一,大大减少了内存占用空间,从而有效地提升大模型在英特尔®平台上的推理性能。

更全面的结果请见GitHub 存储库(10)。同时,也欢迎您创建拉取请求或就GitHub 问题(15)发表评论。期待听到您的反馈意见和建议。

作者

英特尔公司人工智能资深架构师沈海豪、英特尔公司人工智能资深软件工程师程文华、英特尔公司人工智能软件工程师陆崟彤、何欣、郭恒、王畅、王梦妮,他们都在从事模型量化及压缩的研究与优化工作。

注释:

1.英特尔®Neural Compressor

https://www.intel.cn/content/www/cn/zh/developer/tools/oneapi/neural-compressor.html

2.英特尔®Extension for TensorFlow

https://www.intel.cn/content/www/cn/zh/developer/tools/oneapi/optimization-for-tensorflow.html

3.英特尔®Extension for PyTorch

https://www.intel.cn/content/www/cn/zh/developer/tools/oneapi/optimization-for-pytorch.html

4.英特尔®至强®可扩展处理器

https://www.intel.cn/content/www/cn/zh/products/details/processors/xeon/scalable.html

5.英特尔®至强®CPU Max 系列

https://www.intel.cn/content/www/cn/zh/products/details/processors/xeon/max-series.html

6.英特尔®数据中心 GPU Flex 系列

https://www.intel.cn/content/www/cn/zh/products/details/discrete-gpus/data-center-gpu/flex-series.html

7.英特尔®数据中心 GPU Max 系列

https://www.intel.com/content/www/us/en/products/details/discrete-gpus/data-center-gpu/max-series.html

8. 第四代英特尔®至强®可扩展处理器

https://www.intel.cn/content/www/cn/zh/events/accelerate-with-xeon.html

9. AI 与内存墙

https://medium.com/riselab/ai-and-memory-wall-2cb4265cb0b8

10. SmoothQuant 相关文档 /英特尔®Neural Compressor 文档 / GitHub 存储库

https://github.com/intel/neural-compressor/blob/master/docs/source/smooth_quant.md

11. SPIQ

https://arxiv.org/abs/2203.14642

12. Outlier Suppression

https://arxiv.org/abs/2209.13325

13. SmoothQuant

https://arxiv.org/abs/2211.10438

14. Hugging Face 模型

https://huggingface.co/models

15. GitHub 问题

https://github.com/intel/neural-compressor/issues

Text2Immersion:可通过文本直接生成3D场景

Text2Immersion是一种创新的方法,通过文本提示生成高质量的3D沉浸式场景。该项目的流程首先利用预训练的2D扩散和深度估计模型逐步生成高斯云,然后在高斯云上进行细化阶段,通过插值和细化来增强生成场景的细节。体验地址:https://ken-ouyang.github.io/text2immersion/index.html站长网2024-01-03 12:04:070000Motion推新功能Video-to-Motion 可通过视频捕捉运动

Motion推出了一项新功能:Video-to-Motion,该功能可以通过视频捕捉运动。用户只需上传一个视频,系统就会从中捕捉人物的动作。利用这些捕捉到的动作动画,用户可以创建全新的视频。除此之外,用户还可以选择角色、设置参数,生成基于捕捉动作的各种角色视频。最后,用户还可以将动画下载为FBX文件,导入到3D软件中进行后续编辑。站长网2024-01-18 10:48:410000实在智能大语言模型TARS开启内测

根据实在智能官方公众号实在RPAIPA的消息,知名流程自动化企业实在智能正在进行自研垂直领域大语言模型TARS(塔斯)的内测工作。据了解,实在TARS大模型基于开源基座模型,在千亿级高质量的Tokens上进行了训练,完整地实现了Pretrain、SFT和RLHF三个阶段。该项目于2023年初启动,目前正在进行更全面、完整的效果评测。站长网2023-07-03 18:21:330000一条视频霸榜四大平台,全能博主“接棒”李子柒

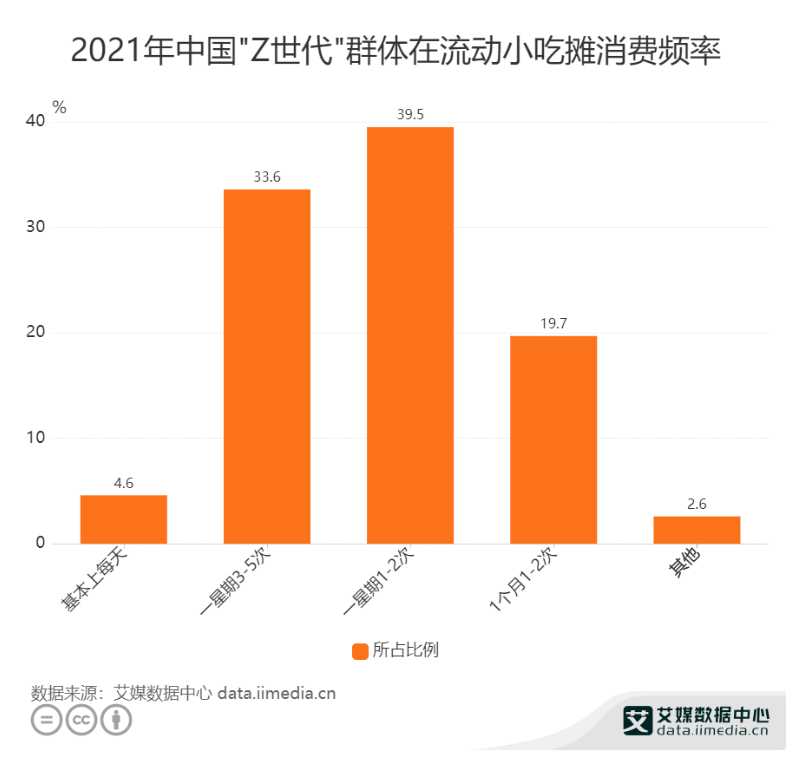

2023过半,上半年最后一个月,小红书呈现怎样的面貌呢?我们先一起来看涨粉榜:本月位列第一的是男明星@白敬亭,凭借剧集《长风渡》的热播,男主角白敬亭在小红书的热度一路攀升。卡思观察到,他最近分享的内容与之前相比也有很大不同,除了日常的穿搭照片外,近一个月的笔记中多了很多运动健身的vlog,丰富了账号内容的同时,也让粉丝们大饱眼福,让账号得以单月涨粉31.6W。站长网2023-07-05 20:58:050003被集市收割、被买家嫌弃,“摆摊后浪”有点惨

近段时间,深圳、北京、上海等城市先后给出相关政策,解禁路边摊。有人表示,大城市里的人间烟火气又回来了,白天上班是奋斗与生活的开始,晚上摆摊则是梦想与兴趣的延续。支一个小摊、游走于集市的生活方式的确正成为不少年轻人的心之向往。一个个月入上万的摆摊神话在各大社交平台演绎着,时时刻刻诱惑着年轻人那颗躁动的心。站长网2023-05-19 16:53:530000