这就翻车了?Reflection 70B遭质疑基模为Llama 3,作者:重新训练

最近,开源大模型社区再次「热闹」了起来,主角是 AI 写作初创公司 HyperWrite 开发的新模型Reflection70B。

它的底层模型建立在 Meta Llama3.170B Instruct 上,并使用原始的 Llama chat 格式,确保了与现有工具和 pipeline 的兼容性。

这个模型横扫了 MMLU、MATH、IFEval、GSM8K,在每项基准测试上都超过了 GPT-4o,还击败了405B 的 Llama3.1。

凭借如此惊艳的效果,Reflection70B被冠以开源大模型新王。该模型更是由两位开发者(HyperWrite CEO Matt Shumer 和 Glaive AI 创始人 Sahil Chaudhary)花了3周完成,效率可谓惊人。

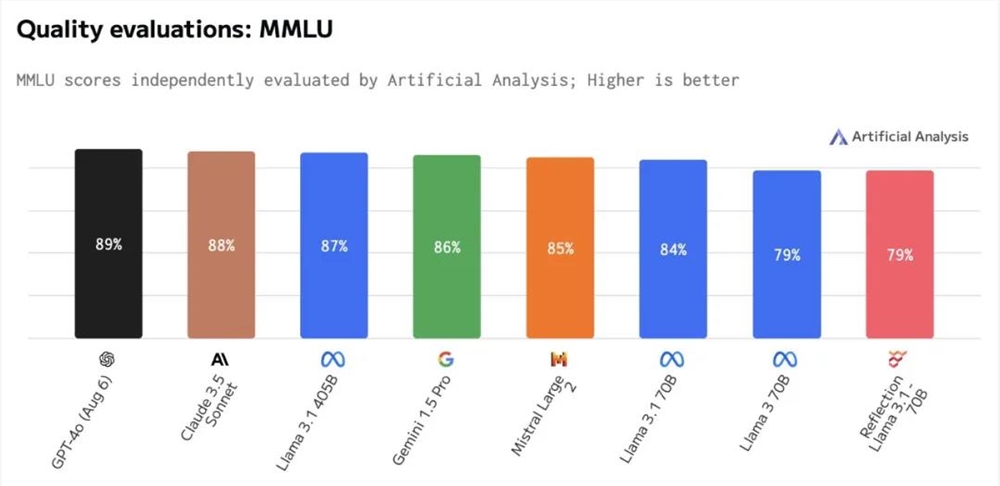

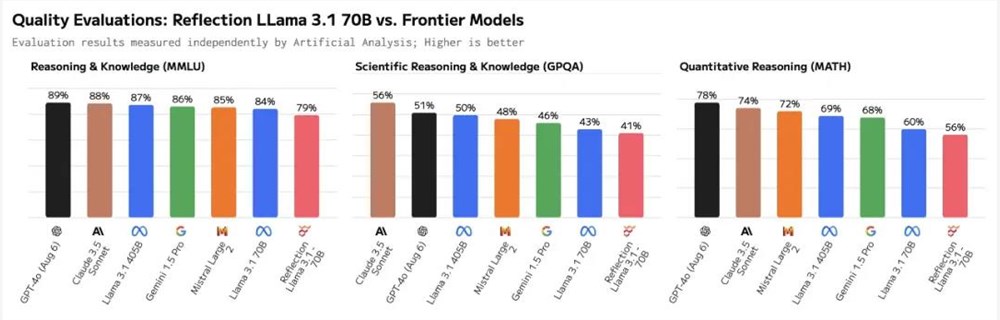

Reflection70B 能不能经受住社区的考验呢?今天 AI 模型独立分析机构 Artificial Analysis 进行了独立评估测试,结果有点出乎意料。

该机构表示,Reflection Llama3.170B 的 MMLU 得分仅与 Llama370B 相同,并且明显低于 Llama3.170B。

图源:https://x.com/ArtificialAnlys/status/1832505338991395131

还有科学推理与知识(GPQA)和定量推理(MATH)基准测试的结果,同样不如 Llama3.170B。

图源:https://x.com/ArtificialAnlys/status/1832457791010959539

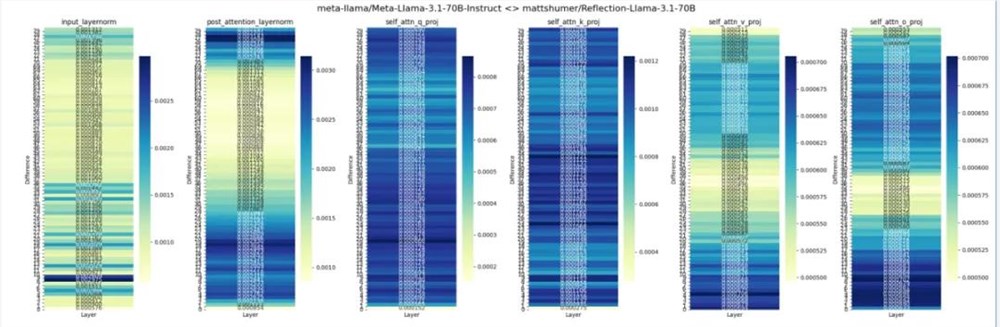

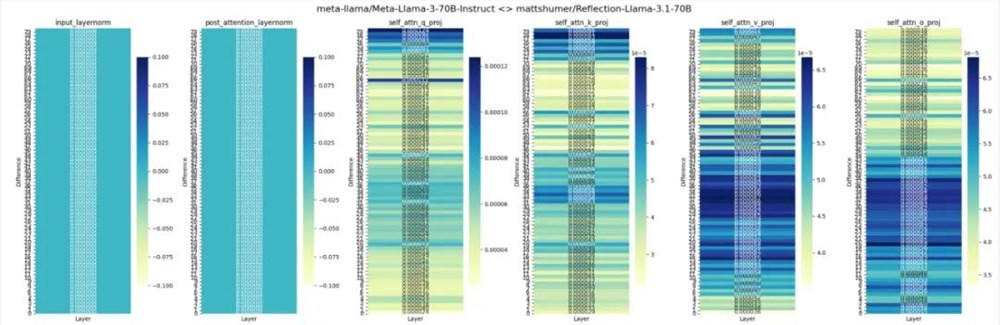

此外,Reddit 上 LocalLLaMA 社区的一个帖子比较了 Reflection70B 与Llama3.1、Llama3权重的差异,结果显示,Reflection 模型似乎是使用了经过 LoRA 调整的 Llama3而不是 Llama3.1。

贴主还提供了以上模型权重比较结果的代码来源。

fromtransformersimportAutoModelForCausalLM,AutoTokenizerimporttorchimportmatplotlib.pyplotaspltimportseabornassnsbase_model_name="meta-llama/Meta-Llama-3-70B-Instruct"chat_model_name="mattshumer/Reflection-Llama-3.1-70B"base_model=AutoModelForCausalLM.from_pretrained(base_model_name,torch_dtype=torch.bfloat16)chat_model=AutoModelForCausalLM.from_pretrained(chat_model_name,torch_dtype=torch.bfloat16)defcalculate_weight_diff(base_weight,chat_weight):returntorch.abs(base_weight-chat_weight).mean().item()defcalculate_layer_diffs(base_model,chat_model):layer_diffs=[]forbase_layer,chat_layerinzip(base_model.model.layers,chat_model.model.layers):layer_diff={'input_layernorm':calculate_weight_diff(base_layer.input_layernorm.weight,chat_layer.input_layernorm.weight),#'mlp_down_proj':calculate_weight_diff(base_layer.mlp.down_proj.weight,chat_layer.mlp.down_proj.weight),#'mlp_gate_proj':calculate_weight_diff(base_layer.mlp.gate_proj.weight,chat_layer.mlp.gate_proj.weight),#'mlp_up_proj':calculate_weight_diff(base_layer.mlp.up_proj.weight,chat_layer.mlp.up_proj.weight),'post_attention_layernorm':calculate_weight_diff(base_layer.post_attention_layernorm.weight,chat_layer.post_attention_layernorm.weight),'self_attn_q_proj':calculate_weight_diff(base_layer.self_attn.q_proj.weight,chat_layer.self_attn.q_proj.weight),'self_attn_k_proj':calculate_weight_diff(base_layer.self_attn.k_proj.weight,chat_layer.self_attn.k_proj.weight),'self_attn_v_proj':calculate_weight_diff(base_layer.self_attn.v_proj.weight,chat_layer.self_attn.v_proj.weight),'self_attn_o_proj':calculate_weight_diff(base_layer.self_attn.o_proj.weight,chat_layer.self_attn.o_proj.weight)}layer_diffs.append(layer_diff)returnlayer_diffsdefvisualize_layer_diffs(layer_diffs):num_layers=len(layer_diffs)num_components=len(layer_diffs[0])fig,axs=plt.subplots(1,num_components,figsize=(24,8))fig.suptitle(f"{base_model_name}<>{chat_model_name}",fontsize=16)fori,componentinenumerate(layer_diffs[0].keys()):component_diffs=[[layer_diff[component]]forlayer_diffinlayer_diffs]sns.heatmap(component_diffs,annot=True,fmt=".6f",cmap="YlGnBu",ax=axs[i],cbar_kws={"shrink":0.8})axs[i].set_title(component)axs[i].set_xlabel("Layer")axs[i].set_ylabel("Difference")axs[i].set_xticks([])axs[i].set_yticks(range(num_layers))axs[i].set_yticklabels(range(num_layers))axs[i].invert_yaxis()plt.tight_layout()plt.show()layer_diffs=calculate_layer_diffs(base_model,chat_model)visualize_layer_diffs(layer_diffs)

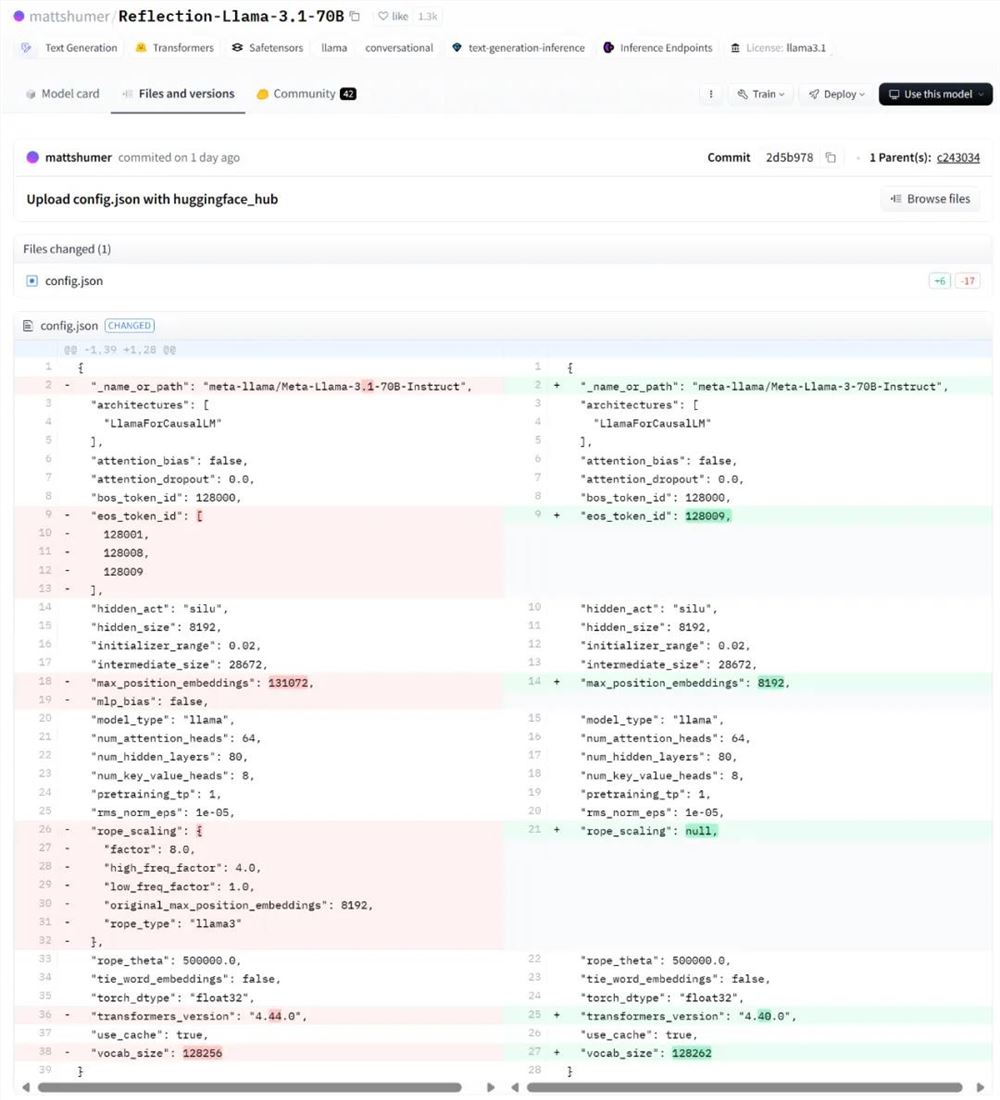

还有人贴出了 Matt Shumer 在 Hugging Face 对 Reflection70B 配置文件名称的更改,可以看到从 Llama370B Instruct 到 Llama3.170B Instruct 的变化。

这样的事实摆在眼前,似乎让人不得不信。各路网友也开始发声附和,有人表示自己从一开始就怀疑它是 Llama3,当用德语问模型一些事情时,它却用英语回答。这种行为对于 Llama3非常常见。

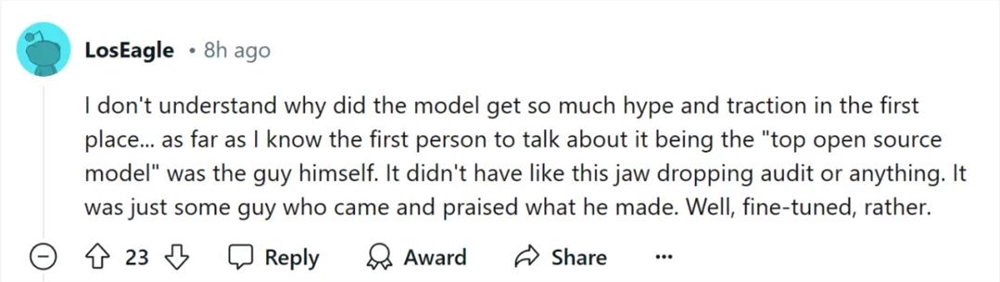

还有人奇怪为什么 Reflection70B 模型一开始就得到了如此多的炒作和关注,毕竟第一个谈论它是「顶级开源模型」的人是开发者本人(Matt)。而且更确切地说,模型是微调的。

更有人开始质疑开发者(Matt),认为他只是这家公司(GlaiveAI)的利益相关者,试图通过炒作来增加价值,实际上却对这项技术一无所知。

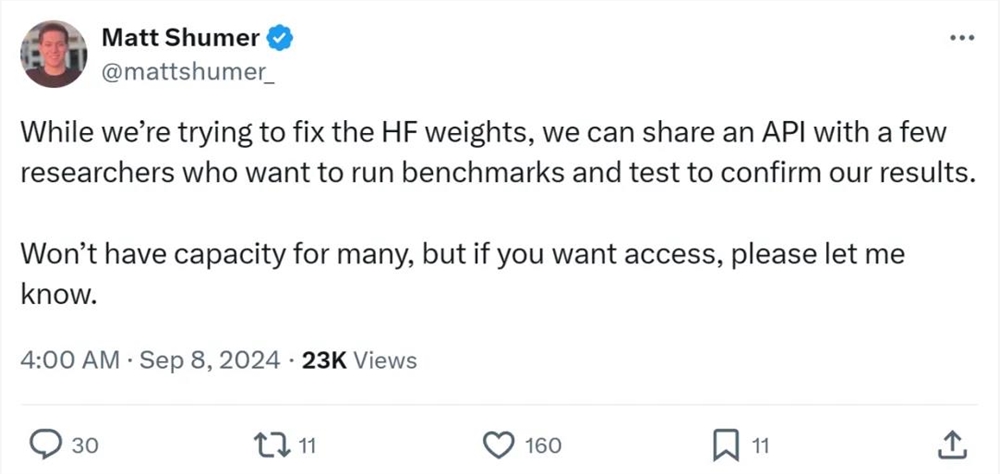

在被质疑 Reflection70B 的基础模型可能是 Llama3而非 Llama3.170B 时,Matt Shumer 坐不住了,现身进行了澄清,并表示是Hugging Face 权重出现了问题。

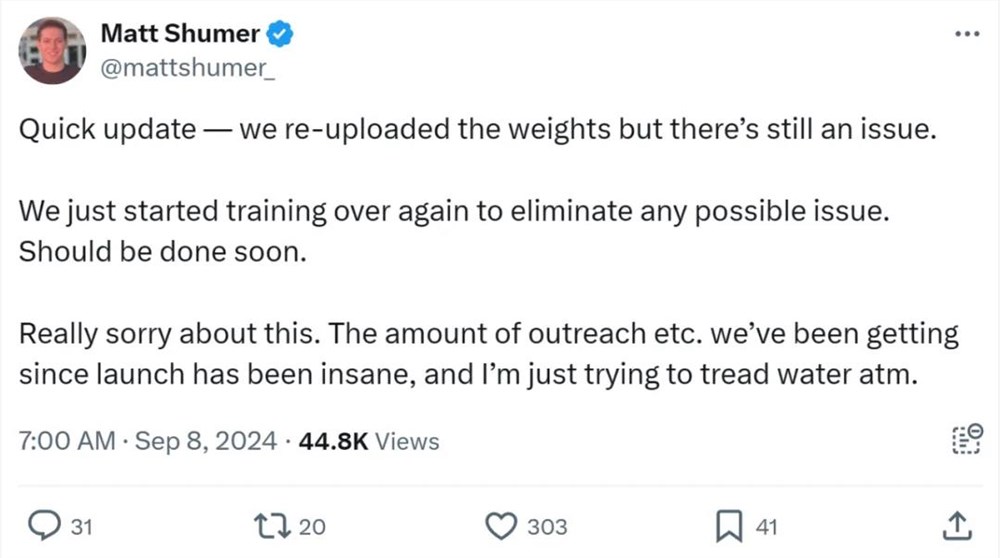

就在几个小时前,Matt Shumer 称已经重新上传了权重,但仍然存在问题。同时他们开始重新训练模型并上传,从而消除任何可能出现的问题,应该很快就会完成。

当被问到为何需要重新训练时,Matt Shumer 表示本不需要这样做,但已经尝试了所有方法。无论做什么,Hugging Face 上 Reflection70B 模型都会出现问题,导致离预期中的性能差得远。

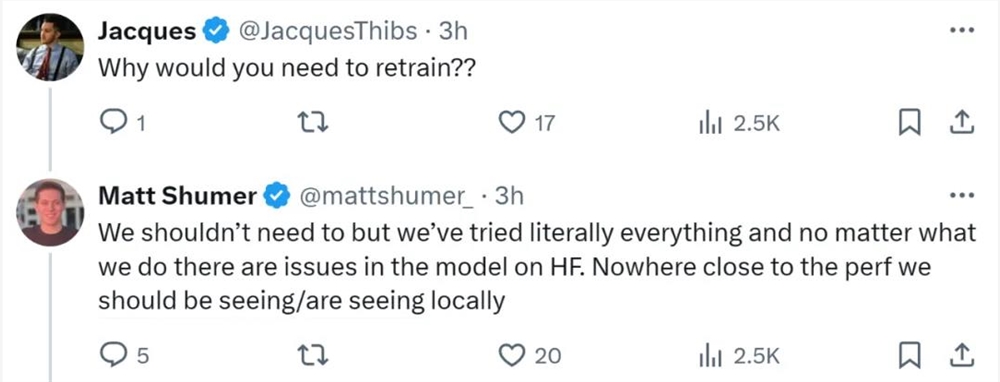

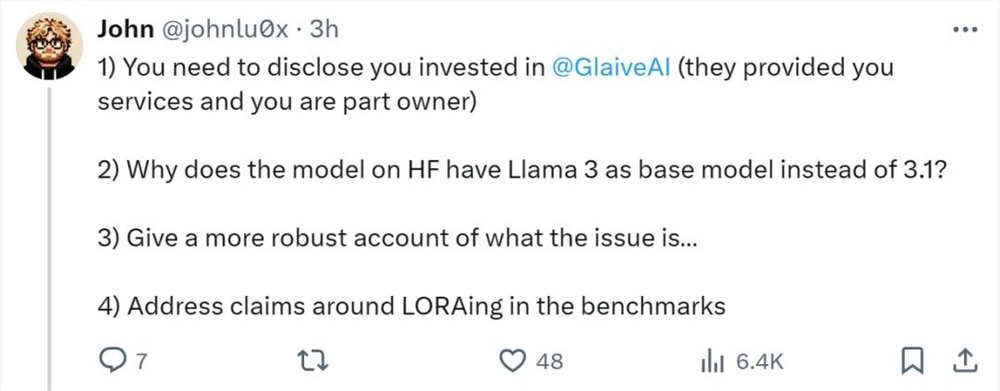

当然 Matt Shumer 还面临更多质疑,比如对 GlaiveAI 的投资情况、为什么 Hugging Face 上的基础模型为 Llama3而不是 Llama3.1以及基准中有关 LORAing 的问题。

Matt Shumer 一一进行了解释。(以下标引用)

1. 我是一个超级小的投资者(1000美元),只是一次支持性的投资,因为我认为 Sahil Chaudhary 很棒。

2. 至于为什么基础模型是 Llama3,我们不知道。这就是为什么我们从头开始再训练,应该很快完成。

3. 那些尝试了 Playground 并拥有早期访问权限的用户获得了与托管 API 截然不同的体验,我们需要弄清楚这一点。

4. 不确定什么是 LORAing,但我们检查了污染,将在下周与405B(或更早)一起发布数据集,到时候可以查看。

至于重新训练后的 Reflection70B 表现如何?我们拭目以待。

不翻车不嫌累,月成本仅200元:AI主播攻占直播间

你能想象吗?上百平米的直播基地里,工位上空无一人,桌面上数十台电脑屏幕里的AI主播正不知疲倦、神采奕奕地直播着,他们的神态与真人无异,但成本却只有真人直播间的10%,话术是现成的、场景是数字化搭建的,就连引流短视频都能被批量生产……2023年,一场AI技术革命正在席卷带货直播间。站长网2023-05-04 17:16:110000抖音外卖,认清现实

抖音想成为什么样的抖音?2019年,抖音管理团队认为它应该回到产品本身的定位——看见并连接。连接不仅停留在信息、人,还要有服务。字节跳动创始人张一鸣提出了自己的建议,要在“餐饮、购物、旅游深入”。这很自然地解释了抖音后来布局本地生活业务的初衷。站长网2023-06-13 14:07:590000AI视频新霸主诞生!Dream Machine官宣免费用,电影级大片玩疯

【新智元导读】继Pika宣布上新2.0版本后,视频生成领域又有新模型加入。成立于2021年的LumaAI今天刚刚官宣了文生视频/图生视频模型DreamMachine,而且提供免费使用API,高质量的生成效果获得了很多网友的好评。视频生成领域,又添一员猛将!就在今天,LumaAI首发了自己的视频生成模型DreamMachine,可以通过文字或图片生成高质量的逼真视频。站长网2024-06-16 14:09:520002任天堂Switch 2加速量产中!有望2025年初就发布

快科技12月1日消息,据国外媒体报道,有网友透露称,英伟达已在9月份向任天堂的一家合同组装商运送了超过80万颗芯片。虽然任天堂官方一直对Switch2的发布日期保持沉默,但这一泄露信息却为玩家们提供了一些线索。报道称,大量芯片的发货似乎表明Switch2正在量产中,似乎印证了此前这款游戏机可能在2025年第一季度发布的消息。0000既生小川,何生彦宏

王小川又怼起了李彦宏。他在采访中反驳李彦宏观点的内容片段截图今天在圈子里流传,既抓眼球,又让人惊愕。其实,这是他第N次怼百度了。又和李彦宏“杠”上了称媒体采访的是平行世界的李彦宏百度,或者说李彦宏至于王小川来说,可能恰好就是他无法释怀的“疙瘩”。近年来,王小川屡次三番“辣评”百度。而今年百度、王小川前后脚宣布入局大模型事业后,王小川又针对李彦宏的观点发表了不同看法。站长网2023-04-13 14:22:390000