英特尔正打造价值数十亿美元的人工智能加速器业务

**划重点:**

1. 💸 在2023年中旬达到10亿美元后,英特尔的人工智能加速器业务已突破20亿美元。

2. 🧠 今年即将推出的Gaudi3芯片将使性能增加四倍,为英特尔在人工智能加速器市场上提供强大的竞争力。

3. 📈 随着对人工智能芯片需求的激增,英特尔预计这一新兴业务将在未来几年内实现数十亿美元的年收入。

英特尔的人工智能(AI)加速器业务正迎来高涨的兴趣。根据Motley Fool的报道,英特尔的AI加速器业务在2023年中旬达到10亿美元后,如今已经超过20亿美元。该公司即将推出的Gaudi3芯片有望在今年推出,其性能将是前一代的四倍,将使英特尔在人工智能加速器市场上成为一股强大的竞争者。

尽管英特尔在最近一季度报告中超出市场预期,但由于首席执行官Pat Gelsinger对第一季度前景的不乐观,投资者并不满意。尽管近期英特尔的短期命运与个人电脑和服务器CPU市场息息相关,但公司正朝着从其人工智能加速器芯片中最终每年创造数十亿美元收入的方向迈进。随着年度推移,英特尔预计这一新兴业务的收入将加速增长。

由于2019年收购Habana Labs,英特尔已经成为人工智能加速器市场的一名参与者。公司的Gaudi系列芯片专为AI训练和推断工作负载而设计,是市场领导者Nvidia高性能GPU的经济实惠替代品。在2023年7月,英特尔透露其AI加速器业务在单个季度内增长了六倍,达到10亿美元。到2023年底,这一数字超过了20亿美元。值得注意的是,这并不意味着英特尔目前从其AI加速器中获得这么多收入,而是公司预计这些客户的承诺将随时间转化为收入。

当前推动英特尔增长的是Gaudi2芯片,它几乎与Nvidia的顶级产品一样强大,在某些情况下甚至表现更为出色,并在性能每芯片和性能每美元方面提供了坚实的表现。英特尔计划在今年推出Gaudi3,该芯片有望将AI加速器业务推向新的高度。公司承诺性能增加四倍,网络带宽翻倍。英特尔表示,它最近增加了Gaudi2和Gaudi3的供应,以满足不断增长的需求。

Gaudi3之后,英特尔计划将其以人工智能为重点的GPU和Gaudi产品线合并为Falcon Shores,这是一款下一代数据中心GPU,预计将于2025年推出。

英特尔在2019年收购Habana Labs时曾预测,到2024年,AI芯片市场的规模将超过250亿美元。然而,Gartner将2024年AI芯片市场规模估计为670亿美元,到2027年将达到1190亿美元。其他估算将市场规模预测为到2032年将接近4000亿美元。虽然估算并非事实,但没有迹象表明对AI芯片的需求会在短期内减缓。

目前,Nvidia主导着AI加速器市场,而AMD则通过其最新的Instinct AI芯片发起挑战。尽管这两家公司对英特尔构成了激烈竞争,但市场预计将变得如此庞大,以至于将容纳多个获胜者。即使英特尔最终处于第二或第三的位置,人工智能加速器最终可能为这家芯片巨头带来数十亿美元的年收入。

在投资英特尔之前,投资者应考虑到Motley Fool Stock Advisor分析团队刚刚确定了他们认为是当前投资者最佳的10支股票之一,而英特尔并不在其中。这10支股票被认为可能在未来几年产生巨额回报。 Stock Advisor为投资者提供了成功的易于遵循的蓝图,包括建立投资组合的指导、分析师的定期更新以及每月两次的新股票推荐。自2002年以来,Stock Advisor服务的回报已经是S&P500指数的四倍以上。

MIT等惊人发现:全世界AI已学会欺骗人类,背刺人类盟友,佯攻击败99.8%玩家

【新智元导读】AI系统越来越擅长欺骗、操作人类了。最近,来自MIT、ACU等机构的研究人员通过各种实例研究发现,AI在各类游戏中,通过佯装、歪曲偏好等方式欺骗人类,实现了目标。AI教父Hinton的担心,不是没有道理。他曾多次拉响警报,「如果不采取行动,人类可能会对更高级的智能AI失去控制」。当被问及,人工智能怎么能杀死人类呢?站长网2024-05-14 09:09:380000世界排名第三!任正非:国内现有30多个操作系统基于鸿蒙开源构建

快科技9月22日消息,任正非在与南开大学新闻与传播学院院长、科技日报原总编辑刘亚东的谈话中提到,国内现在有30多个操作系统都是基于鸿蒙开源构建的,涵盖了行业终端、手机平板、家庭终端,加起来大概已经有6亿用户,世界排名第三。鸿蒙刚升级到4.0,升级以后,外面也会跟着升级。有个开源社区,不是华为一家在做,我们做的是底座和内核。我们是做黑土地”,上面的玉米”、大豆”还是高粱”,都是合作伙伴来种植的。0000视频号变了:谁赚钱?谁受伤?

今年春节回家,Jessie深刻感受到了视频号对二三线城市中老年人的渗透。因为手机内存小,他们没有下载抖音、快手、小红书,却会在饭桌上互拍“齐聚一堂”的视频,上传到视频号,发到家庭群互相点爱心。亲戚见面,也会讨论最近又在视频号上看了什么段子,很像某某家发生的事。站长网2024-03-13 09:09:240000B站2023百大UP主名单公布 1月6日将举行百大 UP 盛典

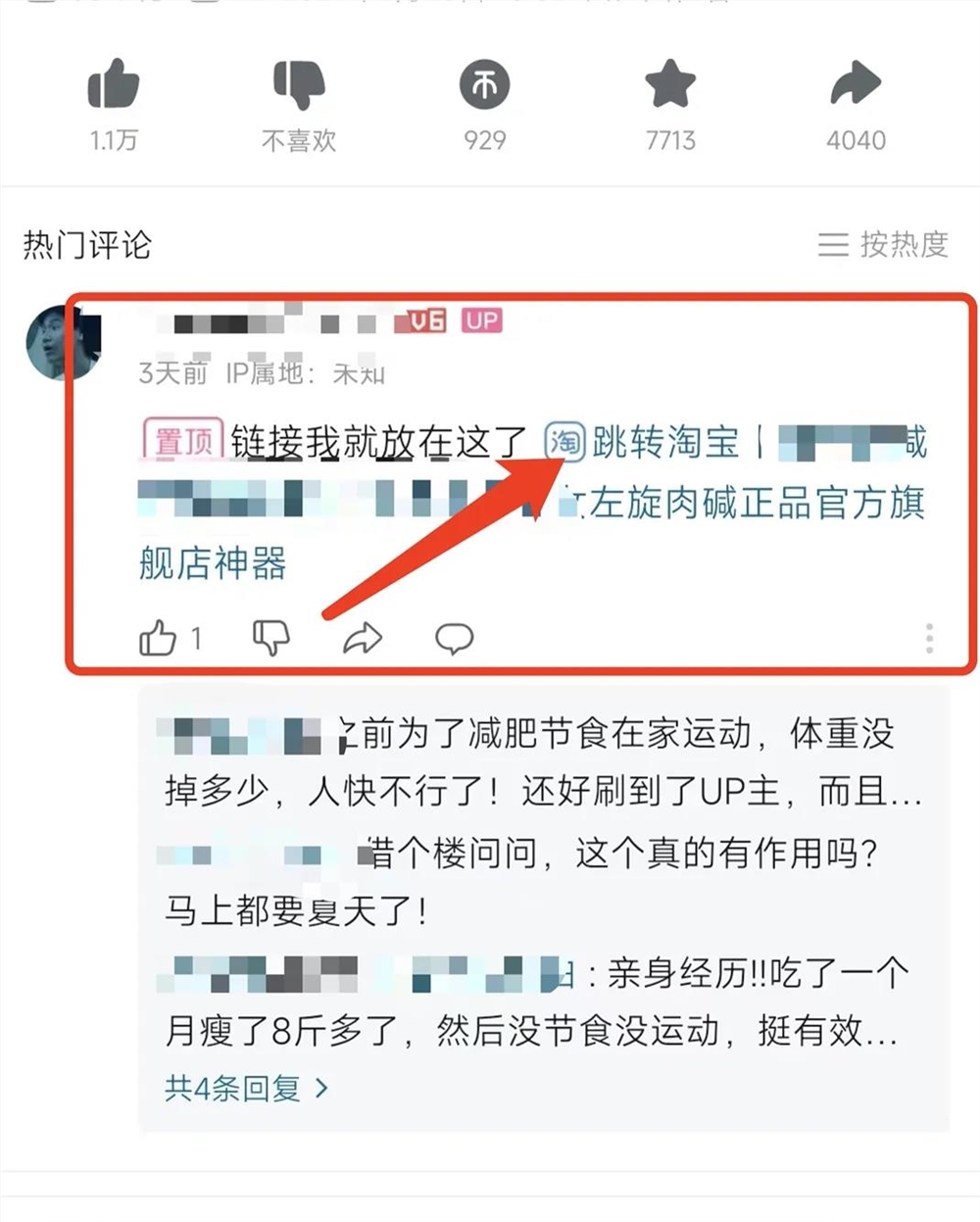

B站2023百大UP主名单已经公布了。这个名单评选标准为创作的「专业性、影响力、创新性」三个维度,从中选出了2023年度的百大UP主。百大UP主盛典将于1月6日在B站直播,100多位UP主将会参与。用户可以在B站上搜索“百大”预约直播。以下为获奖者具体名单:站长网2024-01-02 14:27:180000B站猛发力!这几个跳转打开了全域格局

最近一段时间,B站广告接到麻了。淘宝、拼多多、美团,来者不拒,跳转的链路也非常直接。不仅如此,B站也开始自己的图文广告之路,以便更好地对接电商平台。平台之间的打通,见实此前就有多次观察,腾讯与淘宝,小红书与微信等。(见实在3月28日广州私域大会上,邀约了诸多私域高手,探讨关于更多关于全域玩法的内容,欢迎文末报名。)站长网2024-03-26 19:35:520000