AI2发布开放语言模型OLMo 号称多项性能媲美Llama2

**划重点:**

1. 🚀 AI2发布了开放语言模型(OLMo),该框架旨在促进大规模语言模型的研究和实验,通过在Hugging Face和GitHub上提供训练代码、模型和评估代码来实现。

2. 🛠 OLMo的首批模型包括7B规模的四个变体和1B规模的一个模型,涵盖不同的架构、优化器和训练硬件,旨在满足多样化的研究需求。

3. 🌍 该项目的目标是建立全球最好的开放语言模型,已经启动不同规模、模态、数据集、安全措施和评估等方面的工作。

AI2最新发布的开放语言模型(OLMo)框架旨在推动大规模语言模型的研究和实验。通过在Hugging Face和GitHub上提供训练代码、模型和评估代码,AI2致力于让学术界和研究人员能够共同研究语言模型的科学,探索新的预训练数据子集对下游性能的影响,以及研究新的预训练方法和稳定性。

该项目的首批模型包括四个7B规模的最终变体,对应不同的架构、优化器和训练硬件,以及一个1B规模的模型,所有模型均在至少2T令牌上进行了训练。这是一个长期计划的第一步,计划继续发布更大规模的模型、经过指导调整的模型以及更多变体。

每个模型都提供完整的训练数据,包括生成训练数据的代码,以及用于分析预训练数据的AI2的Dolma和WIMBD。此外,还提供了完整的模型权重、训练代码、训练日志、以Weights & Biases日志形式呈现的训练指标,以及推理代码。每个模型的训练过程中的500多个检查点也可在HuggingFace上作为修订版本获得。

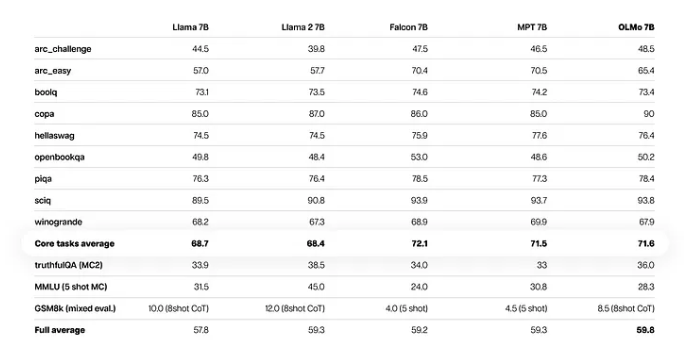

在创建强大的开放模型时,AI2从许多其他开放和部分开放的模型中吸取了经验,并将它们作为OLMo的竞争基准。该项目的技术报告提到,OLMo7B模型在诸如生成任务或阅读理解(如truthfulQA)等方面超过了Llama2,但在流行的问答任务(如MMLU或Big-bench Hard)上略显落后。

对于1B OLMo模型,使用AI2的Paloma和可在GitHub上获得的检查点进行了分析,以探讨模型在语言预测和模型规模等因素之间的关系。AI2强调Paloma的方法试图通过均匀采样各个领域,更平衡地表示使用语言模型的众多领域。

OLMo框架采用了最新文献中的许多趋势,包括不使用偏见(如PaLM中的稳定性)、PaLM和Llama使用的SwiGLU激活函数、Rotary位置嵌入(RoPE)以及GPT-NeoX-20B的BPE基础标记器的修改版本,旨在减少个人可识别信息。

该发布仅是OLMo和框架的开端,未来计划推出不同规模、模态、数据集、安全措施和评估等方面的工作。AI2鼓励使用OLMo模型,提供了简便的安装步骤和使用示例,并表示未来将推出指导调整的模型、完整的训练日志和wandb报告等功能。

博客网址:https://blog.allenai.org/olmo-open-language-model-87ccfc95f58

项目入口:https://top.aibase.com/tool/olmo

华为Pura 70北斗卫星消息版开售:5599元起

今日,华为全新推出的Pura70北斗卫星消息版正式亮相,此次发布的Pura70北斗卫星消息版提供了12GB256GB、12GB512GB、12GB1TB三种丰富的存储版本,以满足不同用户的需求,而对应的售价分别为5599元、6099元、7099元。站长网2024-06-28 22:30:250000AI日报:阿里又推王炸级对口型项目EchoMimic;三星推Galaxy Ring智能戒指;高保真3D头像生成模型RodinHD

欢迎来到【AI日报】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。新鲜AI产品点击了解:https://top.aibase.com/1、AI对口型项目EchoMimic:音频角色照片生成生动配嘴型视频站长网2024-07-11 15:42:240002AI初创公司Delphi新举措:将打造网红和名人AI数字虚拟人

文章概要:1.Delphi是一家人工智能初创公司,旨在创建名人和网红的个性化数字聊天机器人,以扩大他们与粉丝的互动。2.该公司利用各种数据源,包括聊天记录、电子邮件和视频,来塑造名人和网红的聊天机器人,使其能够与更多人进行互动。3.Delphi已筹集270万美元资金,计划使用开源模型,目前项目显然采用OpenAI技术。已经有100多名聊天机器人创作者和数千名用户参与私人测试。站长网2023-09-19 10:34:030000谁拿了腾讯巨额年终奖?

规则从未改变,一切都是业绩说了算。每到岁末年初,各大企业的年终奖都成为备受关注的话题。作为曾经巨额年终奖的领头羊公司,腾讯如今依然处在话题中央。近日有消息称,腾讯微信事业群年终奖最高30个月,游戏最高25个月,折合能有百万以上,一刹那间,全网都投去了羡慕的目光。0000福特CEO力赞中国电车:亲测小米SU7半年 直言比亚迪是最强对手

福特汽车首席执行官吉姆·法利近日在"EverythingElectricShow"节目中,深入剖析了全球汽车产业格局的重大转变,特别强调了中国新能源汽车产业的崛起。数据显示,2023年中国电动载人汽车出口量达177.3万辆,同比增长67.1%,占汽车出口总量的三分之一。0000