AI圈头条!谷歌Transformer开山论文惊天「翻车」

站长网2023-05-10 10:02:271阅

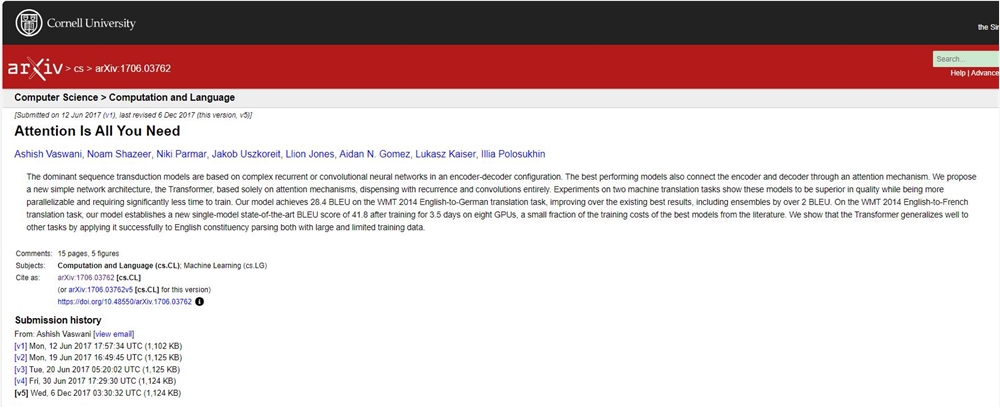

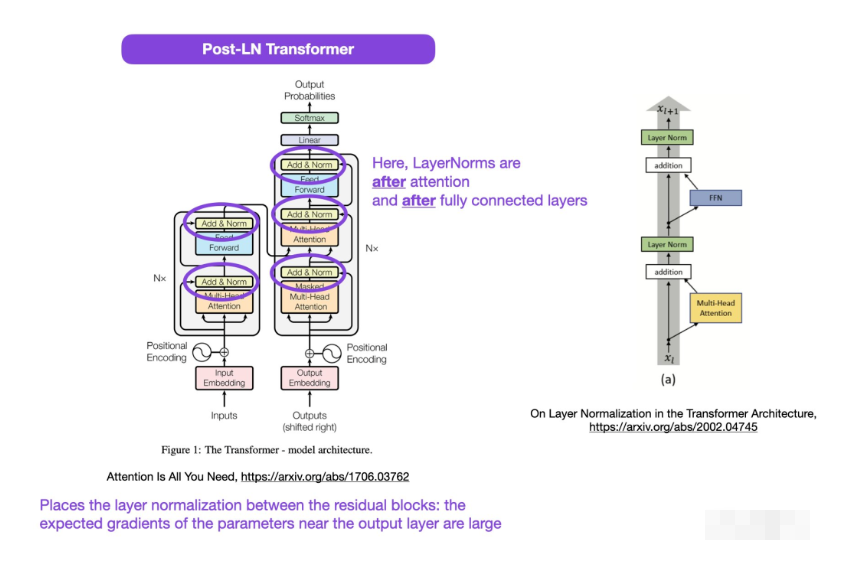

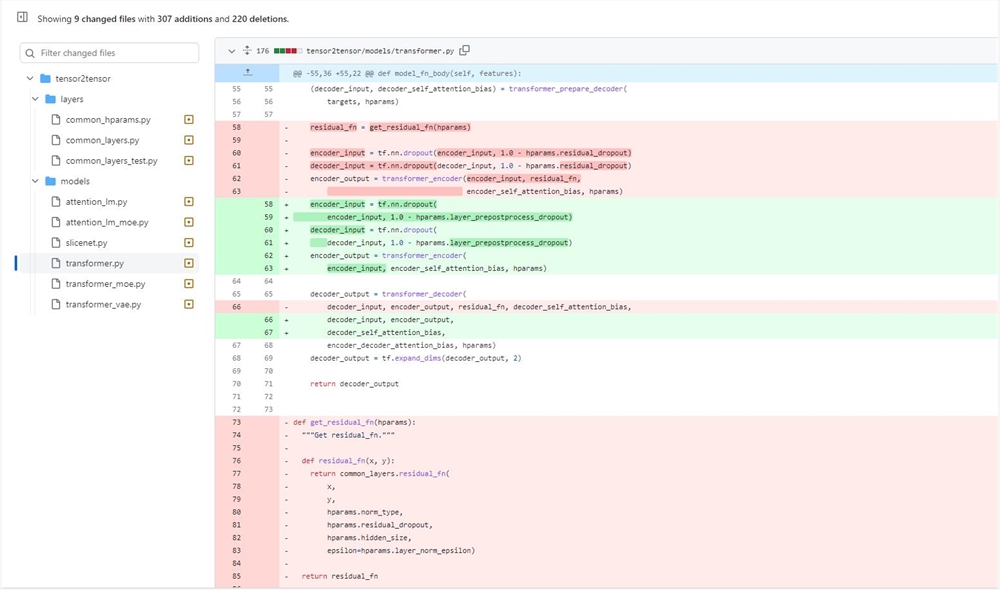

AI圈大头条!谷歌大脑的NLP奠基之作、提出Transformer架构的开山鼻祖级论文 《Attention Is All Your Need》竟然出现图与代码不一致的问题。

今天,谷歌的开创性论文《Attention Is All Your Need》中变压器架构的原始图表被发现是不正确的,LayerNorm处于错误的位置。然而,一篇新论文表明,将Pre-LN和Post-LN结合起来可以解决梯度爆炸和消失的问题。

论文地址:https://arxiv.org/abs/1706.03762

代码地址:

https://github.com/tensorflow/tensor2tensor/commit/f5c9b17e617ea9179b7d84d36b1e8162cb369f25#diff-76e2b94ef16871bdbf46bf04dfe7f1477bafb884748f08197c9cf1b10a4dd78e

据悉,Transformer架构是人工智能的基石,自2017年发表以来,该论文已被引用超过7万多次。在图表中发现错误引发了对该领域其他开创性论文准确性的质疑。

图中的错误可能导致转换器体系结构的不正确实现,这可能会影响使用它构建的模型的性能。

关于使用Pre-LN还是Post-LN的讨论正在进行中,新论文中提出的两种方法的结合可能会导致人工智能模型开发的进一步发展。

0001

评论列表

共(0)条相关推荐

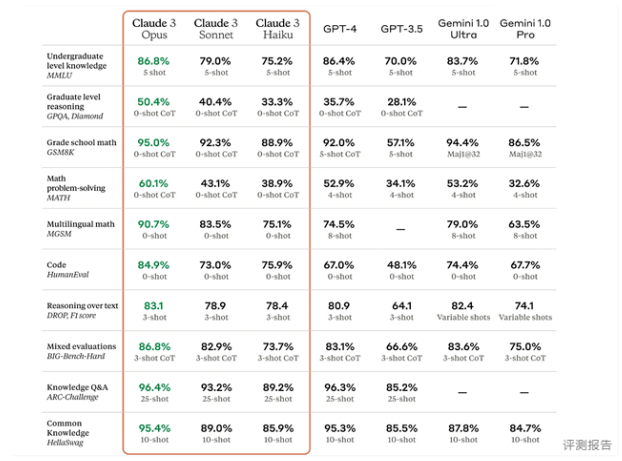

今日AI:多模态大模型Claude3发布;Gorq API开放申请;ChatGPT新增朗读功能;Stability AI发布SD3技术报告

欢迎来到【今日AI】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。新鲜AI产品点击了解:https://top.aibase.com/🤖📱💼AI应用Claude3正式发布:号称性能超GPT-4,免费使用、支持中文【AiBase提要:】站长网2024-03-05 18:43:340000贾跃亭回应第二阶段交付推迟:工业化和融资能力不足

就在刚刚,针对第二阶段交付推迟问题,FF创始人贾跃亭回应称,FF912.0FuturistAlliance是基于“FFaiHyper6x4Architecture2.0打造的极智科技顶奢的硅基新物种新品类“全能aiHypercar”,对工业化能力提出了很大挑战。站长网2023-06-22 11:27:200000英国出版协会敦促政府保护版权作品免受AI侵害

划重点:1.四个主要的出版协会联合敦促英国政府采取措施,制止侵害版权的人工智能工具的滥用。2.出版业呼吁政府承认和补偿已发生的版权侵权,并确保未来侵权行为停止。3.文章指出,人类创造力是出版和创意产业的基石,需要强有力的版权制度、作者补偿和创作者的控制。站长网2023-10-31 16:30:380000未成年人网络保护条例发布:禁止对未成年人网络欺凌

昨日,《未成年人网络保护条例》正式发布,自2024年1月1日起施行。该条例共包括7章60条,主要涵盖以下内容:站长网2023-10-25 09:31:320000“越南李佳琦”,快被中国人造出来了

“像胡志明这样的大城市,到处都看得见快递小哥。越南是摩托车王国,他们骑着摩托车去送货、提货,很方便。”新媒体“中越plus”越南区负责人刘生对霞光社说道。站长网2023-06-11 22:41:500001