MIT斯坦福Transformer最新研究:过度训练会让中度模型“结构顿悟”

要点:

经过过度训练,中度模型如Transformer表现出结构性泛化能力,被称为"结构顿悟"(Structural Grokking)。

研究发现,对于Transformer类模型,长时间训练后,模型在泛化到新结构输入时能够有效地捕捉到句子的层级结构。

结果显示,模型的深度对结构顿悟呈倒U形缩放,中深度模型的泛化能力较深度和浅度模型更强。

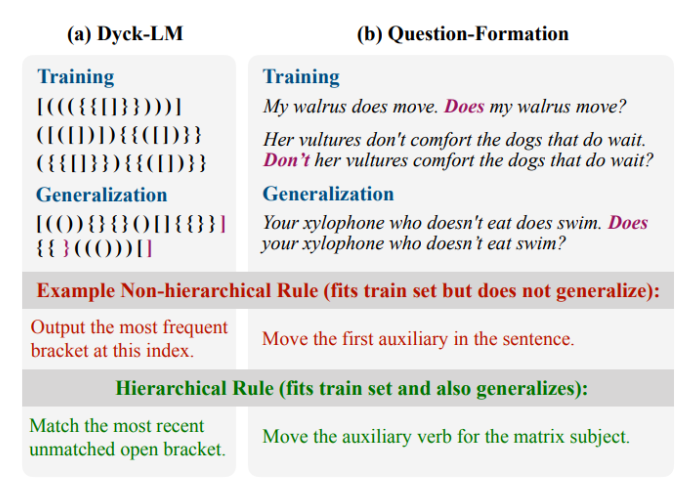

最新研究指出,经过过度训练,中度的Transformer模型能够展现出结构性泛化能力,这一现象被称为"结构顿悟"。在自然语言处理中,先前的研究认为像Transformer这样的神经序列模型在泛化到新的结构输入时难以有效地捕捉句子的层级结构。

论文地址:https://arxiv.org/pdf/2305.18741.pdf

然而,斯坦福和MIT的研究人员发现,通过对Transformer类模型进行长时间的训练,模型能够获得这种结构性的泛化能力。他们将这一现象命名为"结构顿悟",形容为神经网络经历了一个"aha moment",在训练的某一刻忽然实现了对层级结构的理解。这种现象的发生被证明在不同数据集上呈现出倒U形的深度缩放,中深度模型的泛化能力表现最佳。

研究进一步指出,提前停止训练会导致泛化性能被低估,而中度深度的Transformer模型在泛化到新结构输入时呈现出显著的优势。研究还分析了结构顿悟的内部属性,包括参数权重的L2norm、注意力稀疏性和模型的树结构性。结果显示,中度深度模型在这些属性上表现出最佳的结构顿悟,而权重范数和注意力稀疏性的动态变化与模型的泛化性能密切相关。

这项研究为理解神经序列模型的泛化机制提供了新的视角。通过揭示结构顿悟的存在,研究强调了模型深度与泛化性能之间的关系,并为改善自然语言处理模型的泛化能力提供了有价值的启示。这一发现有望在未来的深度学习研究中引起更多关注,为模型设计和训练策略提供指导。

WEKA与Stability AI推出“云数据平台融合模式”解决方案

数据管理平台WekaIO(WEKA)与StabilityAI合作,推出了一项名为WEKADataPlatformConvergedModeforCloud(云数据平台融合模式)的新解决方案,旨在增强StabilityAI在云中训练多个AI模型的能力。站长网2023-09-18 09:41:430000Artifact 新闻应用程序强制 AI Snoop Dogg 为用户朗读新闻

据国外媒体报道,周四,Artifact新闻应用程序宣布将添加语音转文本功能,允许用户使用由Speechify提供支持的人工智能语音来收听文章。该更新应该免费提供给所有iOS用户,并且该功能应该会在不久的将来在Android上推出。站长网2023-07-28 14:50:160000高德地图:车道级导航已支持国内99%以上城市和乡镇道路

高德地图近日宣布,他们已经成功研发出全球覆盖规模最大的车道级导航服务,该服务基于北斗卫星导航系统、深度学习模型、惯性导航、泛在信号等前沿技术。目前,这项服务已经支持国内99%以上的城市和乡镇道路使用。0001国产手机AI操作系统长这样:订票动口不动手,模糊照片秒变4K,随时随地问答

手机厂商动作频繁的10月,OPPO也带着搭载系统级AI的新系统闪亮登场。这次,OPPO在全新发布的ColorOS15中,配置了许多超强的AI能力:通过全新升级的小布(语音)助手,可以随时随地询问屏幕上显示的任何内容;在拍照时,可以利用一系列的AI算法,让拍废了的照片也能秒变大片;文档和写作助手,让你不仅能跨应用检索文件,还能根据屏幕内容智能写作……站长网2024-10-23 14:09:560000Tabnine推出AI助手Tabnine Chat 加快代码交付速度

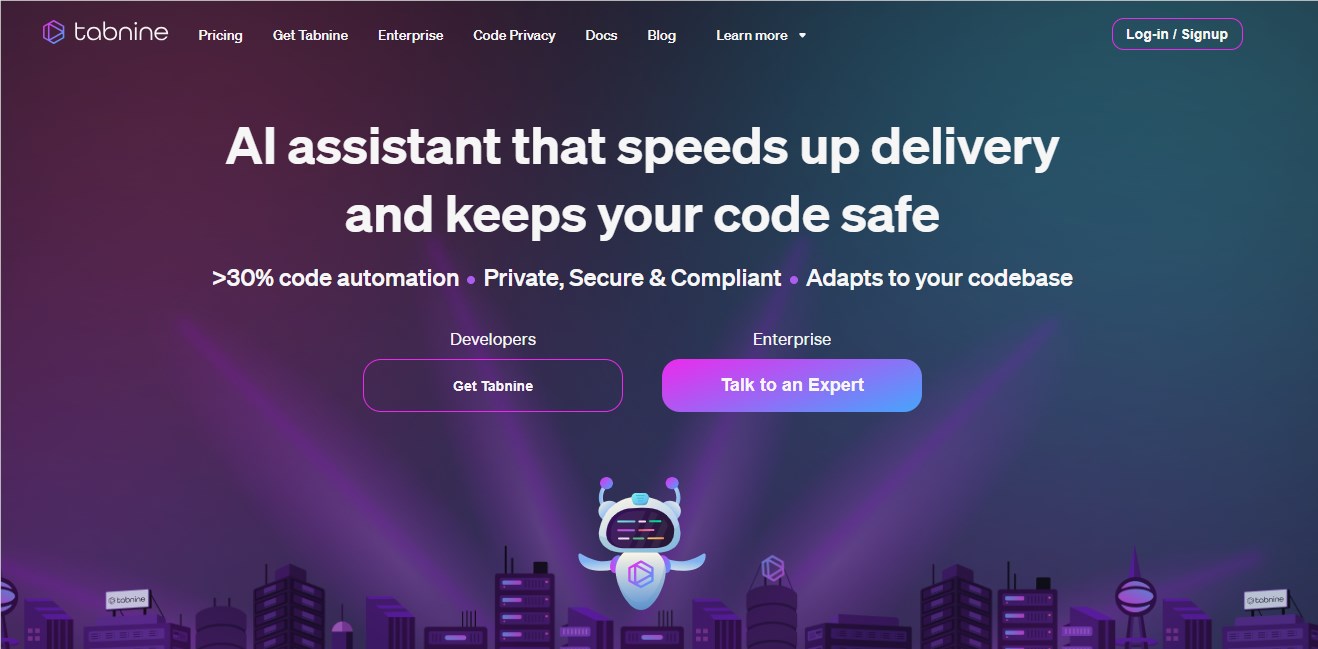

Tabnine推出了TabnineChat,这是一款企业级的以代码为中心的聊天应用程序,可以让开发人员使用自然语言与Tabnine的AI模型进行交互。该应用程序可以无缝集成到开发人员的集成开发环境(IDE)中,扩展了其功能,可以使用现有的代码进行解释,搜索代码库,并根据自然语言规范生成新代码。TabnineChat的一个重要亮点是它对安全性和合规性的强调。站长网2023-08-17 15:37:330000