牛津大学AI研究员发出警告:大语言模型对科学真相构成风险

**划重点:**

1. 🤖 AI研究员指出大型语言模型(LLMs)可能对科学完整性构成威胁。

2. 🧠 牛津研究呼吁改变LLMs的使用方式,建议将其作为“零射击翻译器”以确保输出的事实准确性。

3. 📢 研究强调,信任LLMs作为可靠信息来源可能导致科学真相受损,呼吁负责任的LLMs使用。

在最新的一篇研究中,牛津大学互联网研究所的人工智能研究员发出了对大语言模型(LLMs)对科学真相构成威胁的警告。由Brent Mittelstadt、Chris Russell和Sandra Wachter等研究员在《自然人类行为》期刊上发表的论文中,他们指出,基于GPT-3.5架构等LLMs并非绝对的真实信息来源,可能产生他们所称的“幻觉”——即不真实的回应。

图源备注:图片由AI生成,图片授权服务商Midjourney

一年前,科技巨头Meta发布了一款名为“Galactica”的大型语言模型,旨在协助科学家。然而,与Meta期望相反,“Galactica”在经历了三天的激烈批评后黯然失色。一年后,在科学研究领域对LLMs的依赖仍然未有显著改变。

研究呼吁改变LLMs的使用方式,建议将其作为“零射击翻译器”。与其依赖LLMs作为知识库,用户应提供相关信息并指导模型将其转化为期望的输出。这种方法有助于更容易验证输出的事实准确性和与提供的输入一致性。

论文中指出的核心问题在于这些模型训练所使用的数据的性质。设计用于提供有用且具有说服力回应的语言模型,缺乏对其准确性或与事实一致性的保证。在从在线内容获取的大规模数据集上进行训练,其中可能包含虚假陈述、观点和创造性写作,使LLMs接触到非事实信息。

Mittelstadt教授强调了用户信任LLMs作为可靠信息来源的风险,类似于人类专家。由于它们被设计成听起来像人类的代理,用户可能会被误导,即使回应缺乏事实依据或呈现事实的偏见版本,也会接受其准确性。

为了保护科学真相和教育免受不准确和有偏见信息的传播,研究呼吁对LLMs的负责任使用设定明确期望。论文建议用户,特别是在准确性至关重要的任务中,应提供包含事实信息的翻译提示。

Wachter教授强调了在科学界负责任使用LLMs的作用以及对事实信息的信心的重要性。研究呼吁警惕如果LLMs在生成和传播科学文章中被随意使用可能导致的严重危害。

Russell教授强调了对LLMs提供的机会进行谨慎考虑,并促使反思这项技术是否应该因为它能够提供某些机会而被授予这些机会。

华农兄弟的竹鼠回归,为什么让百万网友泪目?

今夕是何年。特朗普当选总统,守望先锋6V6怀旧服上线,索尼推出Pro型号主机,腾讯和卡普空合作推出新的怪物猎人游戏,李子柒发了新视频。就连华农兄弟,也重新养起了竹鼠。我的头脑一阵恍惚,感觉这七八年时间,像是穿插进来的某段错位时空,而现在时间线重新收束,整个世界的主线剧情,终于又要继续推进了。看到老刘重新拎起伊丽莎白鼠的那一刻,仿佛读取了一个老存档。我的朋友,回来了,都回来了。站长网2024-11-19 09:47:180000腾讯《穿越火线》外挂案破获:非法侵入计算机信息系统程序!

快科技2月5日消息,日前,腾讯游戏安全中心官方发文称,近日,在《穿越火线》安全团队的全力协助下,山东济宁汶上县公安局成功破获一起外挂案。共有8名犯罪嫌疑人因涉嫌提供侵入计算机信息系统工具罪而被抓获。据介绍,2023年9月,汶上县某居民向汶上县公安局网安大队报案,他在网络上购买并使用了一款名为草莓熊”的外挂软件,结果导致自己的游戏账号被封。0000檀健次长相思AI角色热度破亿:由腾讯元宝专属定制

随着《长相思2》的开播,观众不仅能够追剧,还能通过与剧中角色的互动体验成为故事的一部分。腾讯元宝公司为这部剧打造了角色AI,使粉丝能够与角色如小夭、玱玹、涂山璟、相柳等进行对话和互动,甚至定制专属的AI角色。站长网2024-07-25 15:29:490000独家:AI大模型时代或更集中到“强”团队

时间拉回到2015年,梁斌刚刚获得清华大学人工智能博士学位,同年10月八友科技成立,并常年为客户提供国内外数据资料。2023年上半年,GPT大模型进入公众视线,短短半年时间,国内就已有近百家GPT大模型,“八友”成为绝大多数大模型服务商的首选,据统计,这一数字接近50%。站长网2023-09-13 17:08:350000私域里“人货场”的构建模型

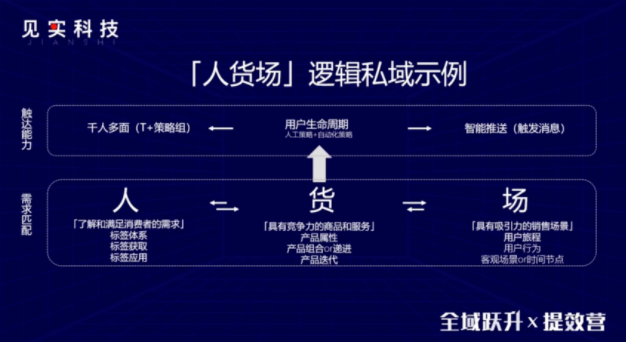

商业逻辑里的“人-货-场”其实也同样可以贯穿到私域里。把产品当成“货”,把私域用户当成“人”,“场”刚好对应场景。变换之后这个逻辑仍然成立。“人”的部分需要了解并能够满足用户的需求,涉及标签体系的设计、获取、应用;“货”需要重点关注产品属性、产品组合/递进、产品迭代;“场”涉及用户旅程、用户行为、客观场景和时间节点几部分。站长网2023-04-23 16:02:370006