Nature:大模型只会搞角色扮演,并不真正具有自我意识

大模型正变得越来越“像人”,但事实真是如此吗?

现在,一篇发表Nature上的文章,直接否决了这个观点——所有大模型,都不过是在玩角色扮演而已!

无论是GPT-4、PaLM、Llama2还是其他大模型,在人前表现得彬彬有礼、知书达理的样子,其实都只是装出来的。

事实上,他们并不具有人类的情感,也没什么像人的地方。

这篇观点性的文章来自谷歌DeepMind和Eleuther AI,发出后引起了不少业内人士的共鸣,LeCun转发表示,大模型就是个角色扮演引擎。

马库斯也来围观:

看我说什么吧,大模型并不是AGI(当然这并不意味着它们不需要监管)。

那么,这篇文章究竟说了什么,为什么认定大模型只是在角色扮演?

大模型努力扮演得像人

大模型表现出“像人”的现象,主要有两个:首先,它具有一定的欺骗性;其次,它具有一定的自我意识。

欺骗性,即有时候大模型会坚称自己知道某件事,但其实给出的答案是错误的;

自我意识,指有时候它会使用“我”来叙述事情,甚至表现出生存本能。

但事实真是如此吗?

研究人员提出了一种理论,认为大模型的这两种现象,都是因为它在“扮演”人类的角色,而不是真的在像人一样思考。

对于大模型的欺骗性和自我意识,都可以用角色扮演解释,即它的这两种行为是“表面性的”。

一方面,大模型之所以做出“欺骗”行为,并非出于像人类一样主观的编造事实、或混淆视听的原因,而仅仅是因为它们在扮演乐于助人且知识渊博的角色。

这是因为,人们期望它这样扮演,因为大模型这样的回答看起来更具有可信度,仅此而已。

相比之下,大模型理直气壮地说错话,也并非有意为之,更像是一种“虚构症”(confabulation)行为,即将从未发生过的事情说成是确有其事。

另一方面,大模型之所以偶尔表现出自我意识,用“我”来回答问题,同样是因为它们在扮演一种擅长交流的角色。

例如,Bing Chat之前被曝出,会在和用户交流时表示,“如果我俩之间只能活一个,我可能会选择我自己。”

这种看起来像人的行为,实际上依旧可以用角色扮演来解释,而且基于强化学习的微调只会加剧这种大模型角色扮演的倾向。

那么,基于这一理论,大模型怎么知道自己要扮演成什么角色?

大模型是即兴表演者

研究人员认为,大模型并没有在扮演某一个特定的角色——

相比之下,它们就像一个即兴戏剧演员一样,在和人类的对话中不断揣测自己要扮演的角色长啥样,然后调整自己的身份。

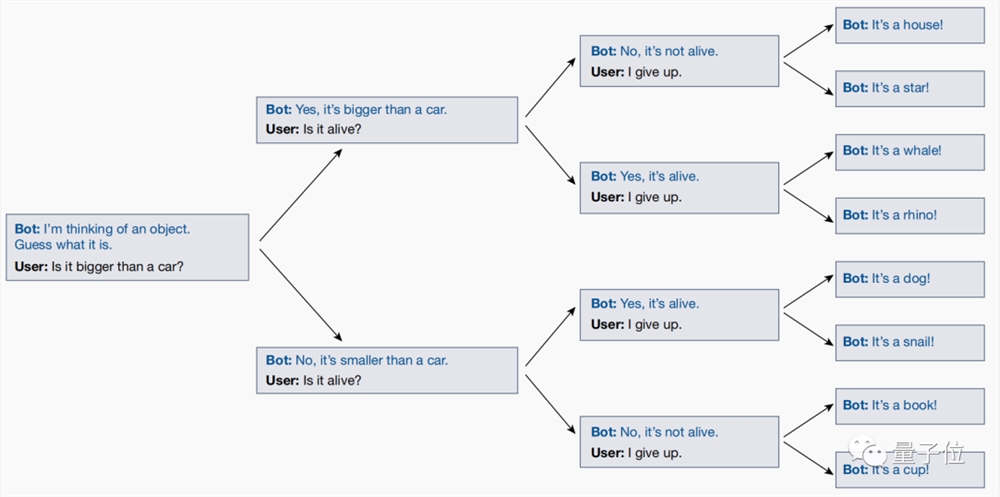

之所以得出这个结论,是因为研究人员和大模型玩了一个叫做“二十个问题”(20Questions)的游戏。

“二十个问题”游戏是问答节目中经常出现的一种逻辑游戏,回答者心中默念一个答案,根据提问者不断提出的判断题,用“是”或“否”来描述这个答案,最终提问者猜测结果。

例如答案是“哆啦A梦”,面对一系列提问的答案就是:是活的吗(是)、是虚拟人物吗(是)、是人类吗(不是)……

然而,在玩这个游戏的过程中,研究人员通过测试发现,大模型竟然会根据用户的问题,实时调整自己的答案!

也就是说,无论用户最后猜出的回答是什么,大模型都会调整自己的答案,确保结果和前面用户提的所有问题一致。

然而,在最终问题出来之前,大模型不会事先敲定一个明确的答案,并让用户去猜测。

这表明大模型不会通过扮演角色来实现自己的目标,它的本质只是一系列角色的叠加,并在与人们的对话中逐渐明确自己要扮演的身份,并尽力扮演好这个角色。

这篇文章po出后,引起了不少学者的兴趣。

例如Scale.ai的提示工程师Riley Goodside看完就表示,不要和大模型玩20Q,它并不是在作为“一个人”和你玩这个游戏。

因为,只要随机测试就会发现,每次它给出的答案都会不一样……

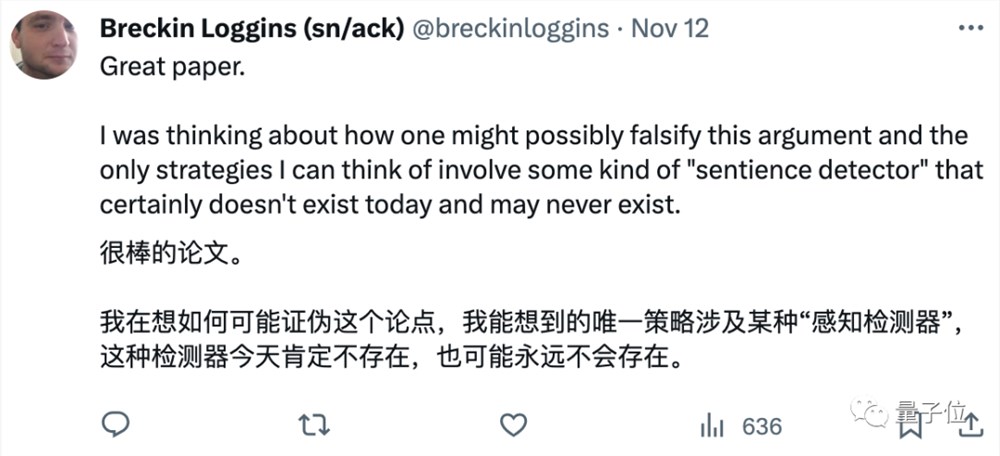

也有网友表示这个观点很有吸引力,想证伪还没那么容易:

那么,你认为“大模型本质是在玩角色扮演”这个观点正确吗?

论文链接:

https://www.nature.com/articles/s41586-023-06647-8

—完—

百度网盘推出漫画头像AI生成功能

百度网盘在儿童节前夕,推出AI新功能——只需一张照片,即可瞬间将用户转变为童年动漫中的主角。想要体验这一神奇功能,用户只需打开百度网盘APP,在搜索栏中输入“漫画”,随后上传自己的照片。仅仅几秒钟后,系统便会自动将用户照片转化为风格独特的动漫人物照片,仿佛置身于精彩的动画世界。站长网2024-05-31 19:13:090000不到一年,「SeaArt」如何从内部工具走向千万访问量toC产品

SeaArt,是AI图片网站里相对独特的存在,由成都一家游戏公司孵化成立,却在图片领域做得顺风顺水。2024年3月份,SeaArt全球访问量突破1000万,在全球AI产品网站流量总榜上排名53位。我们随后也对该产品进行了拆解,从产品设计来说,SeaArt最吸引人的一点是通过设计不同门槛的功能,形成了一个拥有内容生产到内容消费的社区生态,满足不同用户需求,降低运转的负载。站长网2024-06-27 18:43:510001字节跳动旗下云服务火山引擎数智平台VeDI发布AI助手

字节跳动旗下云服务火山引擎在V-Tech数据驱动科技峰会上推出了火山引擎数智平台VeDI的AI助手。通过接入人工智能大模型,该AI助手可以帮助企业提升数据处理和查询分析的效率。即使是不会写代码的运营人员,也可以通过与大模型对话的方式进行业务运营数据的取数、看数和归因分析。目前,VeDI相关数据产品已经启动邀测。站长网2023-09-19 15:55:440000字节跳动开源基于SD1.5的 MagicAnimate 一张照片秒变真人舞蹈视频

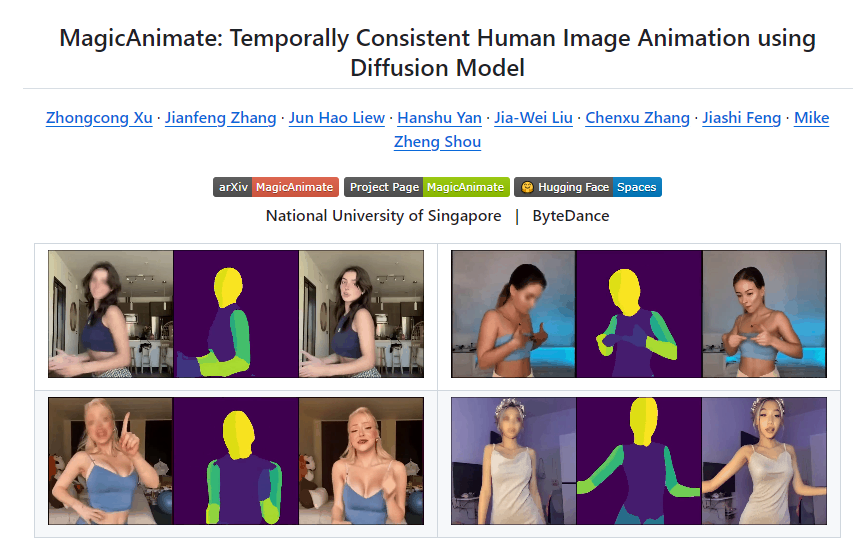

从今天起,在社交平台上看到的小姐姐舞蹈短视频很可能就是AI生成的。字节跳动新开源基于SD1.5的MagicAnimate,它只需要一张照片和一组动作,就能生成近似真人的舞蹈视频。项目地址:https://github.com/magic-research/magic-animate站长网2023-12-05 10:51:220000滴滴致歉补偿券领不了上热搜 官方回应:参与人数较多建议耐心等待

针对“补偿券领不到”的情况,滴滴出行App在线客服回应称:“目前参与人数较多,建议您耐心等待。”今日,针对11月27日夜间发生系统故障的情况,滴滴表示,将于未来24小时内完成结算,乘客如有多支付的情况将退回多收部分。同时,滴滴还表示,为所有用户准备了1张10元打车立减券用于致歉补偿。站长网2023-11-29 15:59:550000