微软宣布 Sam Altman 和 Greg Brockman 加盟,领导新的高级 AI 研究团队

站长网2023-11-20 16:29:512阅

微软公司的首席执行官 Satya Nadella 在周一表示,Sam Altman、Greg Brockman 以及他们的许多前 OpenAI 同事将加入这家软件巨头。这一宣布标志着在 AI 初创公司的高管突然离职后,经过三天激烈讨论高潮的句号。

在微软,前 OpenAI 成员将领导一个「新的高级 AI 研究团队」,Nadella 在一份声明中说。「我们期待迅速为他们提供成功所需的资源,」他补充道。

这一举措是微软在人工智能领域的一个重大突破,不仅增强了其在这一迅速发展的技术领域的地位,还表明了其对顶尖 AI 人才的重视。Altman 和 Brockman 的加入,以及他们在 OpenAI 的前同事们的集体加盟,将为微软在 AI 研究和开发方面带来新的动力和创新。

微软对这些新团队的高度投入和对其研究的重视,预示着该公司将在 AI 领域发挥更加重要的作用。随着 AI 技术的不断进步和应用的广泛化,微软的这一举措可能会对整个行业产生深远的影响。

Altman 和 Brockman 在 OpenAI 的经验和专长,结合微软的资源和技术能力,预示着未来可能出现更多创新和领先的 AI 解决方案。此外,这也可能加强微软在与其他科技巨头竞争中的地位,特别是在与 Google、Amazon 和 Meta 等公司的竞争中。

Nadella 似乎还证实了 Emmett Shear 被任命为 OpenAI 新任首席执行官的报道,称他们 「期待着了解 Emmett Shear 和 OAI 的新领导团队,并与他们合作」。

0002

评论列表

共(0)条相关推荐

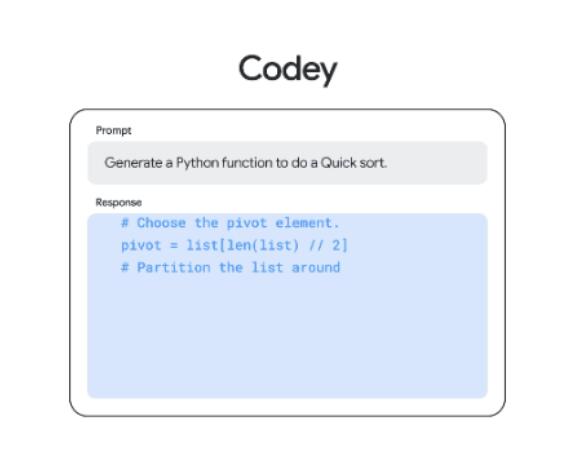

谷歌 Colab 添加 AI 编码功能,包括代码生成和聊天机器人

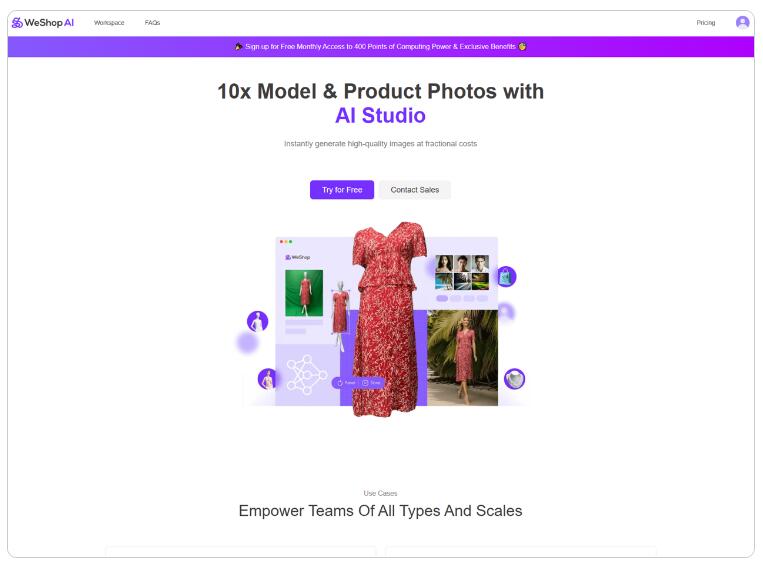

AI自动编码将上线!GoogleColaboratory(Colab)将添加新的AI编码功能,包括代码生成、代码完成和编程聊天机器人。新功能将免费使用,并将得到能够与GPT-4竞争的PaLM2模型的支持。新功能将减轻重复编码任务的负担,让开发人员能够专注于更有价值的编程和数据科学任务。添加AI驱动的代码生成、完成和聊天机器人将使开发人员的机器学习开发更加方便。站长网2023-05-18 15:50:020000国内首款AI商拍工具——WeShop 可给真人模特一键换衣

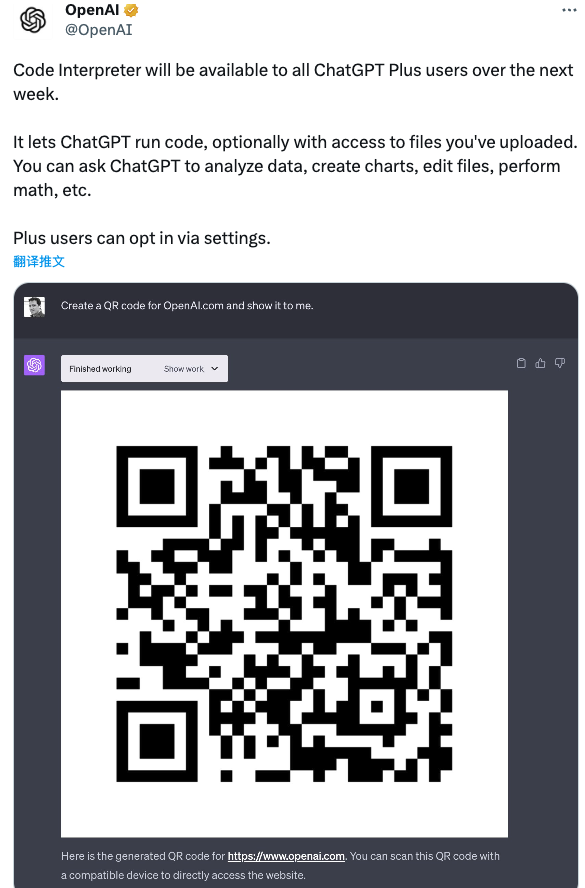

站长网2023-07-27 16:58:5700023ChatGPT 最强代码解释器突破“封印”:30 秒出片、5 分钟制作游戏、可视化分析...样样精通!

20美元,雇佣一位非常擅长数据分析的个人AI助理,到底值不值?现在,OpenAI正在让用户这20美元花得更值。站长网2023-07-16 05:52:280001商汤回应自研大模型图片生产质疑:也提供第三方开源模型

据财联社报道,针对商汤技术交流日上精选模型出现AI模型站civitai的图片一事,商汤方面表示,秒画SenseMirage包含商汤自研AIGC大模型,也提供第三方社区开源模型,支持导入多个平台的开源模型或上传用户本地模型。用户可免除本地化部署流程,并基于开源模型自训练模型,高效地生成更多样的内容。站长网2023-04-12 16:41:410000代号灭霸!vivo X100 Ultra春节后登场:蓝厂最顶级机皇

快科技1月26日消息,vivo贾净东在一场活动中透露,vivo会在春节后发布一款顶级旗舰以及一款顶级折叠屏。其中直板旗舰代号灭霸”,这将是vivoX100系列的超大杯版本,博主数码闲聊站透露,该机将被命名为vivoX100Ultra。据爆料,vivoX100Ultra后置5000万像素广角主摄、5000万像素超广角、2亿像素潜望长焦。站长网2024-01-27 07:47:400001