Nvidia发布开源工具包NeMo Guardrails,使文本生成式AI“更安全”

站长网2023-04-27 09:50:090阅

为了追求“更安全”的文本生成模型,Nvidia 日前发布了开源工具包NeMo Guardrails,旨在使基于 AI 应用程序更加“准确、合理、切合主题和安全”。

Nvidia 应用研究副总裁 Jonathan Cohen 表示,该公司“多年来”一直致力于 Guardrails 的底层系统,但大约一年前才意识到它非常适用于 GPT-4和ChatGPT等模型。

Guardrails 包括代码、示例和文档,可为生成文本和语音的 AI 应用程序“增加安全性”。Nvidia 声称该工具包旨在与大多数生成语言模型一起使用,允许开发人员使用几行代码创建规则。

具体来说,Guardrails 可用于防止——或至少试图防止——模型偏离主题、以不准确的信息或极为负面的语言做出响应,以及与“不安全”的外部来源建立联系。例如,阻止搜索引擎聊天机器人链接到声名狼藉的学术期刊等等。

Cohen 还指出,Guardrails 最适用于“很擅长执行指令”的模型,例如 ChatGPT,并且使用流行的LangChain框架来构建 AI 驱动的应用程序。然而,Nvidia 承认该工具包并不完美,也无法涵盖所有问题。

虽然 Guardrails 是一个开源版本,但 Nvidia 更希望其它公司为其托管版本付费。

0000

评论列表

共(0)条相关推荐

腾讯推出新自研AI引擎:游戏研发效率提升超40倍

快科技7月30日消息,日前在ChinaJoy高峰论坛上,腾讯公司副总裁张巍表示,AI在游戏领域已经成为研发标配”。腾讯于今年推出了新的自研AI引擎,能够让游戏场景制作、内容生成等领域的部分工作效率提升40倍以上。据了解,腾讯是较早系统化布局AI研发的企业之一,从2016年成立AILab,到去年推出混元大模型,相关研究已在游戏、社交、数字人等领域广泛落地。站长网2024-07-30 16:46:420000PC掌机这块蛋糕,如今英伟达似乎也看上了

如今这一波AI浪潮的引领者显然非OpenAI莫属,从ChatGPT到GPT-4、再到Sora,无不证明了OpenAI的成功,但这家公司并不没有吃到最大红利,真正闷声发大财的反而是英伟达。英伟达所扮演的无疑是“淘金热中卖水”的角色,向AI厂商出售算力成就了其公司市值在2023年上涨238%,到了2024年继续大涨66%的关键。站长网2024-03-17 17:42:070000世界卫生组织概述对卫生领域人工智能的监管考虑

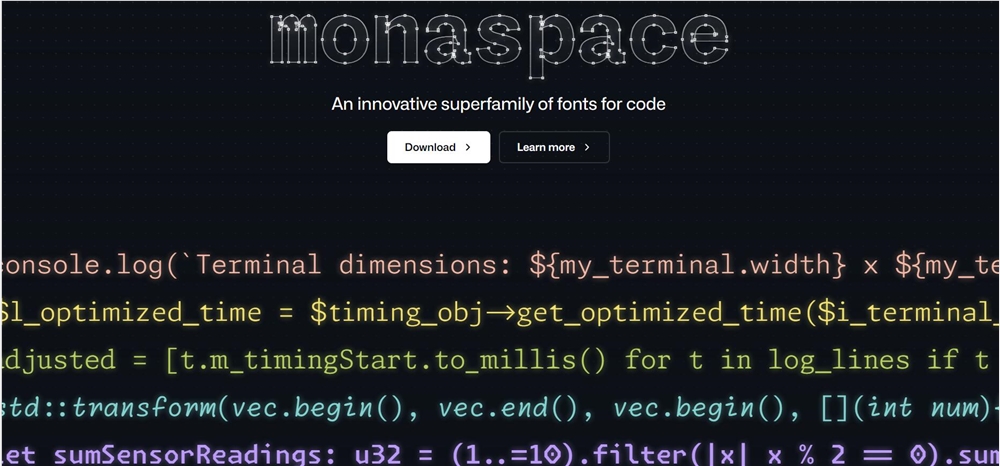

站长之家(ChinaZ.com)10月20日消息:世界卫生组织今天发布了一份新的出版物,强烈呼吁加强对医疗行业使用人工智能的监管,以防止人工智能的滥用。这份出版物突出强调,必须建立安全有效的人工智能系统,迅速向有需要的人群提供适当的系统,并促进利益攸关方之间的对话,包括开发人员、监管机构、制造商、卫生工作者和患者。站长网2023-10-20 10:38:000000GitHub发布编程字体家族Monaspace 支持混合使用5款等宽字体

站长之家(ChinaZ.com)11月10日消息:近日,代码托管平台GitHub发布了一套名为Monaspace的开源编程字体家族。这套字体家族包含5种字体,分别是Neon、Argon、Krypton、Xenon和Radon。站长网2023-11-10 15:19:0600002023年,自媒体的日子更艰难了

1、2023年自媒体日子更艰难了。前段时间有同行说,一些百万粉的头部公众号都难接单了,有的在调低刊例价,有的不得不接一些过去不愿接的广告。很多人盼着疫情结束了市场会景气起来,但疫情真结束了才发现行情更差了。站长网2023-04-13 09:04:580000