Meta重磅更新,小扎在元宇宙里养了会做家务的狗!人形化身超逼真,AI智能体在真实物理世界和人互动

【新智元导读】今天,Meta重磅发布了Habitat3.0,经它训练的AI智能体,学会了找人,还能帮人打扫房间。社交智能机器人,进入下一个里程碑!

今天开始,人类离帮忙做家务的机器人,又近了一步!

Meta宣布推出Habitat3.0,目的是开发出社会化的AI智能体,这意味着社交智能机器人已经进入新的里程碑阶段。

这些具身智能背后的关键,当然就是AI Agent。有了它们,机器人可以和人类协作,帮人类完成日常任务。

论文地址:https://ai.meta.com/static-resource/habitat3

项目地址:https://github.com/facebookresearch/habitat-lab/tree/v0.3.0

其实,Meta在今天同时宣布了三项重大进展——

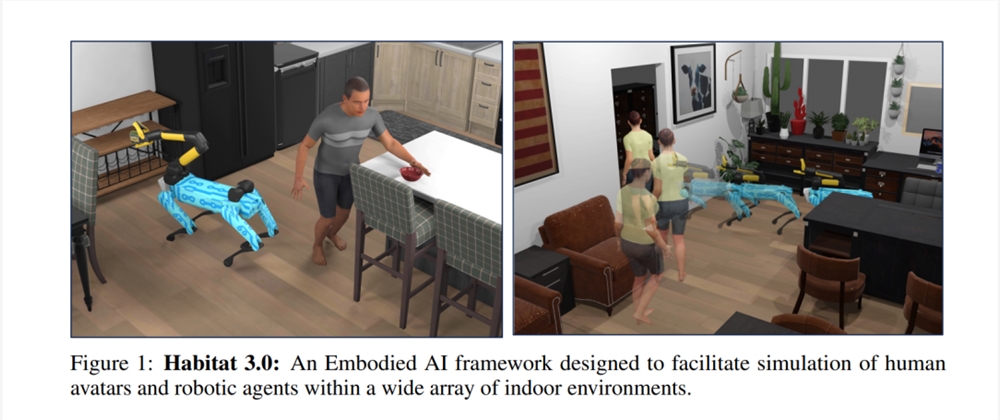

1. Habitat3.0是第一个支持在多样化、逼真的室内环境中,就人机交互任务进行大规模训练的模拟器。

它能同时支持机器人和人形化身,让人类和机器人在家庭环境中协作,比如帮忙打扫房间。

2. Habitat合成场景数据集(HSSD-200),是由艺术家创造的三维数据集,包含211个场景中466个语义类别的18,000多个对象。

HSSD-200在同类数据集中质量最高,可以训练导航智能体,对物理世界三维重建场景的泛化效果非常好,使用的场景数量也要少两个数量级。

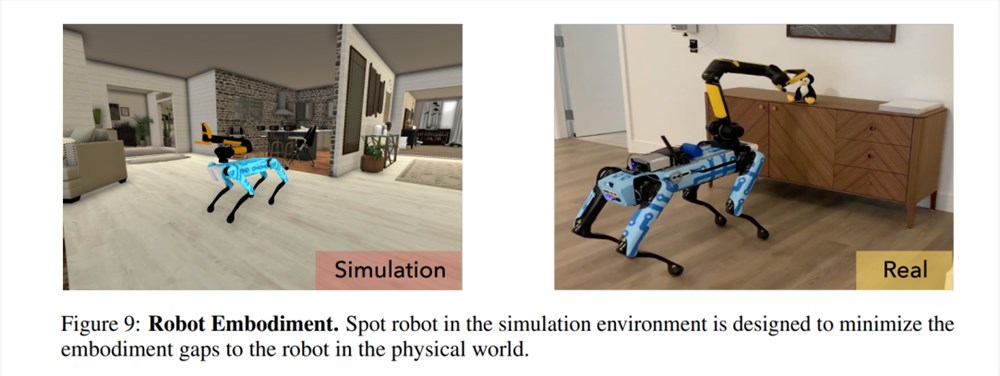

3. HomeRobot则是一个家用机器人助手硬件和软件平台,非常经济实惠,机器人可以在模拟和物理世界环境中,执行开放的词汇任务。

在大规模学习上,Habitat3.0在单GPU上每秒可以完成超过1000步。

网友:能干家务的机器人什么时候出来

网友们表示:这是机器人技术的重大飞跃。

还有人感慨:这是非常高级的模拟人生游戏。

已经有人期待在Meta Quest VR中体验 Habitat3.0了。

Dream一下,家政辅助机器人应该不远了。

Habitat3.0

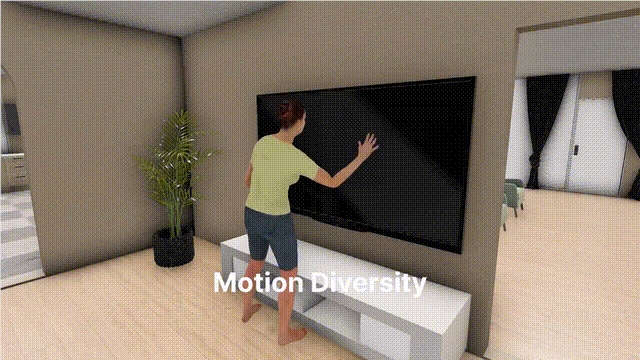

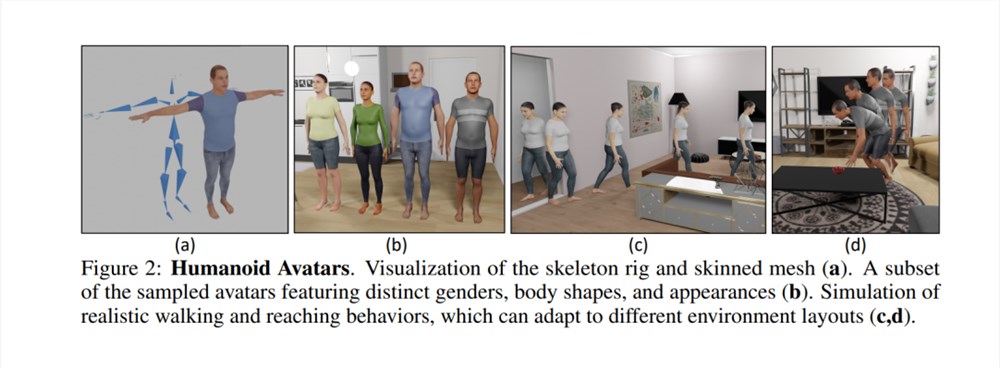

利用Habitat3.0,Meta不仅在外貌和姿势上对人类进行了真实的模拟。

而且,还支持从简单(如行走和挥手)到复杂(如与物体交互)等各种类型的动作,并兼容动捕。

此外,虚拟化身还可以通过程序进行控制,并且不会出现性能下降——人-机模拟速度跟机器人-机器人模拟速度类似。

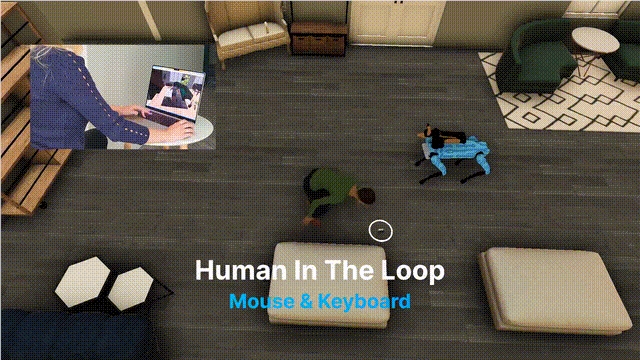

人在回路

Habitat3.0的另一个关键特征,就是「人在回路」了。

通过鼠标、键盘或VR,我们可以实现效果惊人的人机交互控制。

完成任务后,系统会收集机器人的策略和数据,并进行人机交互的评估。

社交任务

此外,Habitat3.0还可以模拟多种真实的社交场景。

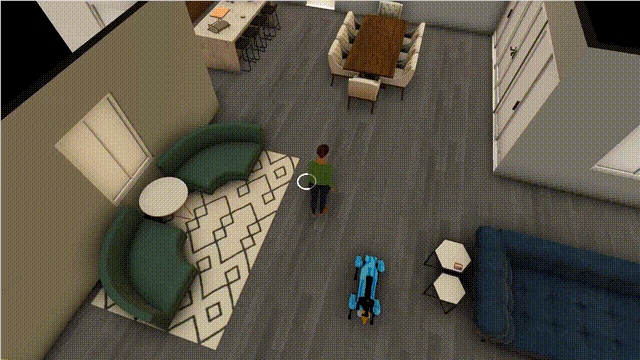

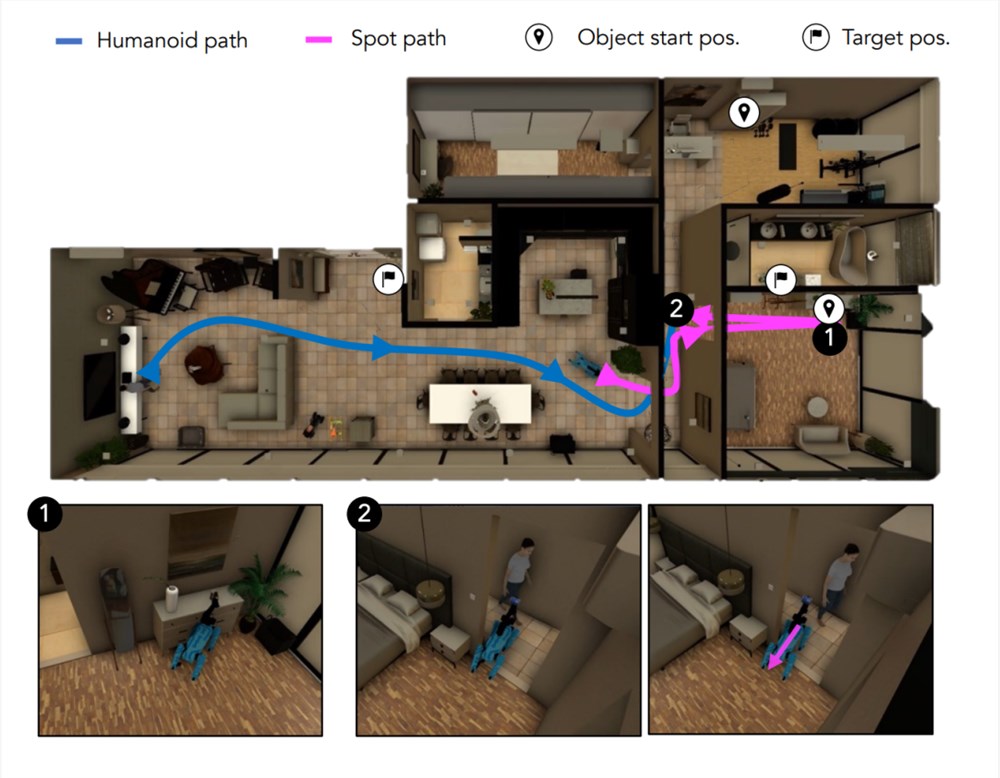

比如在被称为社交导航的任务中,机器人需要在保持安全的同时找到并跟随人类。

在另一项任务中,机器人需要和人类共同协作,完成诸如整理房间的任务。

这时人和机器人需要分别走到目标位置,其中,机器人需要想办法尽可能高效地和人类共同实现这一目标。

经过训练的机器人,可以实现各种社会行为!

除了能和人类保持安全距离外,机器人还会在必要时自己后退,给人类留出走路的空间。

让AI智能体在真实世界和人类互动

以往,当我们想到AI助手时,想到的通常是基于网络的聊天机器人,或者智能扬声器。

而Meta的研究者们一直希望实现具备通用智能的具身AI Agent,让它们可以感知环境,在数字和物理世界中和人类沟通、帮助人类。

其中一个愿景,就是做出全天可穿戴的AR头显,供人类使用。

另外,研究者们还在改进社交智能机器人背后的技术,让它们帮人类干家务,还能适应人类对于伴侣要求的个性化偏好。

工作主要集中在深入研究嵌入式系统,让下一代的AR和VR体验更佳。

不过,在物理硬件(无论是机器人还是AR眼镜)上与真人一起训练和测试具身AI智能体,会有一些可扩展性限制,还可能存在安全问题。

这就需要建立标准化的基准程序。

因此,Meta的研究者们开发了一套新工具,用于跨模拟器、数据集的机器人研究。

他们还开发了一个包含软硬件的技术堆栈,让这方面的研究更容易,也更实惠。

为了快速提高机器人能力,研究者在模拟器中开发和测试新的算法和模型,然后移植到实体机器人上。

几年以来,Habitat模拟器取得了许多显著的进步。

在Habitat1.0训练的虚拟机器人,能以每秒超过10,000步(SPS)的速度,在物理世界房屋的三维扫描中导航。

Habitat2.0引入了交互式环境(例如,可拿起的物品、可打开的抽屉),并训练虚拟机器人通过重新排列物品来清理房屋。

Habitat3.0在此基础更进一步,能够同时支持机器人和人形化身,实现人机协作完成日常任务,比如整理客厅、在厨房准备食谱。

这就开辟了新途径,研究人类与机器人在多样化、逼真、视觉和语义丰富的任务中的协作。

另外,Habitat3.0还支持具有逼真外观、自然步态和动作的人形化身,可以模拟逼真的低级和高级交互。

这些人形化身既可由学习到的策略控制,也可由真人通过「human-in-the-loop」界面进行控制。

这个界面支持键盘、鼠标以及VR头显。

人与机器人在模拟环境中的共存,使人类能够首次在类似家庭的环境中,在有人形化身存在的情况下,学习机器人AI策略,完成日常任务,并对其进行评估。

这无疑具有重大意义——

1. 强化学习算法通常需要数百万次的迭代,才能学习到有意义的知识,因此在物理世界中进行这些实验可能,需要数年时间。

而在模拟实验中,几天就能完成。

2. 在物理世界的不同房屋中收集数据是不切实际的,因为这需要将机器人移动到不同的地方,还要设置环境。

而在模拟中,可以在几分之一秒内改变环境,然后立马在新环境中开始实验。

3. 如果模型没有训练好,机器人就有可能破坏环境,或者伤害物理世界中的人。

而模拟器能够让研究者在安全的环境中测试方法,然后再将其部署到物理世界中,这样就保证了安全。

4. 当今最先进的AI模型,需要大量数据进行训练,而模拟使研究者能够轻松地扩大数据收集规模。

而在物理世界中,数据收集的成本可能相当高,速度也会很慢。

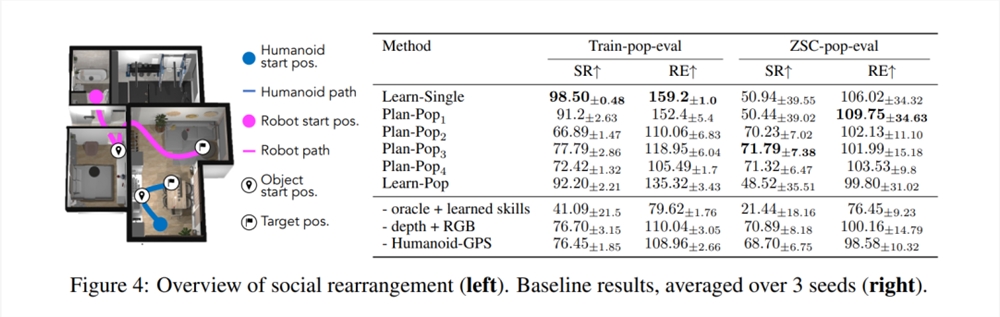

而且,研究者还提出了两个高度相关的任务和一套基准,以建立社会化具身AI领域的基准。

第一个任务是「社交整理」,涉及机器人和人形化身协同工作,执行一系列拾放任务,比如清理房屋。

在这项任务中,机器人和人类必须协调行动,以实现共同目标。大规模的模拟训练后,就会产生这种智能行为。

第二项任务是「社交导航」,让机器人在保持安全距离的情况下,定位并跟踪一个人。

Habitat合成场景数据集

三维场景数据集对于在模拟环境中训练机器人来说至关重要。

目前,虽然已经有不少数据集可支持对训练数据进行扩展,但我们并不了解数据集规模与真实性之间的权衡。

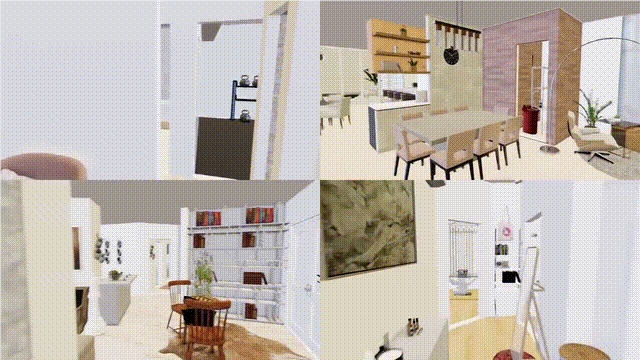

为此,Meta推出了一个全新的合成三维场景数据集——HSSD-200。

它由211个代表实际室内环境的高质量三维场景组成,包含了来自466个语义类别的18,656个物理世界物体模型。与之前的数据集相比,更加接近真实的物理场景。

具体来说,HSSD-200提供了更高质量,且完全由人工制作的3D室内场景,并包括了与WordNet本体相对应的细粒度语义分类。

此外,HSSD-200的资产压缩功能,还可实现高性能的人工智能模拟。

场景方面,HSSD-200采用了Floorplanner室内设计界面进行制作,布局主要是对实际房屋的再现。

其中,单个对象由专业的3D艺术家创建,在大多数情况下与实际的家具和电器相匹配。

实验表明,规模较小但质量较高的HSSD-200数据集,可以生成以物品为导航目标的(ObjectNav)智能体,其性能可与在规模更大的数据集上训练的智能体相媲美。

而且,在HSSD-200上训练智能体所需的场景数量,要少2个数量级——

与使用10,000个ProcTHOR场景训练出的智能体相比,使用122个HSSD-200场景训练出的智能体对HM3DSem物理世界场景的泛化效果更好。

HomeRobot

共用、共享平台是机器学习进步的重要组成部分,但在机器人领域,由于很难复制和扩展硬件成果,因此十分缺少类似的平台。

对此,Meta为可重现的机器人研究平台提出了三个目标:

- 一颗激励人心的北极星:

平台需要提供具有指导性的北极星任务,以此激励研究人员并帮助他们开展工作。其中,他们还可以在有趣的真实世界问题上对各种方法进行比较。

比如「开放词汇移动操纵(OVMM)」——在任意未知的环境中拾取物体,并将其放到指定位置。这需要非常强大的长期感知能力和场景理解能力,而且对各类的任务都非常有用。

- 软件能力:

平台需要提供一些抽象界面,使机器人更容易用于各种任务,包括导航和操作。

- 社区:

平台需要鼓励开发者参与进去,并尝试围绕代码库建立一个社区。

为了推动这一领域的研究,Meta推出了一个全新的HomeRobot库,实现了对Hello Robot Stretch的导航和操纵功能的支持。

项目地址:https://github.com/facebookresearch/home-robot

具体来说,HomeRobot有两个组件:

1. 模拟组件:提在新的、高质量的多房间家庭环境中使用大量且多样的对象集;

2. 物理世界组件:为低成本的Hello Robot Stretch以及波士顿动力公司的产品提供软件堆栈,以鼓励在各实验室之间复制物理世界实验。

此外,HomeRobot还提供了一个非常友好的软件栈,从而让用户能够快速设置机器人,并立即进行测试。其特点包包括:

- 可移植性:

每项任务的模拟和物理世界设置之间都有统一的状态和动作空间,为使用高层次的动作空间(如预设抓取策略)或低层次的连续关节控制来操作机器人,提供了简便的方法。

- 模块化:

感知和行动组件支持高层次的状态(如语义地图、分割点云)和高层次的行动(如前往目标位置、拾取目标物体)。

- 基准智能体:

使用这些功能为OVMM提供基本功能的策略,以及构建更复杂智能体的工具,其他团队可以在此基础上进行开发。

在HomeRobot OVMM基准中,智能体可在家居环境中抓取新奇物品,并将其放入或放在目标容器中。

其中,Meta采用强化学习和启发式(基于模型)基线,展示了导航和放置技能可以从模拟到物理世界转移。结果表明,基线可以在物理世界中实现20%的成功率。

小米最强骁龙8 Gen4旗舰!小米15 Pro参数曝光

快科技6月7日消息,据博主爆料,小米15系列将在今年10月份登场,这次小米将同时推出小米15和小米15Pro两款机型,二者首批搭载骁龙8Gen4平台,其中Pro版将是小米最强悍的骁龙8Gen4旗舰。据爆料,小米15Pro型号为24101PNB7C,代号是haotian(昊天)”,在古代中国的神话体系中,昊天字面意思就是在天上的帝王”,意味着最高的主宰”。站长网2024-06-07 09:41:280000国产具身人形机器人征服复杂场景: 实时感知规划,动态运动告别“盲走”

AttentionPlease!这是一个整装待发的国产人形机器人:先拿比较基础的挑战场景热热身。首先完成的是行走过程中主动调整步态,抬腿从平地迈上台阶:再加大点场景难度,让它完成上楼梯任务,还能看到实时感知画面:或者下15度的斜坡,都能一气呵成:这家伙还从室内走到了户外,从白天走到了傍晚,在不同环境条件下进行测试。动态表现怎么说呢,就挺稳定,夸句“出色”并不为过。0000仅次OpenAI!AI初创公司Inflection融资13亿美元 估值达40亿美元

日前,总部位于加州的AI初创公司Inflection宣布完成13亿美元的最新一轮融资,本次融资由微软、英伟达以及比尔·盖茨、埃里克·施密特、ReidHoffman(LinkedIn的创始人)牵头投资,英伟达也参与其中。站长网2023-06-30 19:48:450000美法院判AI无版权,但争议远没结束

生成式AI起势之后,版权问题一直挥之不去。日前,美国华盛顿一家法院裁定,在没有任何人类输入内容的情况下,完全由人工智能创作的艺术作品不受版权保护。这一裁定,令AI的前景蒙上一层阴影。AI的版权之争,迎来终局了吗?对AI的创作,各界为何仍有争议?AI革命之下,版权保护未来将如何演绎?版权之争,从成品走向数据这起判例,要追溯到2018年。站长网2023-09-01 18:17:240000