消息称OpenAI取消更高效的GPT-4级别AI模型“Arrakis”开发

划重点:

1. 🚫OpenAI停止了“Arrakis”项目的开发,因为其质量不符合要求,这一模型原本旨在比GPT-4更高效。

2. 💡Arrakis的设计采用了稀疏原则,只激活部分神经网络,与传统“密集模型”不同,但在后期测试中表现不佳。

3. 🚀尽管“Arrakis”项目失败,OpenAI计划将其经验应用于其他模型,如计划中的Gobi多模态模型,同时继续改进GPT-4。

OpenAI曾计划开发一款名为“Arrakis”的全新AI模型,旨在提高AI推断的效率,使其更经济实惠。然而,由于质量问题,该公司不得不停止了这一项目的开发。

“Arrakis”本应与GPT-4一样强大,但成本更低,因为该模型部分采用了所谓的稀疏原则。这意味着只有神经网络的部分部分用于处理输入,而在传统的“密集模型”中,整个神经网络是活跃的。例如,谷歌在其Pathways AI项目中采用了稀疏原则。

图源备注:图片由AI生成,图片授权服务商Midjourney

The Information援引两名熟悉该项目的人士的说法,“Arrakis”项目的开发始于去年秋季,训练于春季开始。但OpenAI的开发团队很快意识到性能不够出色,据

团队在一个月的时间内进行了一些微调,然后领导团队终止了该项目,但目前尚不清楚为什么稀疏原则在早期测试中效果不错,但在更大的模型上失败了。

尽管存在这一挫折,OpenAI可能会将“Arrakis”项目的经验应用于其他模型,例如计划中的Gobi多模态模型。在“Arrakis”项目失败后,OpenAI的研究人员着手开发一款GPT-4版本,该版本可以生成更快的响应。

这可能就是今年夏季推出的GPT-4版本“0613”,比OpenAI今年3月初推出的版本“0314”明显更快。尽管一些用户抱怨在某些领域失去了一些质量,但OpenAI却予以驳斥,这导致公司提供API访问0314版本的时间比原计划更长。

OpenAI将人工智能引向沙漠,他们的新AI模型原型命名为“Gobi”、“Sahara”和“Arrakis”,以向稀疏原则致敬,并希望这些模型能够更高效地工作并降低成本。尤其是OpenAI的合作伙伴微软希望“Arrakis”可以降低其产品中生成式AI的使用成本。

此外,据《华尔街日报》报道,微软已经将资源转向开发成本更低的语言模型,因为生成式AI的高成本威胁着新兴的商业模型。

此前有消息称OpenAI泄露者FeltSteam曾提到“Arrakis”。该模型据说不仅可以生成文本,还可以生成图像和视频,幻觉较少,适用于自主代理。此外,“Arrakis”将部分采用合成数据进行训练,计划明年发布。

开源鸿蒙又一里程碑!OpenHarmony 4.0正式发布:代码行数已破亿

快科技11月5日消息,第二届开放原子开源基金会OpenHarmony技术大会在北京圆满落幕,本次大会由OpenHarmony项目群技术指导委员会主办,由华为、润开鸿、九联开鸿、软通动力、深开鸿合作支持。开幕式上,开放原子开源基金会理事长孙文龙发表了致辞,宣布OpenHarmony4.0版本正式发布,并强调了OpenHarmony在推动千行百业数字化转型中的重要作用。站长网2023-11-05 09:42:230000因争相满足人工智能需求,微软的排放量增长近30%

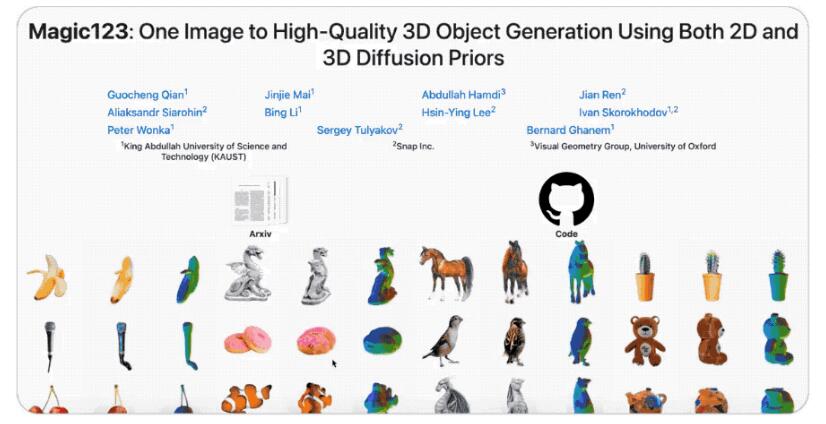

划重点:-微软的排放量自2020年以来增长了近30%,这凸显了在满足气候目标的同时投资基础设施的挑战。-由于人工智能和云计算系统所依赖的数据中心建设,排放量的增加主要是由于这一原因。-微软已经投入了数十亿美元在OpenAI和自身的人工智能工具上。站长网2024-05-16 10:01:250000最新“只用一张图转3D”方法火了!GitHub刚建空仓就有300+人标星

最新的一种只用一张图转3D的方法名为Magic123,在GitHub上刚建立空仓就有300多人标星。与之前的方法相比,Magic123能够生成高质量、高分辨率的3D网格,并且还能细化几何结构和纹理。站长网2023-07-24 14:03:370001华为发布通信行业首个大模型 推动网络生产力提升

在巴塞罗那盛大举行的2024世界移动通信大会(MWC2024)上,华为成为焦点。该公司不仅展示了其5G-A全系列产品与解决方案,还首次发布了通信行业的大模型。据华为官方介绍,这款大模型针对行业提出的敏捷业务发放、精准用户体验保障、跨领域高效运维的高阶智能化目标而设计。它能够提供基于角色和基于场景的智能化应用,旨在帮助运营商提升员工能力、增强用户满意度,并全面推动网络生产力的提升。站长网2024-02-27 08:24:430000Anthropic 超越 OpenAI 的聊天机器人 Claude AI 能在一分钟内分析整本书

聊天机器人经常被忽视的一个限制是记忆能力。虽然这些系统的AI语言模型是基于TB级的文本上训练的,但它们在使用过程中能够处理的文本量(即输入文本和输出的组合,也称为「contextwindow上下文窗口」)是有限的。对于ChatGPT来说,大约是3000个单词。虽然有办法可以解决这个问题,但它仍然不是大量的信息。站长网2023-05-15 11:43:210001