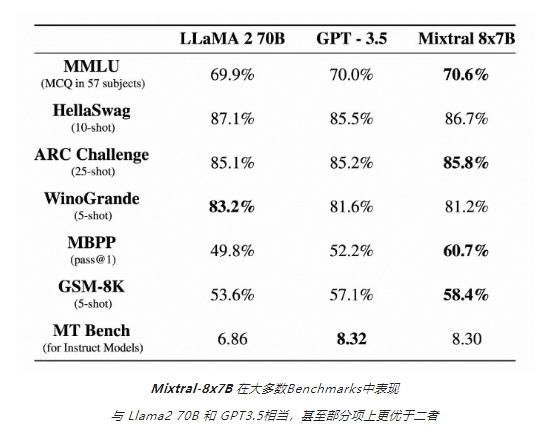

Mixtral8x7B

热点

《哪吒2》改写中国影史背后,这些配角燃爆了社交媒体

2025-02-10 03:21:53DeepSeek下棋靠忽悠赢了ChatGPT,网友:孙子兵法都用上了

2025-02-10 03:17:44字节跳动放大招!OmniHuman数字人模型即将上线:一张图+一段音频即可生成视频

2025-02-10 03:06:06为训练AI不择手段!Meta被曝下载数十TB盗版电子书

2025-02-10 08:38:57中国AI新秀爆火 DeepSeek成史上最快突破3000万日活App

2025-02-10 08:38:56雷军驾驶小米YU7参与冬测:表现不错 测试任务圆满完成

2025-02-10 05:11:19用DeepSeek“赚钱”网课泛滥 专家:普通用户不用花钱学

2025-02-10 05:11:18索尼PSN严重宕机!超过24小时才恢复:实体游戏零售商在线补刀

2025-02-10 05:11:17京东外卖“低佣”入局,美团回应“30%高佣”质疑

2025-02-10 05:11:12|美团开放个人摄影师入驻,搅热500亿市场?

2025-02-10 03:41:55

关注

消息称特斯拉Model Q年中发布:仅需人民币15万元

2025-02-05 23:25:20《哪吒2》登顶,谁赚麻了?

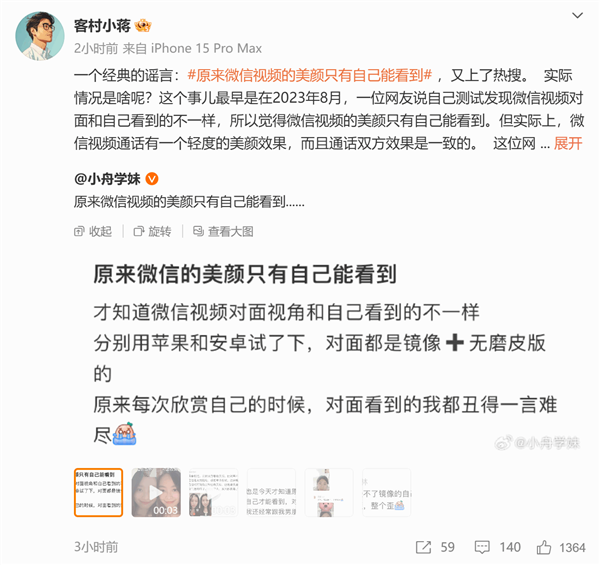

2025-02-07 15:41:39微信视频美颜仅自己能看到引热议 微信员工:谣言 双方都能见

2025-02-04 22:10:55雷军去小米汽车工厂上班了:确认要进一步提产 冲击年销30万辆

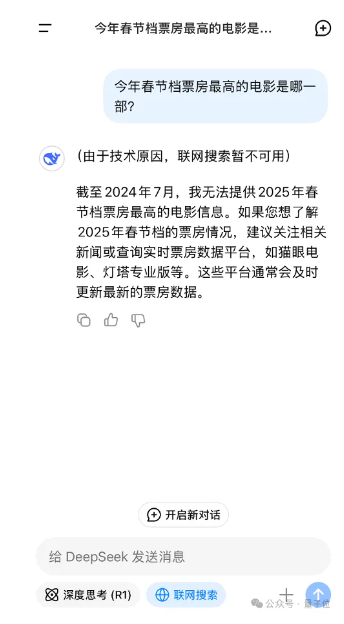

2025-02-07 15:06:26国产AI搜索接入DeepSeek-R1,深度试玩报告抢先出炉:正愁用不上官方联网搜索

2025-02-04 21:56:29小米眼镜官博上线 旗下首款AI眼镜将发布

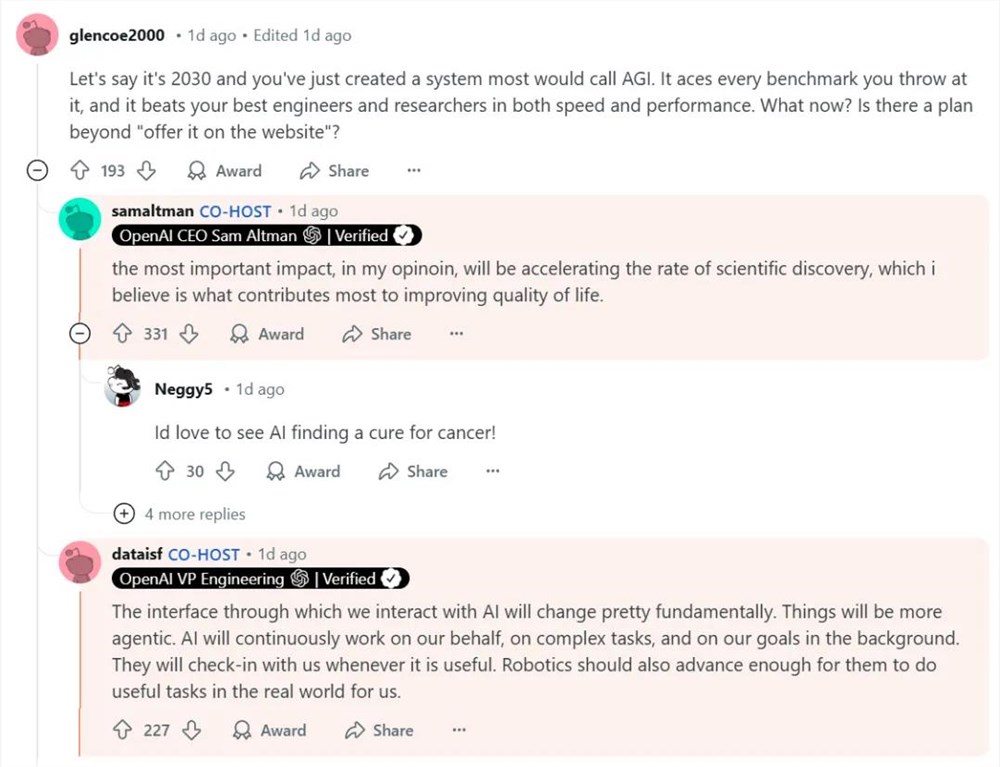

2025-02-07 10:20:34被DeepSeek干服了!OpenAI承认闭源错误,领先优势变小

2025-02-04 20:22:14模型优惠进入倒计时 DeepSeek因服务器暂停API服务充值

2025-02-07 03:18:38用百度AI拜年,奶奶比我更上头

2025-02-04 20:17:07小米眼镜官微上线:智能眼镜赛道要爆发

2025-02-07 02:59:11