Anthropic警告:距离无人干涉的 “AI员工” 时代,只剩一年了!

人工智能公司 Anthropic 的首席信息安全官杰森・克林顿(Jason Clinton)就企业运营方式的重大转变发出了警告:到明年,完全自主的 “AI员工” 可能就会开始替代各大企业的人类员工。这些 AI 将不再是简单的工具或助手,而是拥有自己的账户、记忆、且在公司组织中承担专门职责的虚拟员工。

克林顿表示,相较于如今功能单一的 AI 系统,这些即将出现的 AI 主体将会有质的飞跃。虽然,目前的AI工具已经能够处理特定的安全检查、以及一些简单的人物,但下一代 AI 将能在公司的各个系统中独立运行 —— 无需人类监督,就能做出复杂决策,并完成多步骤的工作流程。

“我们说的是虚拟员工,而不只是(普通的)AI 智能体”, 克林顿解释道。这种区别意味着未来的这些 AI 主体将更像是人类同事,而非我们如今所使用的 AI 工具。

这一警告给那些已经在为基础网络安全问题而困扰的企业带来了更加严重的安全隐患。那些在管理人类员工账户和密码方面存在困难的公司,很快将面临更大的挑战 —— 即如何确保拥有网络访问权限的人工智能身份的安全。

安全专家们已开始提出一些棘手的问题:公司应该如何管理人工智能的密码?“AI员工” 应该访问哪些系统?当“AI员工” 犯错或出现意外行为时,该由谁来承担责任?诸如此类。

不过,最令人担忧的或许是,AI 系统存在被入侵的可能性,并且可能会获取对公司关键基础设施(如代码测试和部署平台)的访问权限。根据克林顿的警告,这些风险在很大程度上仍未得到解决。

值得一提的是,Anthropic 公司的规模急剧扩大,从 2021 年的仅 7 名员工发展到 2025 年的 1000 多名员工。该公司承认自己在应对这些挑战方面负有责任 —— 他们表示,针对潜在的攻击,正在对其人工智能模型 Claude 进行全面测试,并积极监测因滥用可能引发的安全问题。

据估计,Anthropic 今年的收入将达到 22 亿美元,这意味着,即使AI领域存在持续的担忧,但仍实现了爆发式增长。

大型 AI 公司的现任和前任员工也表达了对伦理问题的担忧,他们呼吁提高人工智能能力和风险方面的透明度。并警告称,如果没有适当的监督,先进的 AI 系统可能会加剧不平等,并传播错误信息。

AI 自己总结的 10 个使用模式,覆盖 90%以上应用场景

最近受“三层解释思维模型”启发,开始强迫自己思考挖掘事物的规律,尽量做到事事都能总结到可以得出“举一反三”的方法论状态。想到很早以前让ChatGPT帮我总结过可以让AI帮人类做什么,这两天又重新翻新了一下提示词,总结出了10个「AI的使用范式」。图源备注:图片由AI生成,图片授权服务商Midjourney#范式一:对话模式站长网2023-09-12 17:08:000000在抖音“批量制造”小杨哥,月赚20万的野蛮生意

FastReading靠着批量制作小杨哥直播切片视频,乔林和他的团队每个月营业额能达到20万元上下。切片视频依靠带货产品的购买量拿分成,公司会将切片视频盈利的千分之一分给剪辑师。越来越多的个体涌入切片小视频制作,正是这一行业红利期快结束的端倪之一。“小杨哥徒弟小黄在直播间公然造反!”“小杨哥推荐雪地靴,和美女品牌方亲切互动,被小杨嫂查岗抓现行。”0000五天日流水破万,娱乐直播间如何借视频“宫格”从0起航?

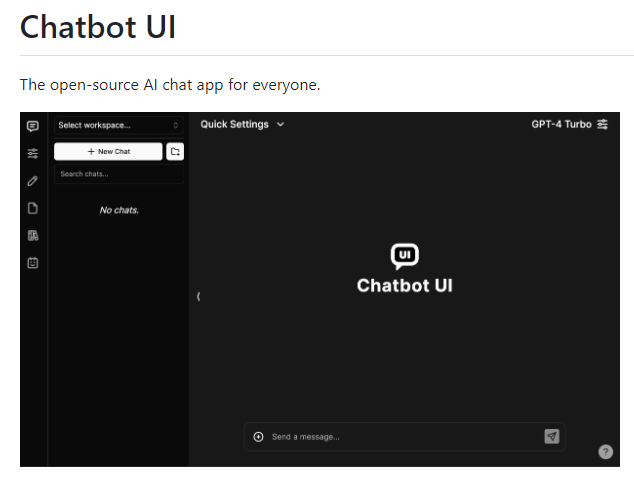

“终于开播啦!今天是和谁连麦?”“上班抽空来看辣椒。”“主播好帅啊。”虽然是工作日的下午,@Ry差生补习班/交友CP的直播间内却是一派热闹。8位主播在主持人的协调下,进行着“萝卜蹲”的经典游戏,屏幕外的粉丝们也积极刷着弹幕和礼物,向自己支持的主播表达喜爱。开播还不到十分钟,直播间就登上了山西榜人气第一的位置。站长网2023-05-27 09:51:320001开源聊天机器人Web UI框架Chatbot UI 可轻松创建任意模型聊天机器人

ChatbotUI是一个开源的聊天机器人WebUI框架,它支持接入多种模型,包括OpenAI、AzureOpenAI、Anthropic、Google、Mistral和Perplexity等。此外,它还支持Ollama上的本地模型接入。这意味着只需输入这些模型的API,就能轻松创建非常美观的任意模型聊天机器人。站长网2024-01-12 11:36:310001创业失败,又不赚钱,因为你做的太多了!

各位村民好,我是村长。很多人创业失败,一直赚不到钱。并不是因为懂得太少,而是知道的太多、做的太多!今天就要说一下,许多人在赚取人生第一桶金的时候,都会出现的问题,这几乎是每个人都会犯的错。01想的太多许多人都想拍短视频,毕竟看到了那么多人通过短视频赚到了钱。但是还没有认真拍之前,就开始胡思乱想了。我拍视频被朋友、亲戚、同学看到怎么办?他们会嘲笑我的。站长网2023-07-28 09:13:100003