Privado推出开源LLM聊天应用MuroChat 加强企业数据保护

划重点:

🔸 Privado.ai 推出开源的 LLM 聊天应用 MuroChat,旨在增强企业数据保护,解决 LLM 聊天机器人引入的数据隐私风险。

🔸 MuroChat 能够自动检测和删除聊天提示中的敏感数据,提供监控概览和本地聊天历史记录等特性,满足企业组织的需求。

🔸 MuroChat 是 Privado.ai 开源产品的一部分,帮助创新组织在新环境中保护个人数据和知识产权。

Privado.ai,一家以开发者友好的隐私平台闻名的公司,推出了一款创新的开源 LLM 聊天应用 MuroChat,旨在加强企业数据保护,解决 LLM 聊天机器人引入的数据隐私风险。

Privado体验网址:https://top.aibase.com/tool/privado

这种基于大型语言模型(LLM)的聊天机器人应用如 ChatGPT 等,为全球各行各业的专业人士提供了创作内容、生成想法、撰写电子邮件、生成代码等功能。然而,这些聊天机器人在共享提示时可能无意中包含个人数据或知识产权,而企业本身可能对潜在泄露毫无察觉。

面对这些新的风险,Privado 团队决定采取行动,并构建一种保护自身数据的解决方案。Privado.ai 的联合创始人兼首席技术官 Prashand Mahajan 表示:“我们决定构建自己的聊天应用程序,以使我们能够完全控制我们的数据,防止知识产权和个人数据的潜在泄露。”

MuroChat 通过位于用户和基于 LLM 的聊天机器人之间,自动检测和删除提示中的敏感数据,从而减轻了这些风险。这是保持隐私并遵守合规标准的关键功能。但是,让 MuroChat 真正独特的是其为企业组织解决这个问题而设计的特性。

MuroChat 的特点包括:

- 与大型语言模型的集成:开箱即用支持 OpenAI 的 ChatGPT API,并具备灵活的架构,可与任何第三方 LLM 后端实现无缝集成。

- 数据防火墙:通过集成 Microsoft Presidio,在将数据发送给使用的 LLM 聊天机器人之前,自动检测和删除敏感数据。

- 单一登录(SSO):支持 Okta 等系统,简化身份验证和访问控制。

- 本地聊天历史记录:提供本地存储的聊天历史记录,便于监控和提高问责制。

- 不断发展的功能集:从详细的审计跟踪和监控工具到 LLM 成本控制功能,MuroChat 在未来还有许多令人兴奋的功能。

开源 MuroChat 符合 Privado 的开源理念和对开发者友好的态度(Privado 的旗舰隐私代码扫描解决方案也有开源版本)。更重要的是,这是一种让创新组织在这个新环境中提前保护个人数据和知识产权的方式。Mahajan 解释了开源 MuroChat 的想法:“在开发 MuroChat 的过程中,我们意识到许多其他公司面临着同样的挑战,开源解决方案不仅可以解决我们自身的问题,还可以让其他组织快速开发他们自己的安全聊天应用。”

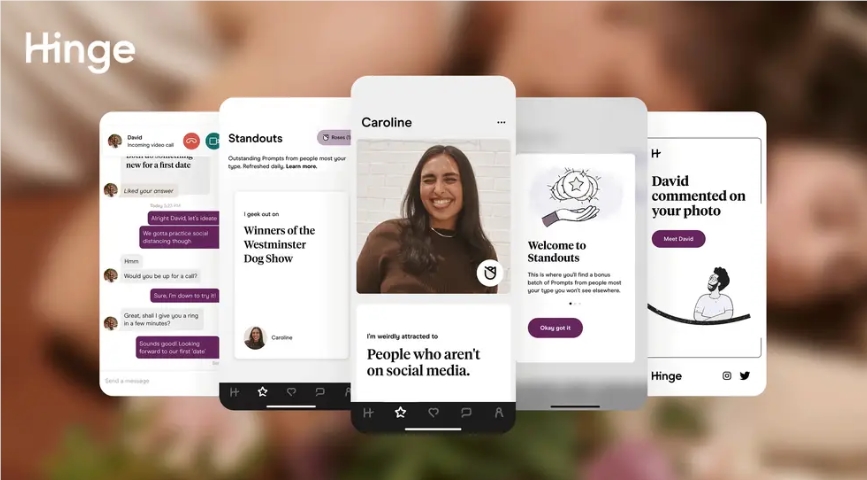

约会应用 Hinge正在招聘人工智能副总裁 薪资可达每年39.8万美元

文章概要:1.Hinge正在招聘一位人工智能副总裁,负责领导团队开发和部署AI功能,薪资可达每年39.8万美元。2.该职位要求候选人拥有计算机科学、人工智能或数据科学等领域的硕士或博士学位,并在产品导向的科技公司具有领导经验。3.Hinge的母公司MatchGroup正致力于将AI功能整合到其系列约会应用程序中,例如通过AI选择照片和解释推荐原因。站长网2023-08-15 10:50:300000当一个行业默认抄袭为方法论时,就一定没有人才密度?

站长网2023-07-13 21:52:030000高考生喊话马化腾新版QQ空间难用后 腾讯火速调整:改好了!

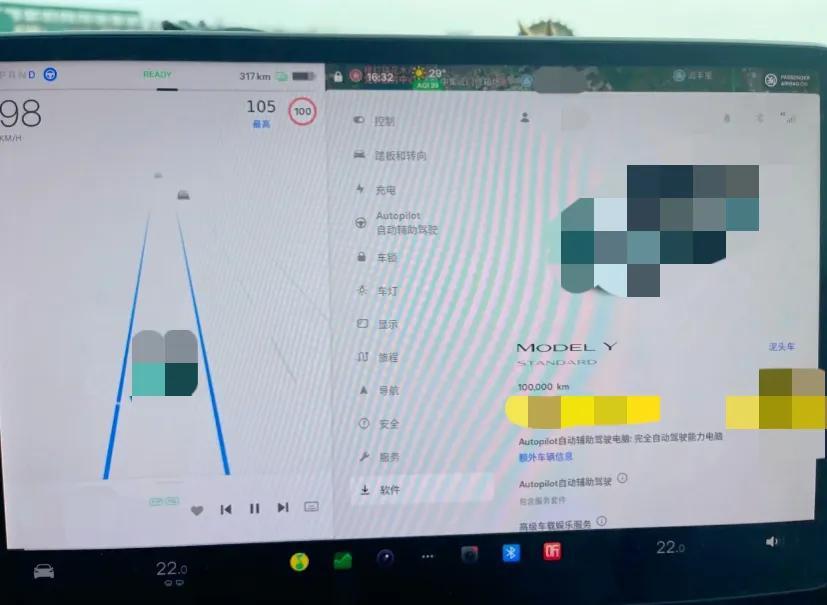

快科技6月26日消息,在2023年全国高考首日,杭州十四中考点首位走出考场的考生接受采访时喊话马化腾称,腾讯能不能把QQ空间改回老版,新版太难用了”。喊话没多久,腾讯QQ官博进行回应,表示非常重视你的建议!先专心考试,等考试结束后,我们第一时间联系你!祝你高考顺利”。距离喊话已快20天,QQ空间改的怎么样了?站长网2023-06-27 16:03:550000两年前买的特斯拉 Model Y,目前行驶了 10 万公里,聊聊我的用车感受

估计这是广东第一台已经开了10万公里的特斯拉ModelY,当年买的21款配19寸轮毂,百公里加速5.6S的那款,因为做工程所以经常开着车到处跑。目前的车况:刚提车那会满电续航435km,现在充满电续航424km,其实也就掉了11公里的续航损耗,基本上用的都是家充,而且还是是国产的第三方充电桩。关于行驶了10万公里的用车费用:电费:站长网2023-05-24 00:36:580002如何通过集成GPTCache来优化LLM应用的速度和降低成本

文章要点:1.GPTCache可以显著减少延迟从而使LLM应用程序变得超快2.通过减少对LLM的调用,可以节省计算资源从而降低成本3.GPTCache具有可扩展性,适用于各种规模的应用站长网2023-08-31 15:45:160000