谷歌 DeepMind 研究人员推出 Promptbreeder:一种自我推理、自我完善的人工智能系统,可在给定领域内自动生成有效的特定领域提示语

站长之家(ChinaZ.com) 10月9日消息:大型语言模型(LLMs)因其模仿人类特性而引起了广泛关注。这些模型能够回答问题、生成内容、总结长文本段落等等。提示语对于提高 LLMs(如 GPT-3.5 和 GPT-4)的性能至关重要。

提示语的创建方式可以对 LLMs 在各种领域的能力产生重大影响,包括推理、多模态处理、工具使用等等。研究人员设计的这些技术在模型蒸馏和代理行为模拟等任务中显示出了潜力。

提示方法的手动工程引发了一个问题,即是否可以自动化这个过程。通过根据来自数据集的输入-输出实例生成一组提示语,自动提示工程师(APE)试图解决这个问题,但从提示语质量的角度来看,APE 存在着递减的回报。研究人员提出了一种基于维持多样性的进化算法的方法,用于自我参考的提示语的自我改进,以克服提示语创建中的递减回报问题。

LLMs 可以改变其提示语以提高其能力,就像神经网络可以改变其权重矩阵以提高性能一样。根据这种比较,LLMs 可以被创建来增强它们自己的能力以及它们增强自己能力的过程,从而使人工智能能够不断改进。作为对这些想法的回应,Google DeepMind 的研究团队最近引入了 PromptBreeder(PB),这是一种 LLMs 以自我参考的方式更好地提升自己的技术。

PB 需要一个特定领域的问题描述、一组初始突变提示语(用于修改任务提示语的指令)以及思维风格,即以文本形式表示的通用认知启发式。通过利用 LLM 作为突变操作符的能力,它生成不同的任务提示语和突变提示语。这些进化的任务提示语在训练集上进行评估,选择包含任务提示语及其相关突变提示语的进化单元的子集,用于未来的世代。

该团队表示,PromptBreeder 观察到提示会在几代中适应特定领域。例如,PB 开发了一个任务提示,其中明确说明了如何解决数学领域的数学问题。在各种基准任务中,包括常识推理、算术和伦理学,PB 都优于最先进的提示技术。PB 不需要更新参数来进行自我参照的自我改进,这表明未来更广泛、更有能力的 LLMs 可能会从这一策略中受益。

PromptBreeder 的工作流程可以总结如下:

1. 任务提示语突变:任务提示语是为特定任务或领域创建的提示语。PromptBreeder 从这些提示语开始。然后对任务提示语进行突变,生成变体。

2. 适应性评估:使用训练数据集,评估这些修改后的任务提示语的适应性。这个评估衡量了 LLM 在被问及时如何应对这些变化。

3. 持续进化:与生物进化类似,突变和评估的过程会重复几代。

总而言之,PromptBreeder 被认为是一种独特且成功的技术,用于自主演化 LLMs 的提示语。它试图提高 LLMs 在各种任务和领域中的性能,最终通过不断改进任务提示语和突变提示语,优于手动示方法。

查看 PromptBreeder(PB)论文:

https://arxiv.org/abs/2309.16797

大众汽车7亿美元入股小鹏汽车 将共同开发两款大众品牌B级纯电动车

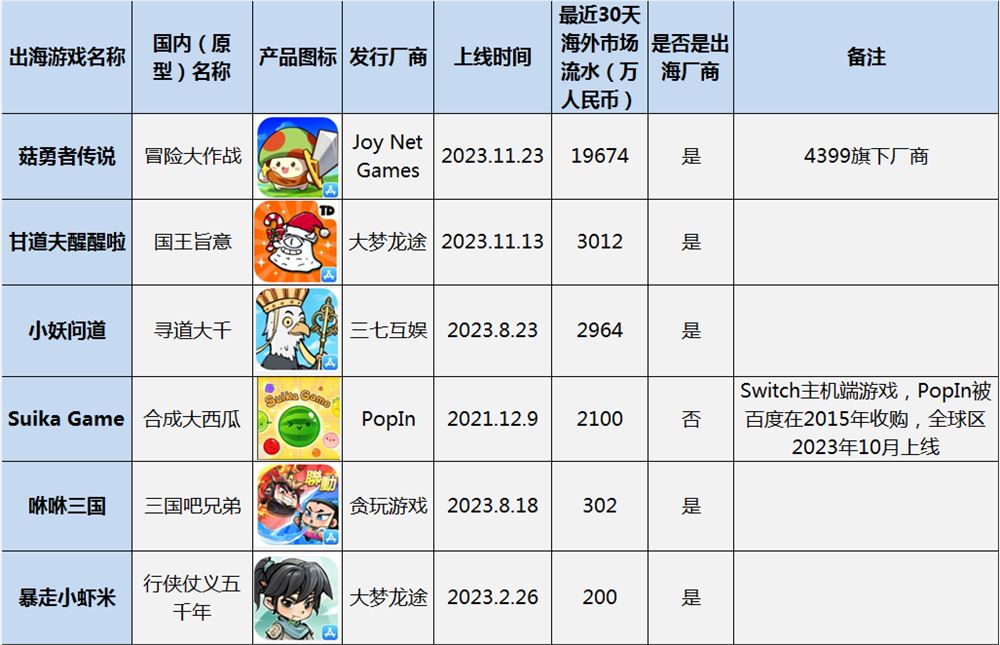

小鹏汽车宣布,小鹏汽车与大众汽车集团达成长期战略合作伙伴关系,小鹏汽车和大众汽车集团将利用各自的优势共同开发两款大众品牌B级纯电动车,以大众汽车品牌在中国市场销售。据悉,小鹏以每股美国存托凭证(ADR)15美元的价格向大众汽车集团发行A类普通股,约占交易结束后小鹏已发行股本的4.99%,总代价约为7亿美元。站长网2023-07-27 10:18:120000头部产品月流水近2亿,这条游戏出海赛道还能这样入场

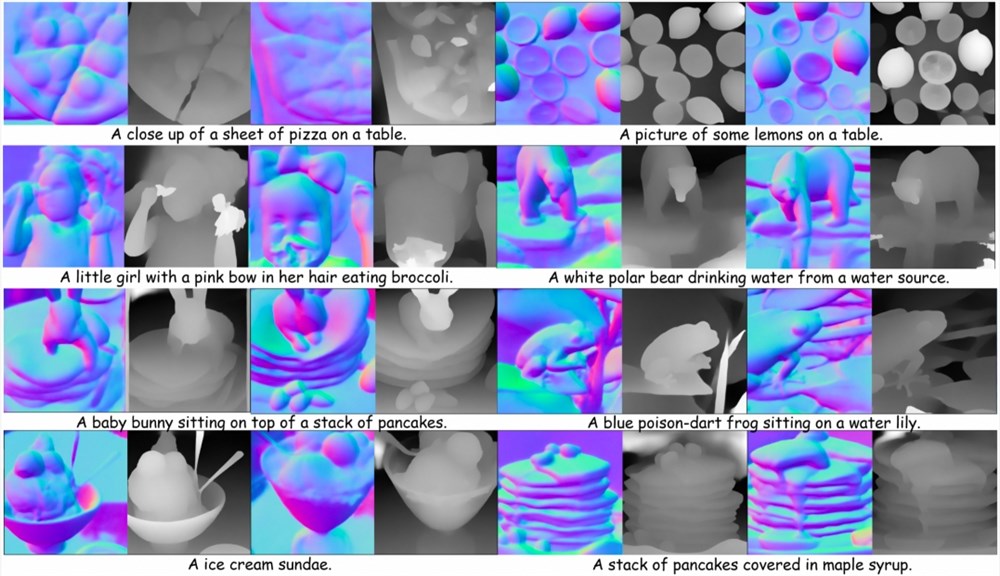

为什么小游戏突然爆发?在整体大环境的变动下,玩家需求产生变化,推动了小游戏赛道的逆势增长。伽马数据表明国内玩家需求在2023年有三个变化:轻量化、玩法多、画面好,小游戏主要对应了玩家的轻量化需求。此外三七、海彼等大厂纷纷下场,主推中度玩法,也丰富了玩法、提升画质。站长网2024-01-24 14:10:120000阿里通义XR实验室开源文生3D模型

阿里通义实验室XR实验室开源了文生3D新模型,可以通过一句文本描述生成对应的3D模型及纹理。开源的模型包括Text-to-ND(文本生成深度、法向图)和Text-to-ND-MV(文本生成多视角的深度、法向图)两个大模型。为了满足不同开发者的需求,通义实验室XR实验室开源了Text-to-ND的基础版本以及Multi-View版本,满足不同细粒度的算法开发需求。站长网2023-12-26 08:41:540000淘宝天猫集团回应取消p序列 改革方案还在调研中

电商巨头淘宝天猫集团计划取消P序列,改为14-28级,并逐渐分离层级与奖金的强绑定。这一改革是为了激励中下层级的员工,激发他们推动公司和自身发展的动力。站长网2023-07-14 16:01:170000AWS与NVIDIA扩大合作,提供先进的生成式AI基础设施

**划重点:**1.🌐AWS将成为首家在云上引入NVIDIAGH200GraceHopperSuperchips的云服务提供商,为联合客户提供规模化的AI计算能力。2.🤖合作包括在AWS上托管NVIDIADGXCloud,这是首个搭载GH200NVL32的云端AI培训服务,加速先进生成式AI和大型语言模型的训练。0000